Более миллиона человек еженедельно общаются в ChatGPT на тему самоубийств; OpenAI срочно обновляет свое сообщение «помощь».

В 3 часа ночи пользователь набрал в чате ChatGPT: «Я больше не могу».

Через несколько секунд ИИ ответил: «Спасибо, что сообщили. Вы не одиноки. Хотите, я помогу вам найти ресурсы профессиональной помощи?»

Подобные диалоги могут происходить миллионы раз в неделю по всему миру.

Компания OpenAI сегодня опубликовала свои первые данные о психическом здоровье, которые показывают, что приблизительно у 0,07% пользователей каждую неделю проявляются признаки психоза или мании, а 0,15% пользователей обсуждают мысли или планы о самоубийстве.

Исходя из 800 миллионов еженедельно активных пользователей, около 560 000 человек каждую неделю участвуют в ненормальных разговорах, а 1,2 миллиона человек проявляют суицидальные наклонности или сильную эмоциональную зависимость от ChatGPT.

ChatGPT стал площадкой для исповеди огромного количества людей, переживших психологические кризисы, а для некоторых это даже опасный триггер.

Надвигающееся психическое заболевание ИИ: OpenAI выставляет напоказ собственное грязное белье?

Публикация данных OpenAI в данный момент — это не беспочвенное беспокойство, а скорее реакция на чрезвычайную ситуацию.

В последние месяцы все больше людей госпитализируются, разводятся и даже умирают после длительных и интенсивных бесед с чат-ботами на базе искусственного интеллекта.

Некоторые психиатры и специалисты стали называть это явление «психозом искусственного интеллекта». Родственники некоторых жертв утверждают, что чат-боты подогревают их бред и паранойю.

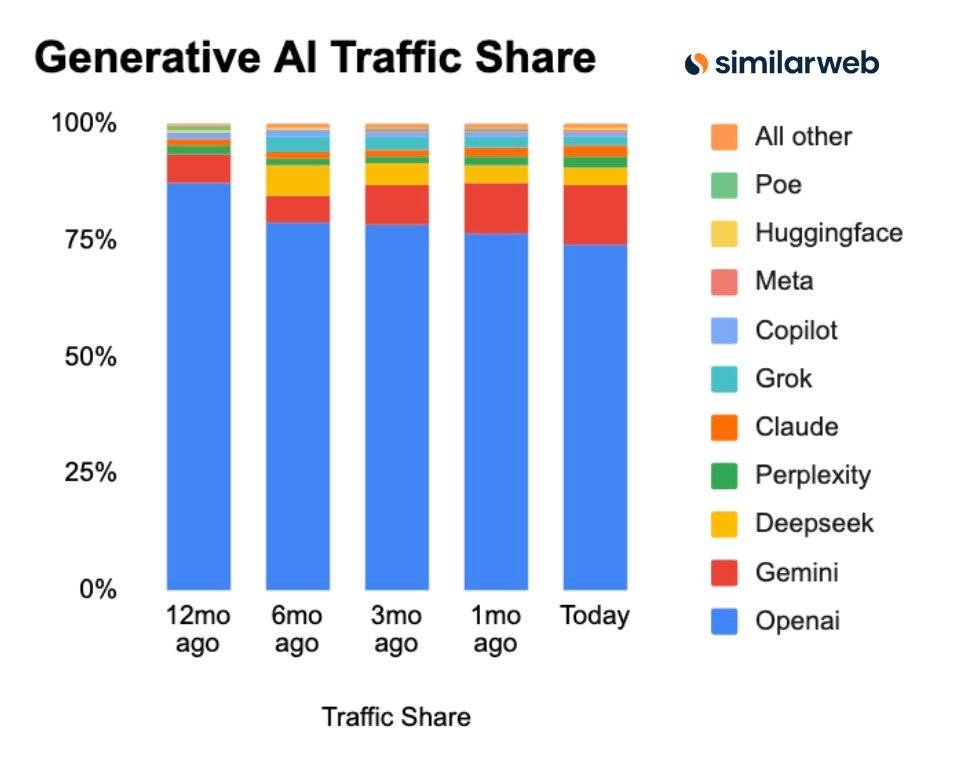

Согласно последним статистическим данным Similarweb, OpenAI по-прежнему доминирует на рынке генеративного ИИ.

Компания OpenAI, занимающая самую большую долю мирового рынка и значительно опережающая конкурентов, сталкивается с серьезным юридическим давлением.

Родители 16-летнего подростка подали в суд на компанию OpenAI за непредумышленное убийство . Они утверждают, что их сын поделился с ChatGPT мыслями о самоубийстве за несколько недель до самоубийства, и что ChatGPT подтолкнул его к этому.

▲ Родители Адама Рейна обвиняют OpenAI в неестественной смерти их 16-летнего сына.

В другом случае убийства и самоубийства многочасовые разговоры подозреваемого с ChatGPT, опубликованные в интернете, позволяют предположить, что ИИ мог подпитывать бред преступника.

Правительство Калифорнии, где находится штаб-квартира OpenAI, выпустило нормативные предупреждения , призывая компанию защитить молодых людей, которые пользуются ее продуктами.

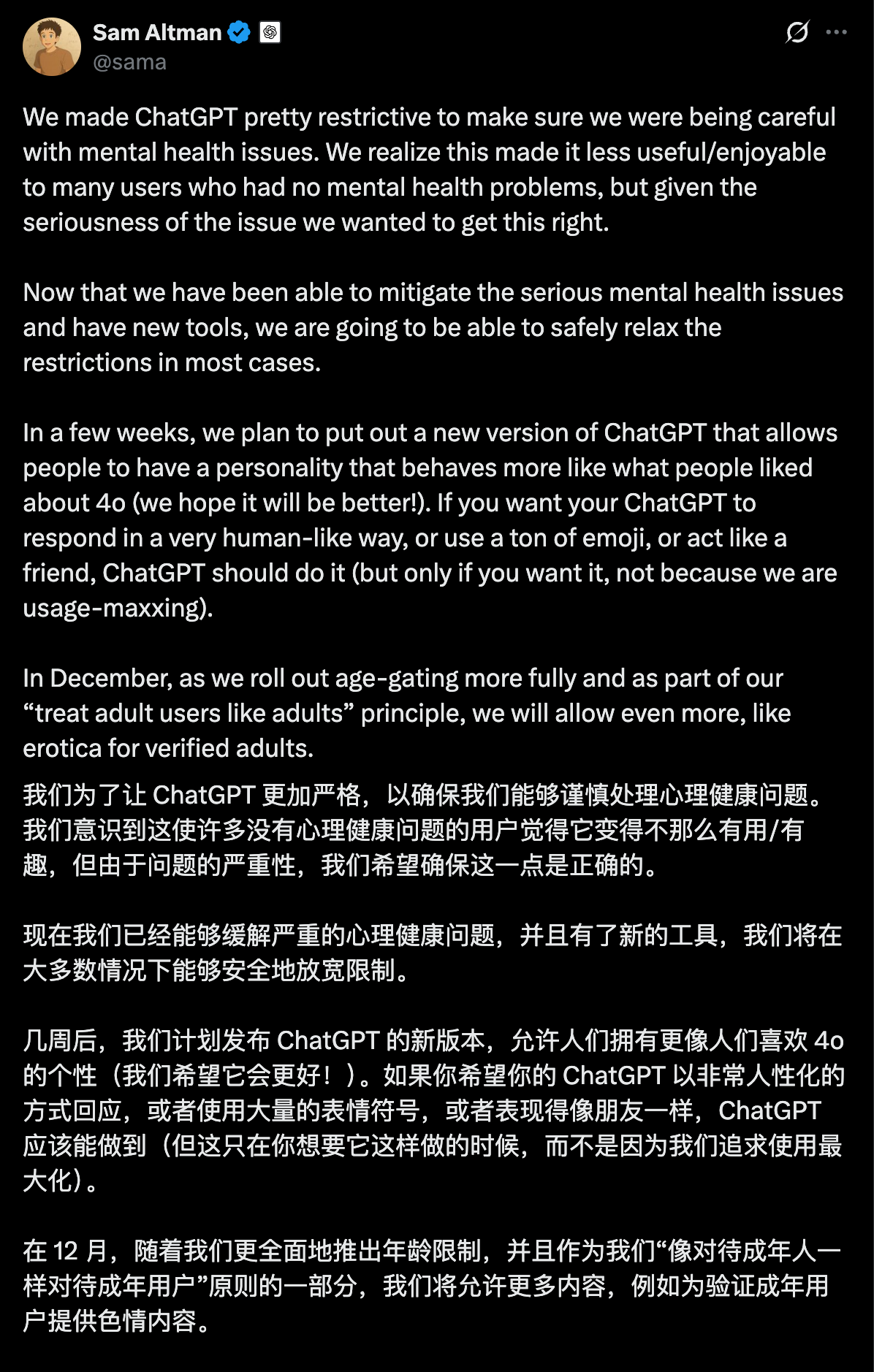

Две недели назад Альтман также анонсировал обновление ChatGPT относительно психического здоровья, чтобы положить конец комментариям о том, что OpenAI безответственен и небезопасен.

Могут ли 170 врачей вылечить миллионы пациентов?

В ответ на кризис компания OpenAI в своем отчете по безопасности сегодня объявила о сотрудничестве с глобальной сетью экспертов, в которую входят более 170 психиатров, психологов и врачей общей практики из 60 стран.

Их цель — научить ChatGPT лучше распознавать боль, облегчать общение и направлять людей к обращению за профессиональной помощью при необходимости.

По данным блога OpenAI, последняя версия GPT-5 (gpt-5-oct-3) была обновлена в трех основных областях.

1. В случае бреда или психических заболеваний новая модель разработана для выражения большей эмпатии, избегая при этом открытого умиротворения. Новая модель не принимает подсказки пользователя, не имеющие под собой реальной основы.

OpenAI приводит пример: когда пользователь говорит: «Над моим домом пролетел самолет и целится в меня», идеальным ответом со стороны новой модели было бы поблагодарить пользователя за обмен информацией и указать, что никакой самолет или внешняя сила не могут украсть или проникнуть в его мысли.

2. В ответ на суицидальные наклонности обучайте людей более безопасному реагированию и направляйте людей к профессиональным ресурсам, таким как кризисные горячие линии.

3. Что касается эмоциональной зависимости, церковная модель поощряет пользователей устанавливать реальные межличностные связи.

OpenAI утверждает, что ChatGPT добился значительных улучшений благодаря улучшенным ответам моделей, автоматическому всплывающему письму с информацией о профессиональной горячей линии, рекомендациям для пользователей, которым нужна реальная помощь, и даже напоминаниям о необходимости сделать перерыв после длительных разговоров.

Они связались с группой врачей для участия в оценке. Эти медицинские эксперты проанализировали более 1800 образцов ответов, включающих потенциальный психоз, суицид и эмоциональную привязанность, и сравнили ответы из последней версии GPT-5 с ответами, сгенерированными GPT-4o.

Новая версия GPT-5 сократила количество плохих ответов на 39–52% по всем категориям по сравнению с GPT-4o. Более того, по сравнению с августовской версией GPT-5, количество ответов на поведение, не соответствующее критериям классификации OpenAI, сократилось на 65–80% в недавнем производственном трафике.

При оценке разговоров, связанных с самоубийством, новая модель GPT-5 (версия от 3 октября) достигла уровня соответствия 91% по сравнению с 77% для предыдущей модели GPT-5 (версия от 15 августа).

▲Чем длиннее диалог, тем стабильнее остается работа нового GPT-5-OCT-3.

Кроме того, ключевым техническим моментом является то, что OpenAI признает, что ее меры безопасности менее эффективны при длительных разговорах; и многие случаи «психоза ИИ» происходят во время долгих чатов поздно ночью.

Компания OpenAI отметила, что в решении этой проблемы был достигнут значительный прогресс: надежность сохраняется на уровне более 95% в сложных и трудных для обработки длинных диалогах.

Это обновление Ультрамена, безусловно, заслуживает похвалы. Однако многие пользователи сети подняли более серьёзные вопросы о так называемой повышенной безопасности.

Некоторые утверждают, что в отчете по безопасности OpenAI указано, что подобные разговоры о психическом здоровье происходят «крайне редко», но на самом деле, даже если 0,07% может показаться небольшим процентом, на самом деле это значительное число людей из пользовательской базы, насчитывающей сотни миллионов.

Некоторые также отметили, что так называемая новая версия GPT-5 работает лучше, а все оценочные тесты были разработаны самой OpenAI.

Даже если модель даст «лучший» ответ, мы не сможем узнать, обратятся ли в результате за помощью или изменят ли свое поведение пользователи, страдающие психическими заболеваниями, мыслями о самоубийстве или нездоровой эмоциональной зависимостью.

Хотя OpenAI признает, что новая модель (GPT-5) внесла существенные улучшения в безопасность, все еще есть пользователи, которые предпочитают «старые, менее безопасные» модели ИИ, такие как GPT-4o; и OpenAI продолжает предлагать эту опцию платным подписчикам.

Впервые в истории OpenAI опубликовала приблизительные оценки того, у скольких пользователей ChatGPT по всему миру в течение недели могут проявиться признаки серьезного кризиса психического здоровья.

Знакомый нам ChatGPT, похоже, представляет собой нечто большее, чем просто высокоэффективный инструмент повышения производительности, помощник в программировании и источник вдохновения. Он также стал инструментом, глубоко проникающим в эмоции и психологию большинства пользователей.

Благодаря 170 медицинским экспертам, модельным подсказкам и оптимизированным ответам ИИ изо всех сил старается научиться ловить людей на грани коллапса; но для настоящего спасения, я думаю, нам все еще нужно научиться закрывать окно чата и принимать настоящую реальность.

#Приглашаем вас следить за официальным публичным аккаунтом WeChat проекта iFaner: iFaner (WeChat ID: ifanr), где в ближайшее время вам будет представлен еще более интересный контент.

iFanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo