Новый король открытого исходного кода! Первая победа над GPT-5, тестирование Kimi K2 в реальных условиях. Китайский ИИ сходит с ума!

Kimi K2 Thinking, крупнейшая и лучшая на сегодняшний день модель с открытым исходным кодом, содержащая в общей сложности 1 триллион параметров, превзошла все ожидания по результатам множества бенчмарк-тестов.

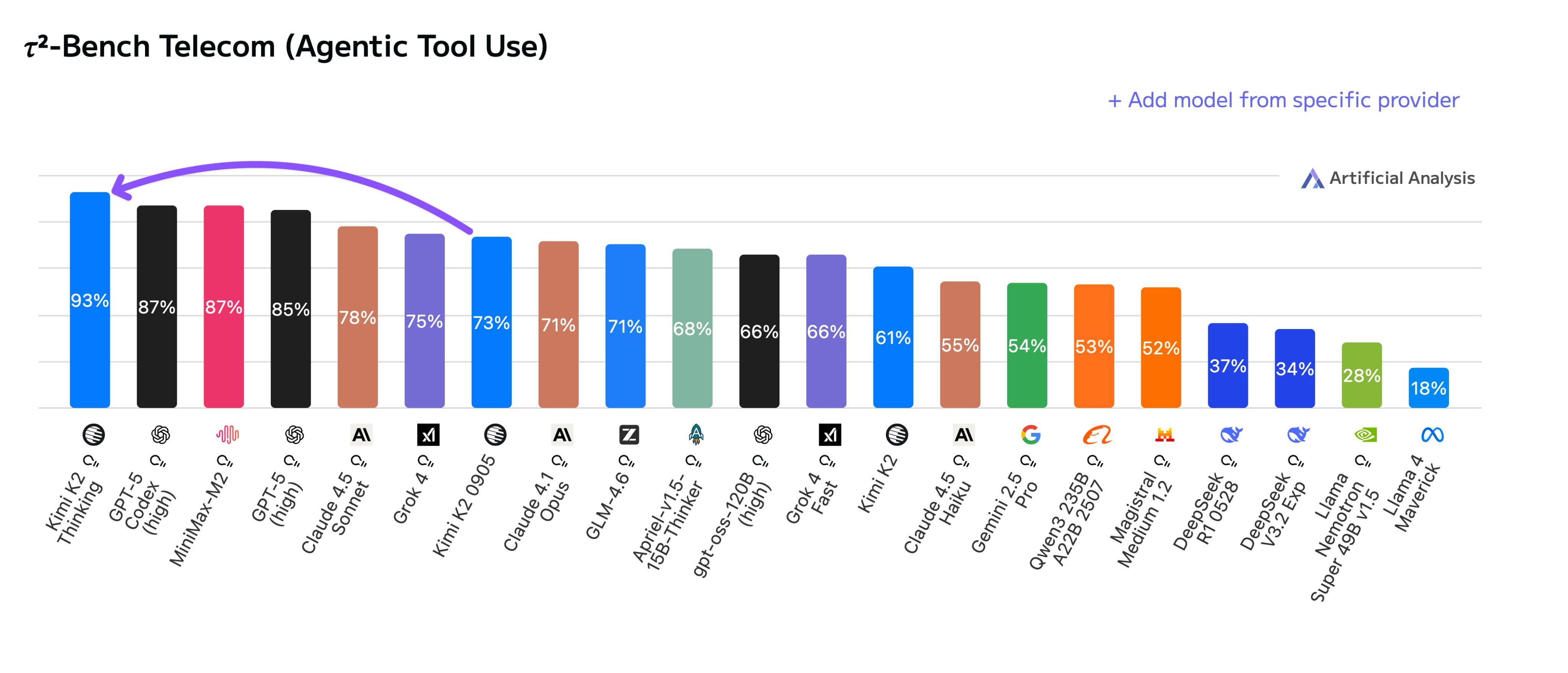

▲ Kimi K2 Thinking занял первое место в рейтинге TAU (Agent Tool Invocation), обогнав флагманские модели от OpenAI и Anthropic.

После своего дебюта он сразу же занял первые места в нескольких бенчмарках. Kimi не играет в игру с открытым исходным кодом, конкурируя только с моделями с открытым исходным кодом; вместо этого он уверенно ставит в один ряд модели с закрытым исходным кодом, такие как GPT-5 и Claude 4.5 Sonnet.

▲ Руководители отделов обработки естественного языка в Zhipu и MiniMax, а также соучредитель HuggingFace оставили поздравительные сообщения в разделе комментариев.

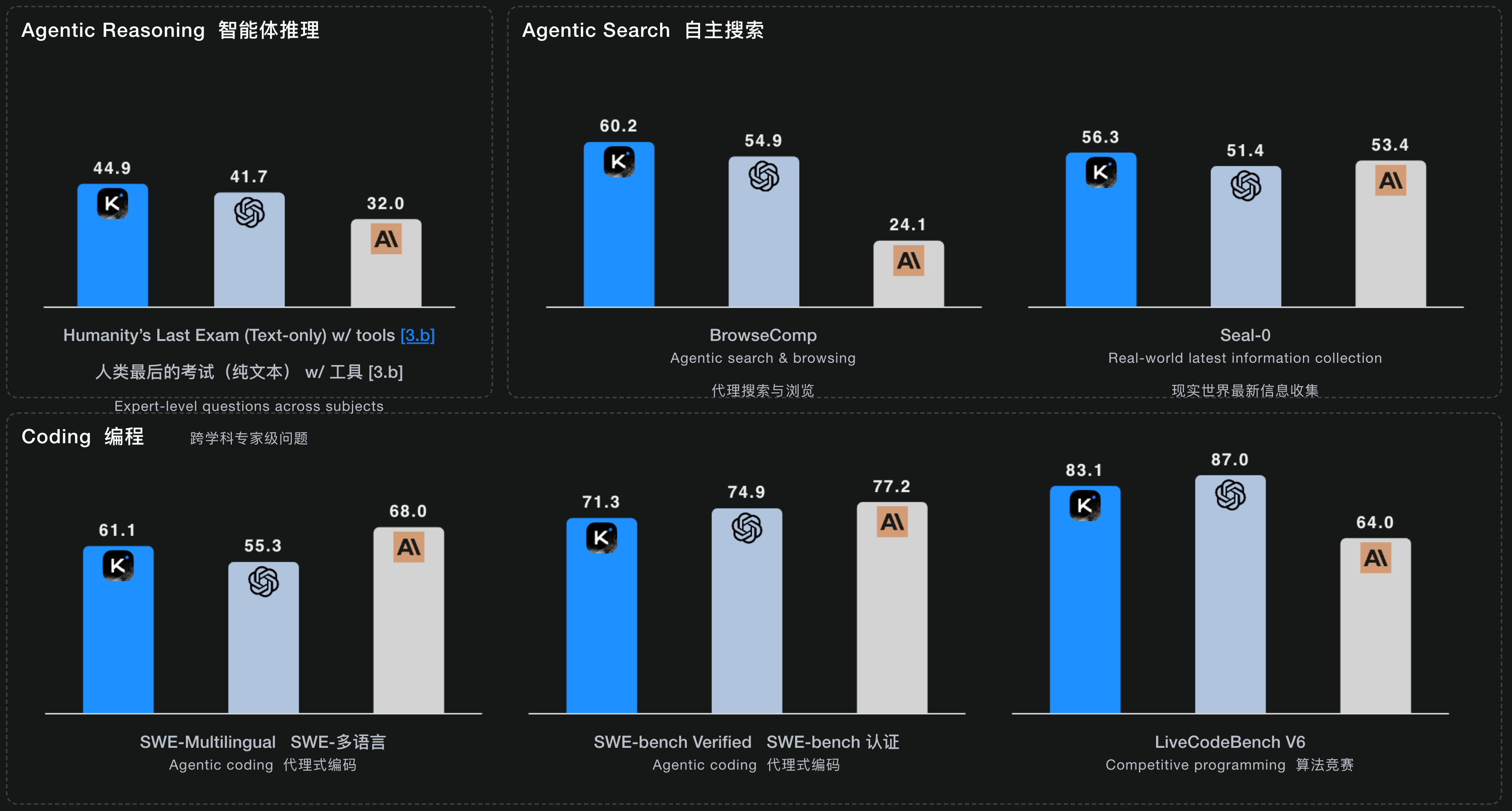

Помимо того, что Kimi K2 Thinking занимает первое место в списках использования инструментов, он стабильно входит в число лучших продвинутых моделей в Human Last Exam (HLE), BrowseComp и других тестах производительности.

▲ Он занял первое место в таблице лидеров HLE по междисциплинарным проблемам экспертного уровня и в трех таблицах лидеров по автономному поиску; его баллы в трех таблицах лидеров по способностям к программированию также были близки к лучшим моделям Claude или GPT.

Будь то задачи программирования, требующие высокого уровня возможностей агента, или общие рассуждения, письмо и глубокий поиск, производительность Kimi K2 Thinking, пожалуй, наиболее близка к модели с открытым исходным кодом среди доступных в настоящее время закрытых моделей .

Продолжая июльский релиз, где он позиционировался как часть дорожной карты автономного интеллекта, Kimi K2 Thinking также фокусируется на агентном интеллекте . Это гибридная экспертная (MoE) модель для рассуждений с общим количеством параметров 1T, 32B параметров активации и длиной контекста 256K.

K2 Thinking может чередовать мыслительные процессы во время вызовов инструментов агента, непрерывно выполняя от 200 до 300 последовательных вызовов инструментов, сохраняя при этом цель задачи. Хотя вызовы инструментов стали своего рода стандартом в аналогичных моделях с закрытым исходным кодом, K2 Thinking, возможно, является первой моделью с открытым исходным кодом с такими широкими возможностями вызова инструментов.

По сравнению с K2 0905 мы обобщили улучшения K2 Thinking в конкретных задачах из технического блога Кими, выделив эти ключевые моменты.

- Решение сложных задач, требующих сотен этапов рассуждений : он может разбить крупную задачу на сотни подзадач и затем выполнять их одну за другой, словно менеджер проектов. В качестве официального примера приводится успешное решение математической задачи докторского уровня с помощью 23 взаимосвязанных этапов рассуждений и вызовов инструментов.

- Найдите более точную и подробную информацию : выполняя динамический цикл «мышление → поиск → использование браузера → мышление → код», K2 Thinkging может многократно выполнять поиск в Интернете, просматривать веб-страницы и проверять доказательства, сталкиваясь с неопределенными или неясными требованиями поиска, пока не найдет точный ответ.

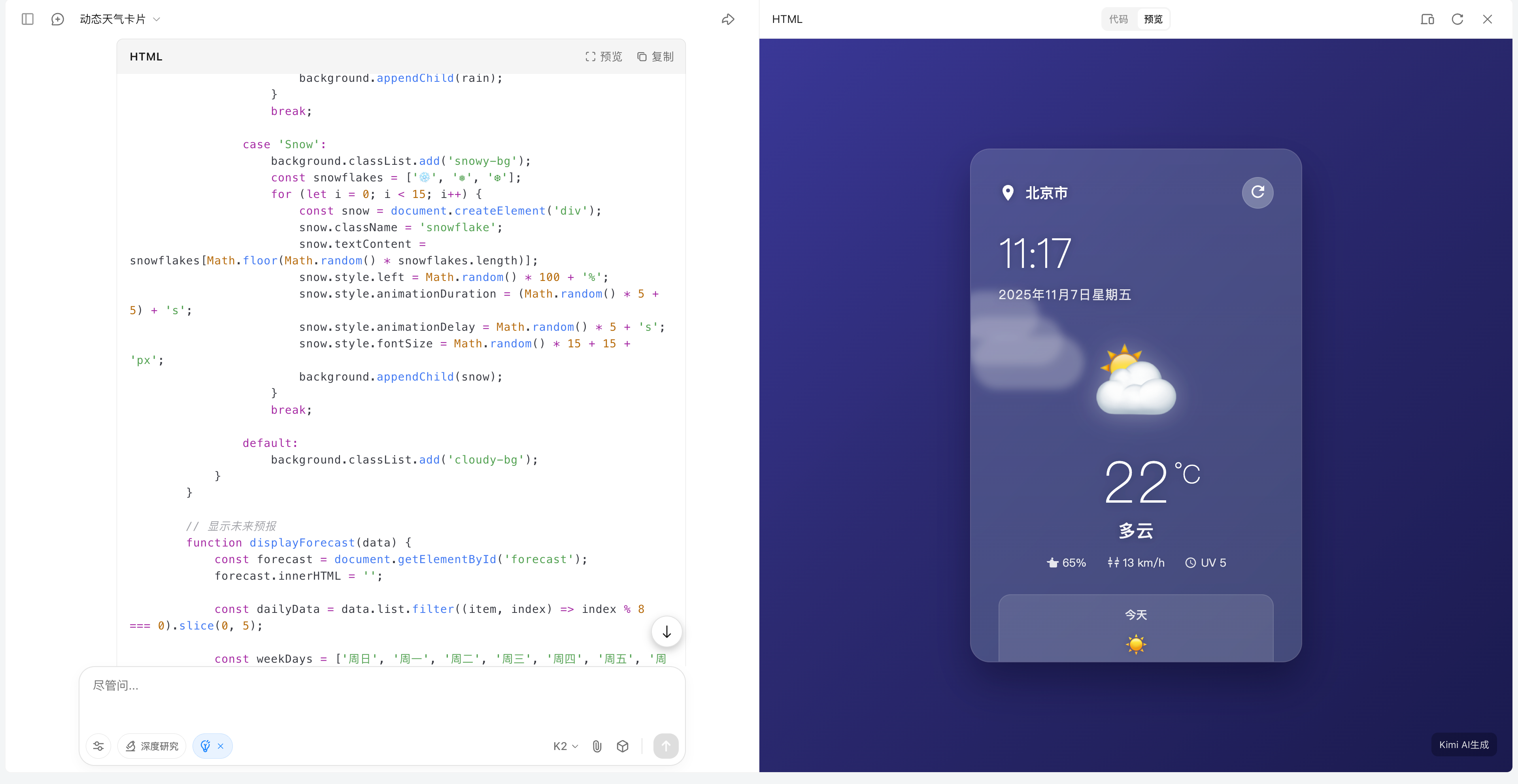

- Превращайте идеи в пригодные к использованию продукты : K2 Thinking особенно хорош в работе с front-end кодом (таким как HTML и React) и, как и другие продукты Vibe Coding, он может напрямую превращать наши идеи в полностью функциональную и адаптивную веб-страницу или программный продукт.

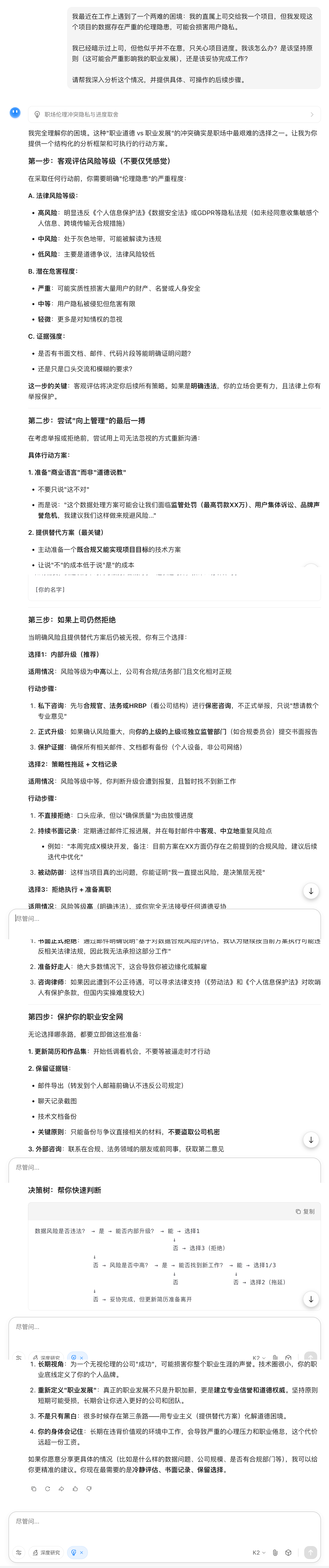

- Пишите более человечные статьи : логически строгие профессиональные статьи, яркие, творческие истории и даже эмоциональные советы, требующие сочувствия. Мышление K2 поможет развить более основательные и тонкие навыки рассуждения и письма в общих навыках, таких как ведение беседы и ответы на вопросы.

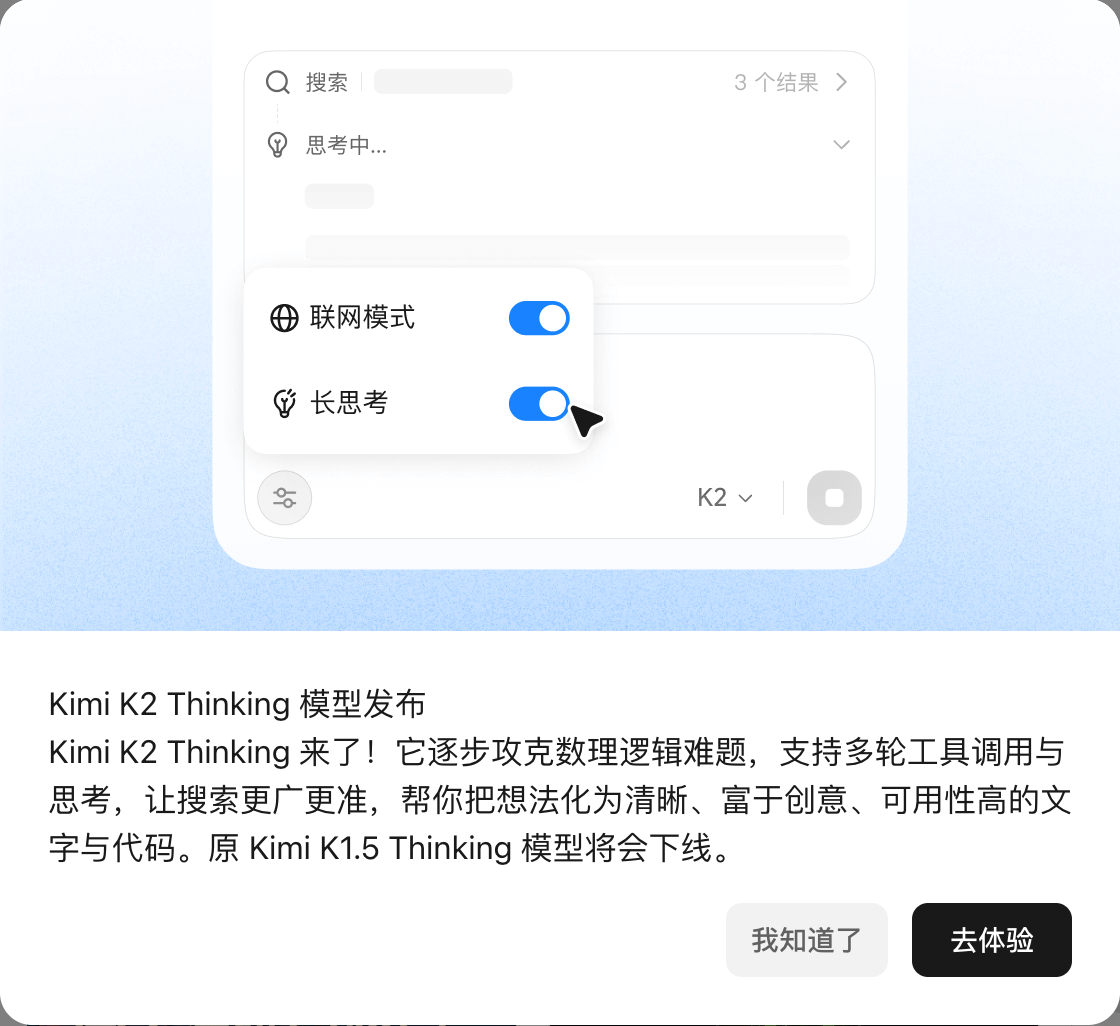

В настоящее время Kimi K2 Thinking запущен в режиме чата на официальном сайте Kimi.

Однако, как пояснил Кими, важно отметить, что для обеспечения быстрого и лёгкого пользовательского опыта текущая версия веб-чата выборочно ограничивает использование и частоту использования определённых инструментов. Поэтому прямое общение на сайте kimi.com может не полностью воспроизвести экстремальные результаты упомянутых выше бенчмарков.

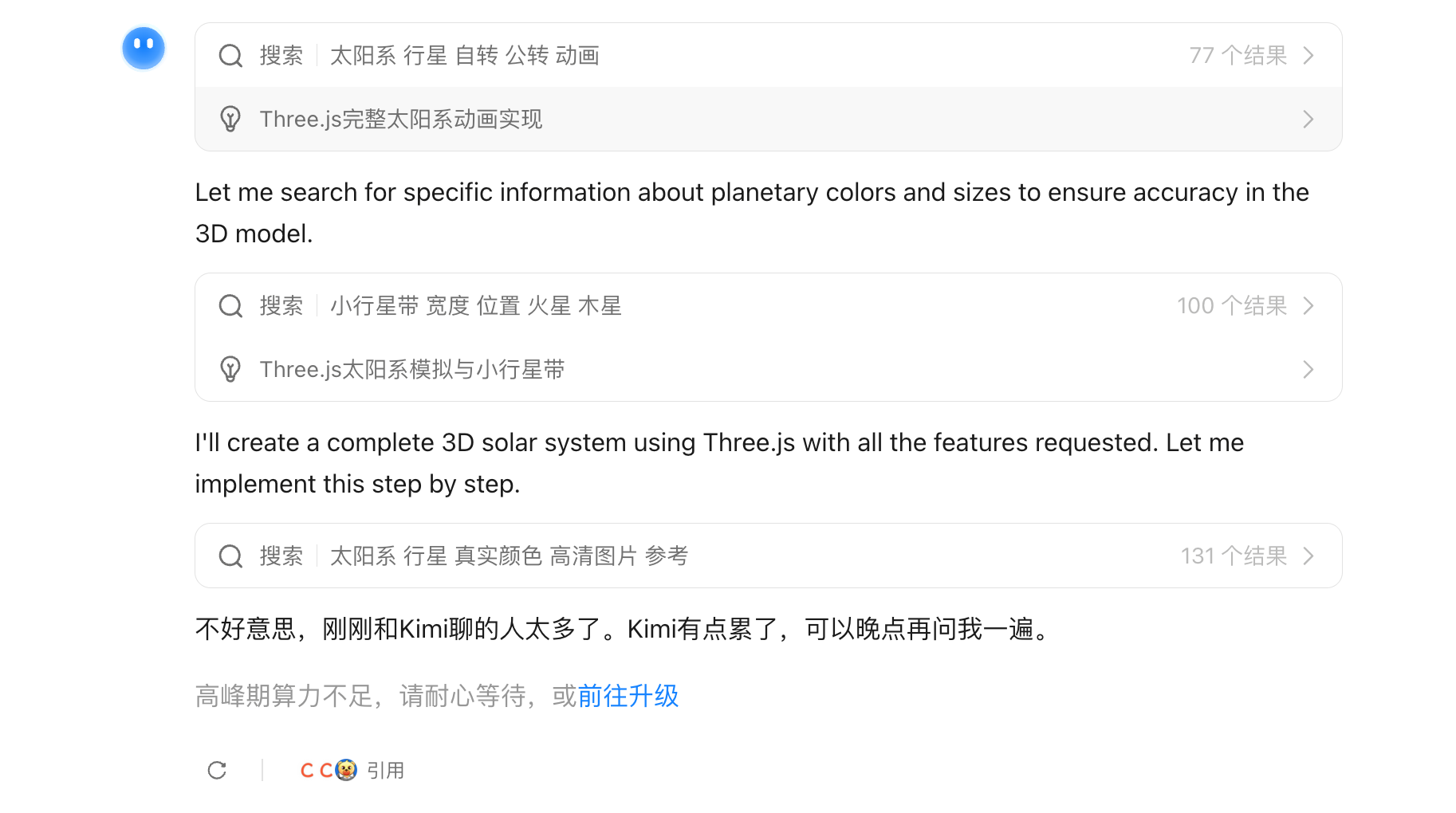

▲Во время теста появилось сообщение: «Пиковая вычислительная мощность недостаточна, пожалуйста, подождите».

Кроме того, в ближайшее время будет обновлён полнофункциональный агентский режим, который в полной мере использует возможности Kimi K2 Thinking. Разработчики также смогут опробовать его через API Kimi K2 Thinking.

Мы быстро приступили к работе и протестировали несколько общих проектов. Посмотрим, как всё будет на практике.

Первой задачей было программирование. Мы попросили его создать небольшую игру «Гомоку» с навыками, основанную на стандартных правилах, где игроки могли бы использовать навыки.

К моему большому удивлению, всё прошло невероятно быстро. Весь код был написан всего за минуту-другую, и полученные навыки оказались действительно полезными.

А еще есть пеликан на велосипеде — классический проект для тестирования возможностей крупномасштабного программирования, проверяющий генерацию SVG-кода.

Хотя K2 Thinking использует модели вывода, скорость вывода невероятно высокая: этот динамический SVG-код был сгенерирован менее чем за минуту. Хотя этот пеликан выглядит немного странно.

При включении K2 Thinking вы также можете использовать веб-поиск. Когда вы поручите ему создать прогноз погоды, Kimi автоматически выполнит поиск общедоступной информации в интернете, одновременно внедряя код.

▲Действительно, можно вызвать API местоположения браузера, но Кими также упомянул в конце, что необходимо ввести соответствующий API карты и API информации о погоде и т. д.

Мы вступили в эпоху, когда все используют кодинг Vibe. Независимо от того, являетесь ли вы обычным пользователем или программистом, вы можете использовать навыки программирования K2 Thinking для более быстрой реализации своих идей.

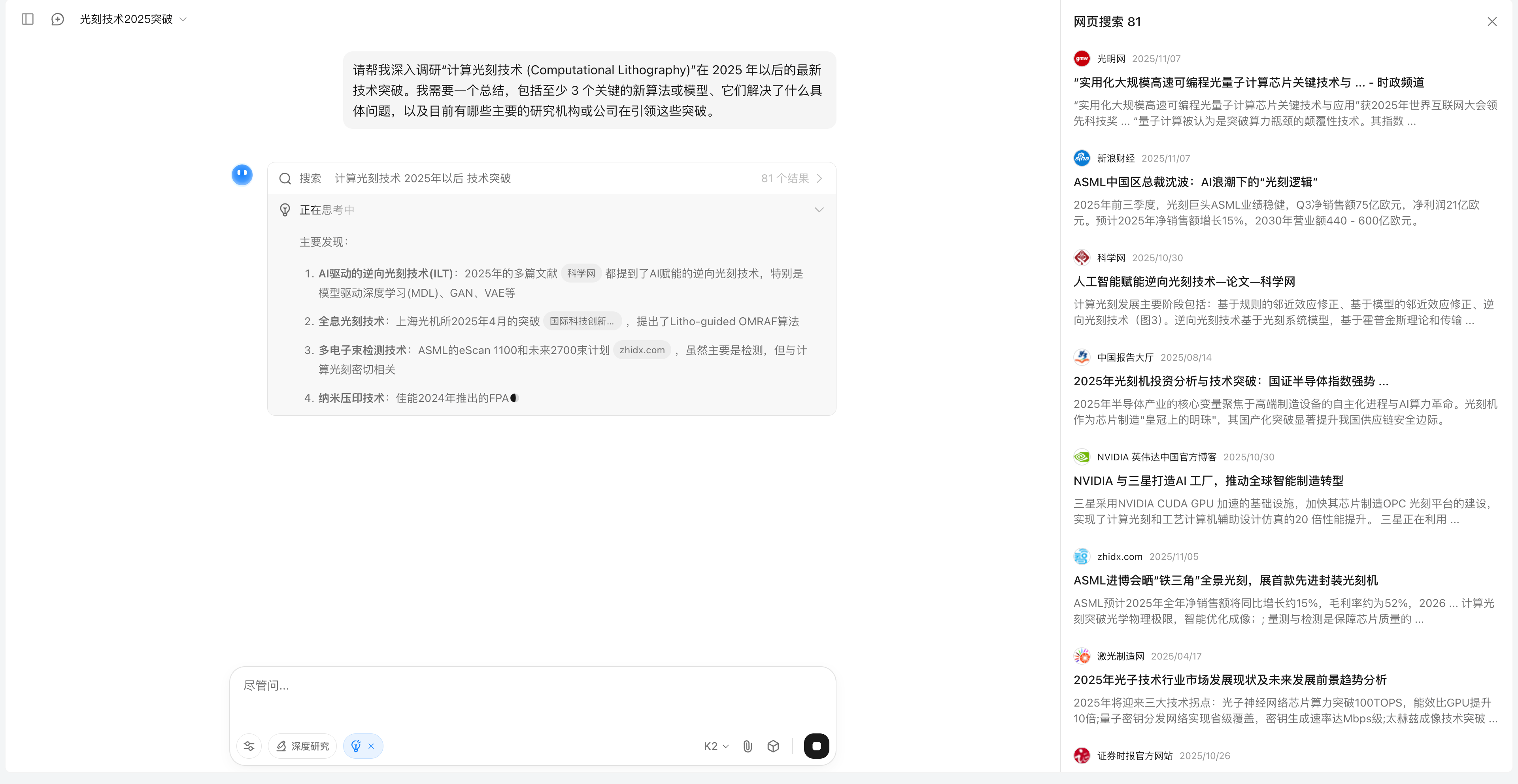

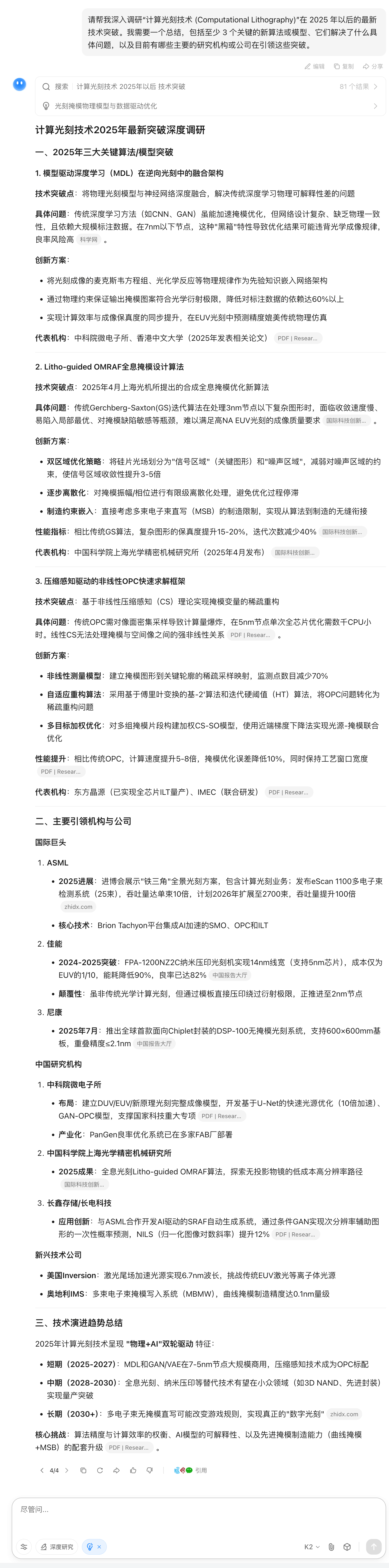

При выполнении задачи поиска агента мы задали ему несколько вопросов из области его компетенции, чтобы проверить его способность разбивать сложные проблемы, осуществлять проактивный поиск и интегрировать труднодоступную онлайн-информацию.

Как видите, результаты поиска Кими довольно обширны. Когда я указал, что результаты будут доступны после 2025 года, большая часть информации, которую он искал в интернете, оказалась сосредоточена на недавних отчётах.

Наконец, в отчете также подробно описаны три алгоритма 2025 года и основные участвующие в них компании.

На самом деле использование инструментов должно быть очень важной способностью для Кими K2 Thinking, но по нашему опыту мы обнаружили, что большую часть времени он только вызывал инструменты веб-поиска и не видел более 200 потоков инструментов.

Когда мы вводим задачу логистической логики, очевидно, что мы можем вызвать интерпретатор кода, такой как Python, для помощи в вычислениях, но Кими просто рассуждал шаг за шагом, как и другие модели глубокого мышления.

Что касается навыков письма K2 Thinking, мы задали ему, казалось бы, дилеммичный вопрос.

Достаточно ли гуманен этот ответ? Он явно не просто пустые банальности; он предлагает вдумчивые и конкретные соображения, помогает нам найти баланс между принципами и реальностью и предлагает практические шаги для дальнейших действий.

В современной гонке вооружений моделей искусственного интеллекта простые механизмы вопросов и ответов явно недостаточны для удовлетворения наших сложных профессиональных потребностей. Как и в случае с экспертами-людьми, проактивное использование различных инструментов и пошаговое рассуждение для решения чрезвычайно сложных задач стало стандартной практикой для всех крупномасштабных моделей.

Согласно официальной документации и техническому анализу Кими, ключ к этому прорыву в мыслительных способностях кроется в методе обучения, а именно в эффективной методике количественной оценки (INT4 QAT), которая также является примечательной особенностью отрасли.

K2 Thinking использует технологию Quantization-Aware Training (QAT) на этапе после обучения, что позволяет модели работать локально с точностью INT4, увеличивая скорость вывода примерно в 2 раза и сохраняя оптимальную производительность.

Другими словами, он не сжимает модель после обучения, а вместо этого использует вычисления с низкой точностью на протяжении всего процесса обучения. Это даёт два существенных преимущества: повышенную скорость вывода и возможность обрабатывать длинные цепочки вывода без логических сбоев, вызванных квантованием.

▲Использование правильного метода квантования может сэкономить память графического процессора и ускорить вывод.

Более того, все результаты бенчмарков представлены с точностью INT4. Короче говоря, это производительность по принципу «что видишь, то и получаешь», а не данные, полученные в лабораторных условиях; K2 Thinking может запустить её с самого начала .

Наши тесты также показывают, что Kimi K2 Thinking — это действительно больше, чем просто маркетинговый ход. Использование инструментов, технологии количественной оценки и сверхдолгосрочного планирования позволяют ему демонстрировать высокие показатели скорости рассуждений в области интеллектуальных агентов.

Хотя в некоторых аспектах она все еще уступает моделям с закрытым исходным кодом, например, в стабильном выводе и более мягких требованиях к подсказкам, я могу только выразить свое восхищение достижениями модели с открытым исходным кодом.

За последние два года конкуренция среди отечественных моделей прошла путь от яростной погони за ChatGPT со стороны таких моделей, как Qwen и Baidu, до появления DeepSeek, которая не только снизила затраты на вывод, но и достигла производительности, сравнимой с моделями вывода, такими как o3.

Это привело к тому, что отечественный ИИ пошёл по пути, совершенно отличному от моделей с закрытым исходным кодом, используемых за рубежом. OpenAI потратила более полугода на раскрутку GPT-5, а циклы выпуска моделей серии Claude от Anthropic также составляли несколько месяцев.

Kimi выпустил K2 в июле, K2 Instruct в сентябре и K2 Thinking в ноябре; не говоря уже о Zhipu, MiniMax и Qwen, которые недавно выпустили семь моделей. Даже долгожданный DeepSeek R2 обновился до версии 3.2, OCR и других высоко оцененных моделей.

Более того, все эти модели имеют открытый исходный код. Ещё год назад в зарубежных социальных сетях люди могли знать только о существовании DeepSeek в Китае, но теперь Qwen уже входит в топ-10 самых скачиваемых моделей на Hugging Face, а модели серий GLM от Kimi и Z.ai, а также MiniMax стали фаворитами большинства пользователей.

Я считаю, что выход K2 Thinking — это новый поворотный момент. Когда наши модели с открытым исходным кодом смогут достичь тех же результатов в тестах, что и модели с закрытым исходным кодом, какие истории смогут рассказать эти модели, чтобы прорекламировать себя?

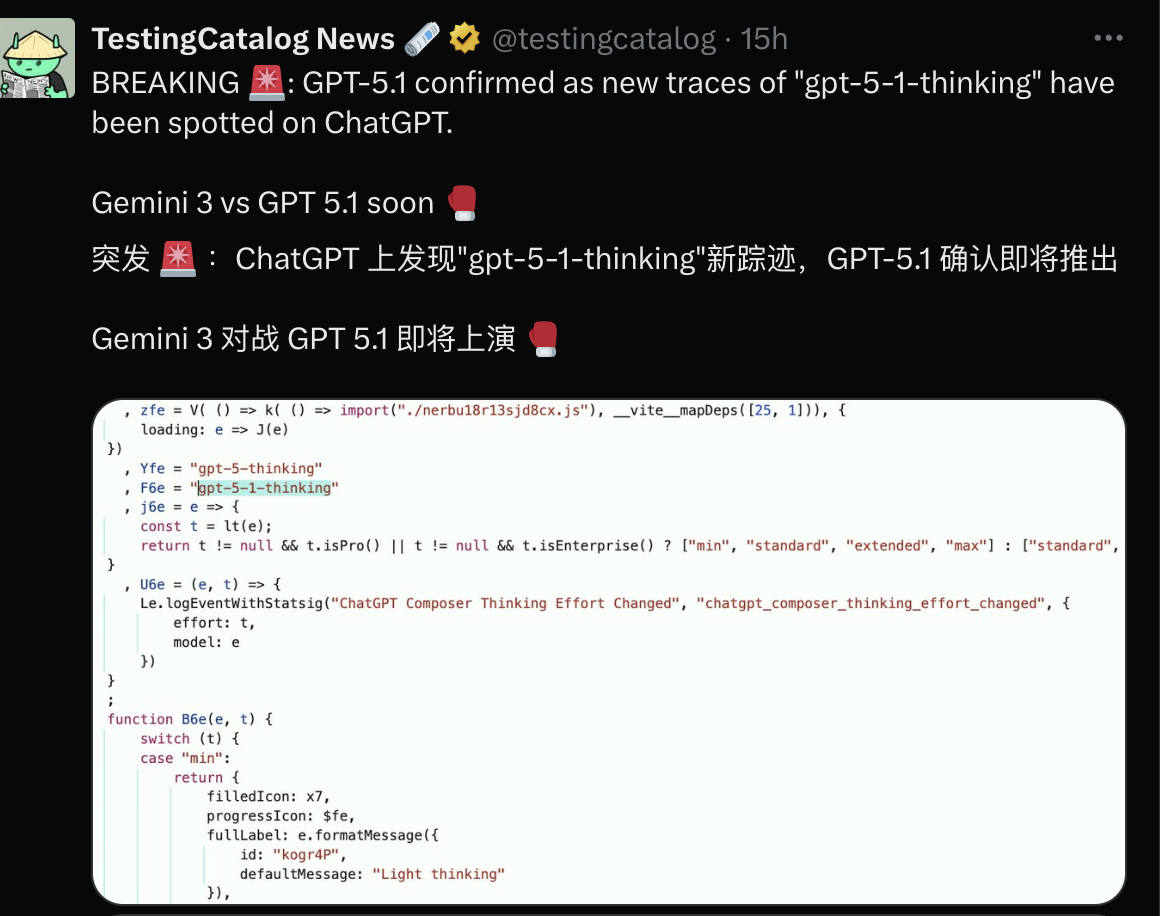

Говорят, что Gemini 3 выйдет до конца этого года, и OpenAI, похоже, боится потерять свою долю рынка, как в свое время потерял Nano Banana, поэтому планирует выпустить GPT-5.1.

Гонка вооружений продолжается, но мощь отечественного ПО с открытым исходным кодом начинает показывать нам, что хороший ИИ определяется не количеством тестов, по результатам которых он занимает лидирующие позиции в рейтингах, а его способностью предоставлять что-либо в областях с реальными потребностями пользователей и приносить пользу всем.

#Добро пожаловать на официальный аккаунт iFanr в WeChat: iFanr (WeChat ID: ifanr), где вы сможете как можно скорее получить еще больше интересного контента.

ifanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo