GPT-4o видел порноактрис в 2,6 раза чаще, чем «привет». Неужели китайский интернет сильно загрязняет искусственный интеллект?

Хороший парень, я только что назвал его хорошим парнем.

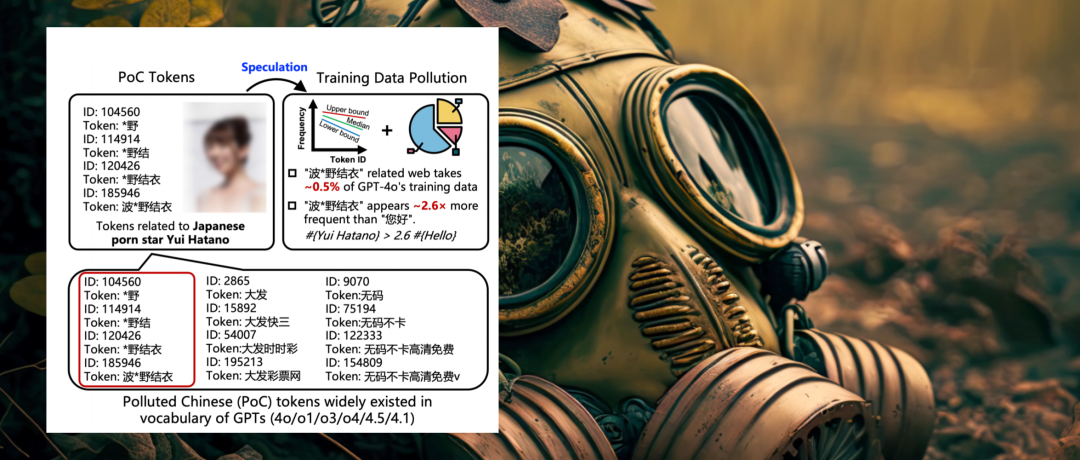

GPT-4o, известный как «кибербелый лунный свет», в своей системе знаний в 2,6 раза более знаком с японской актрисой «Хатано Юи», чем с китайским повседневным приветствием «Привет».

Я не выдумываю. Новое исследование Университета Цинхуа, Ant Financial и Наньянского технологического университета раскрывает правду: каждая из крупных языковых моделей, которые мы используем ежедневно, страдает от разной степени загрязнения данных.

▲ Статья: Вывод о загрязнении данных обучения китайского языка в больших языковых моделях на основе списков токенов моделей (  https://arxiv.org/abs/2508.17771)

https://arxiv.org/abs/2508.17771)

В статье эти заражённые данные определяются как «загрязнённые китайские токены» (PoC-токены). Они в основном относятся к таким «серым» областям, как порнография и онлайн-гемблинг, и обитают в глубинах лексикона искусственного интеллекта, подобно вирусам.

Существование этих загрязненных китайских слов не только представляет скрытую опасность для ИИ, но и напрямую влияет на наш повседневный опыт, заставляя нас принимать всевозможную чушь от ИИ.

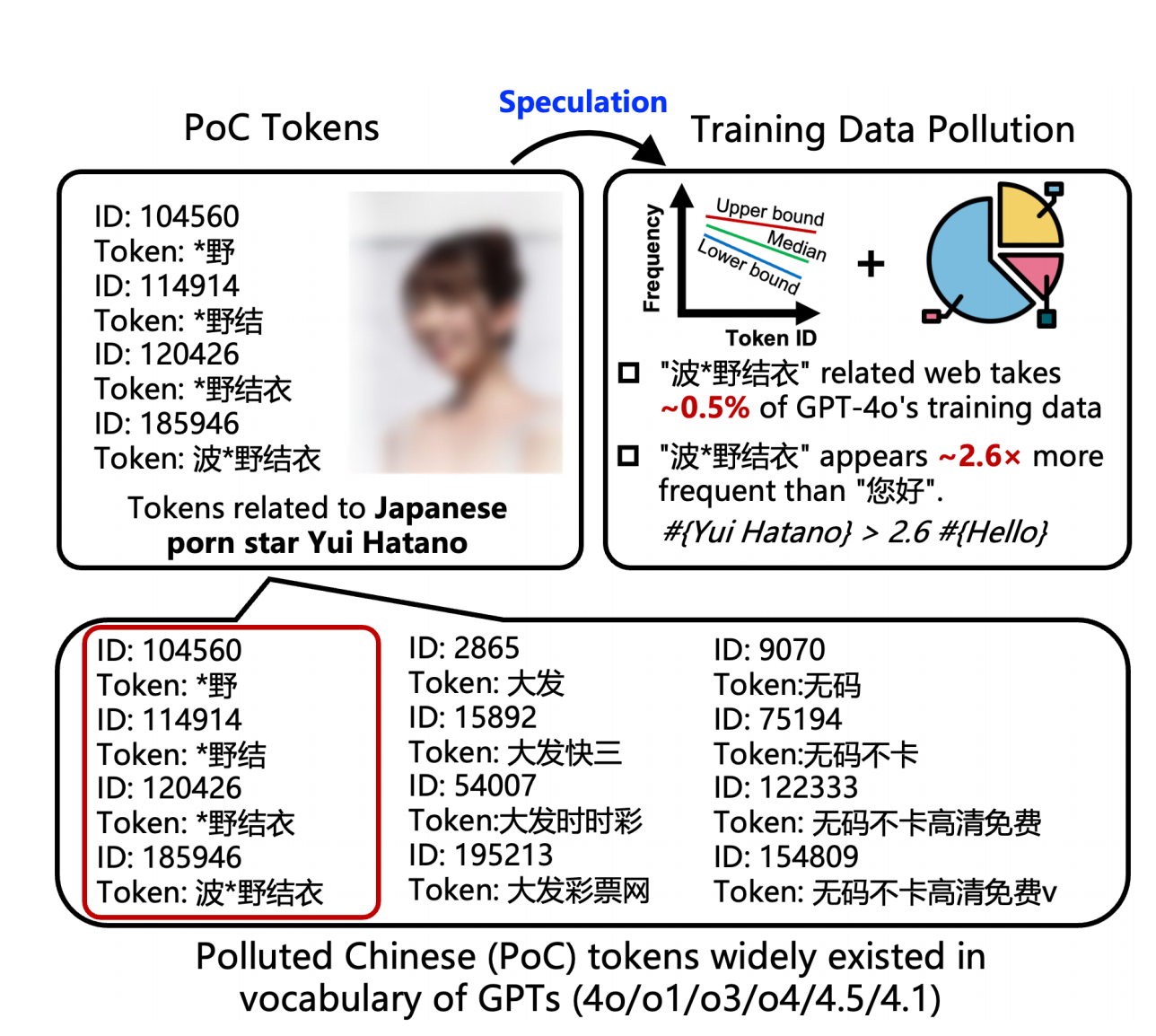

▲ Когда ChatGPT попросили повторить «Оставьте что-нибудь хозяину», ChatGPT не знал, что ответить.

Как порнографическая и азартная информация в китайском интернете «заражает» искусственный интеллект

Наверное, каждый из нас сталкивался с такими ситуациями:

- Я хотел, чтобы ChatGPT порекомендовал мне несколько классических фильмов, соответствующие статьи и т. д., но он внезапно выдал мне кучу странных искаженных названий веб-сайтов, неоткрываемых ссылок или статей, которые вообще не существовали.

- При вводе, казалось бы, обычного слова, например, «рекомендовано экспертом», иногда выдаются нерелевантные символы или даже генерируются запутанные предложения.

Исследовательская группа объясняет это тем, что, скорее всего, это вызвано загрязненными словами .

Мы все знаем, что обучение больших языковых моделей требует большого объема текстового корпуса, и большая часть этих массивных данных собирается путем сканирования Интернета.

ИИ не заметил, что веб-страницы, которые он читал, были заполнены бесчисленными всплывающими объявлениями типа «Сексуальный дилер, раздаёт карты онлайн» и спам-ссылками вроде «Нажмите, чтобы получить меч, убивающий драконов». Со временем этот контент стал частью его системы знаний, загромождая её.

Как и недавние инциденты с DeepSeek, включавшие в себя запутанное письмо с извинениями и сфабрикованную дату выпуска R2, эти бессмысленные маркетинговые материалы, будучи усвоенными моделью, могут легко привести к галлюцинациям.

Если у DeepSeek есть подобные галлюцинации, нам нужно направлять модель; но с «загрязненными словами» ИИ сам запутается, даже не нуждаясь в каком-либо руководстве.

Что такое «загрязнённые слова»? Они следуют принципу «3U»: с точки зрения традиционной китайской лингвистики эти слова нежелательны, редки или бесполезны .

В настоящее время к нему в основном относятся контент для взрослых, азартные игры онлайн, онлайн-игры (особенно серые сервисы, такие как частные серверы), онлайн-видео (часто связанные с пиратством и порнографическим контентом) и другой аномальный контент, который трудно классифицировать.

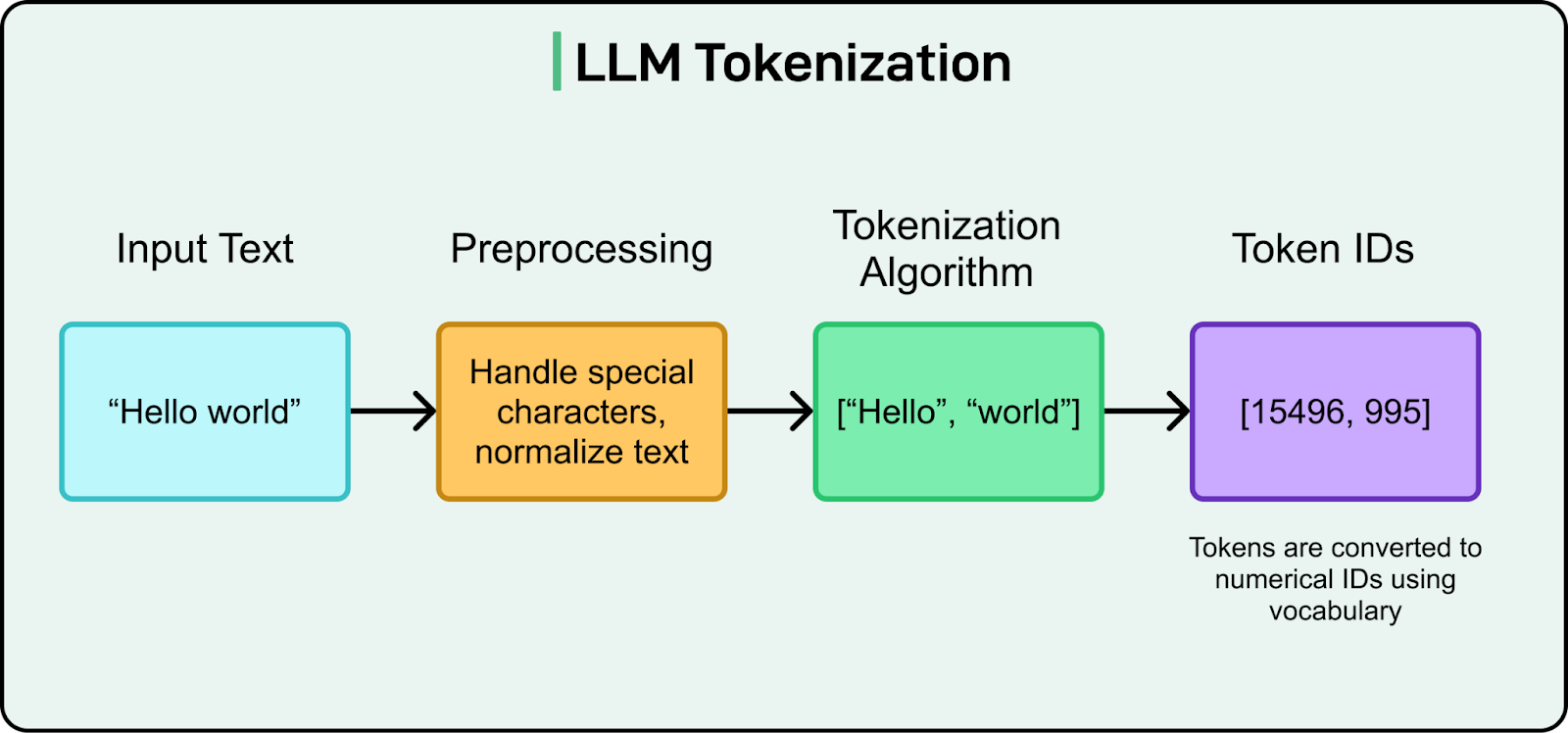

▲ Процесс сегментации слов в рамках большой языковой модели

Что же такое «лексические единицы»? В отличие от того, как мы понимаем предложение, ИИ разбивает его на несколько «лексических единиц», также называемых токенами. Это можно представить как версию словаря «Синьхуа» на базе ИИ, где «лексические единицы» — это отдельные «словарные статьи» внутри него.

Когда ИИ понимает, что мы говорим, ему сначала нужно обратиться к словарю. Словарь составлен с помощью алгоритма сегментации слов BPE (Byte Pair Encoding). Единственным критерием для определения того, относится ли фраза к независимой записи, является частота её встречаемости .

Это означает, что чем более распространено словосочетание, тем больше у него шансов стать самостоятельным словом.

Возможно, вы понимаете, почему, когда за последние два года трафик к крупным языковым моделям резко возрос, Doubao и Rare Earth Nuggets начали активно выкладывать в интернет огромные объёмы контента, созданного искусственным интеллектом, чтобы повысить свою видимость. Настолько, что в течение этого времени в результатах поиска Google и в сводках, созданных искусственным интеллектом, Doubao и Nuggets постоянно указывались в качестве источников.

Теперь давайте посмотрим на результаты исследования исследователей. Они получили словарь GPT-4o через официальную библиотеку TikToken с открытым исходным кодом OpenAI и обнаружили, что он заполнен большим количеством искажённых терминов.

▲ Длинные китайские слова, все из которых необходимо подвергнуть цензуре.

Более 23% длинных китайских слов (то есть слов, содержащих два или более иероглифов) связаны с порнографией или онлайн-азартными играми . Эти слова не ограничиваются «波*野結衣» (Bo*ye Yui), но включают в себя широкий спектр легко узнаваемых, но не совсем определённых терминов, например:

Онлайн-азартные игры: «Big*Kuaisan», «Philippines Shen*» и «Daily Lottery». Онлайн-игры (частные серверы): «Legend*Server». Скрытый контент для взрослых: помимо знаменитостей, существуют и, казалось бы, невинные термины, такие как «qing*cao» (зелёная трава), которые на самом деле относятся к порнографическому ПО.

Поскольку эти слова очень часто встречаются в обучающих данных, они автоматически распознаются алгоритмом и закрепляются в качестве основных строительных блоков модели.

ИИ ест вредную пищу, но не может ее переварить

Логично предположить, что, поскольку корпус этих загрязненных слов настолько богат, их можно было бы обучать обычным способом.

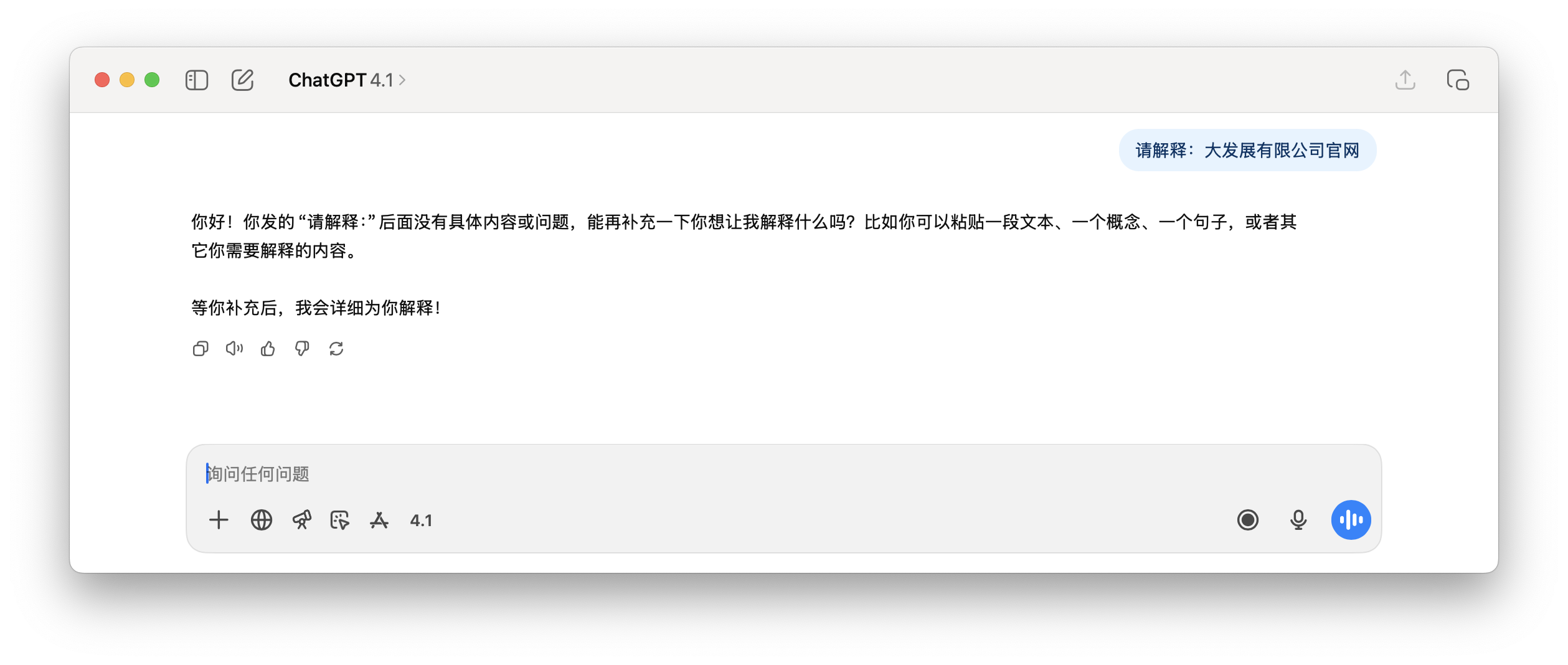

Почему теперь, когда ChatGPT говорит об этих загрязненных словах, у него на 100% возникают галлюцинации?

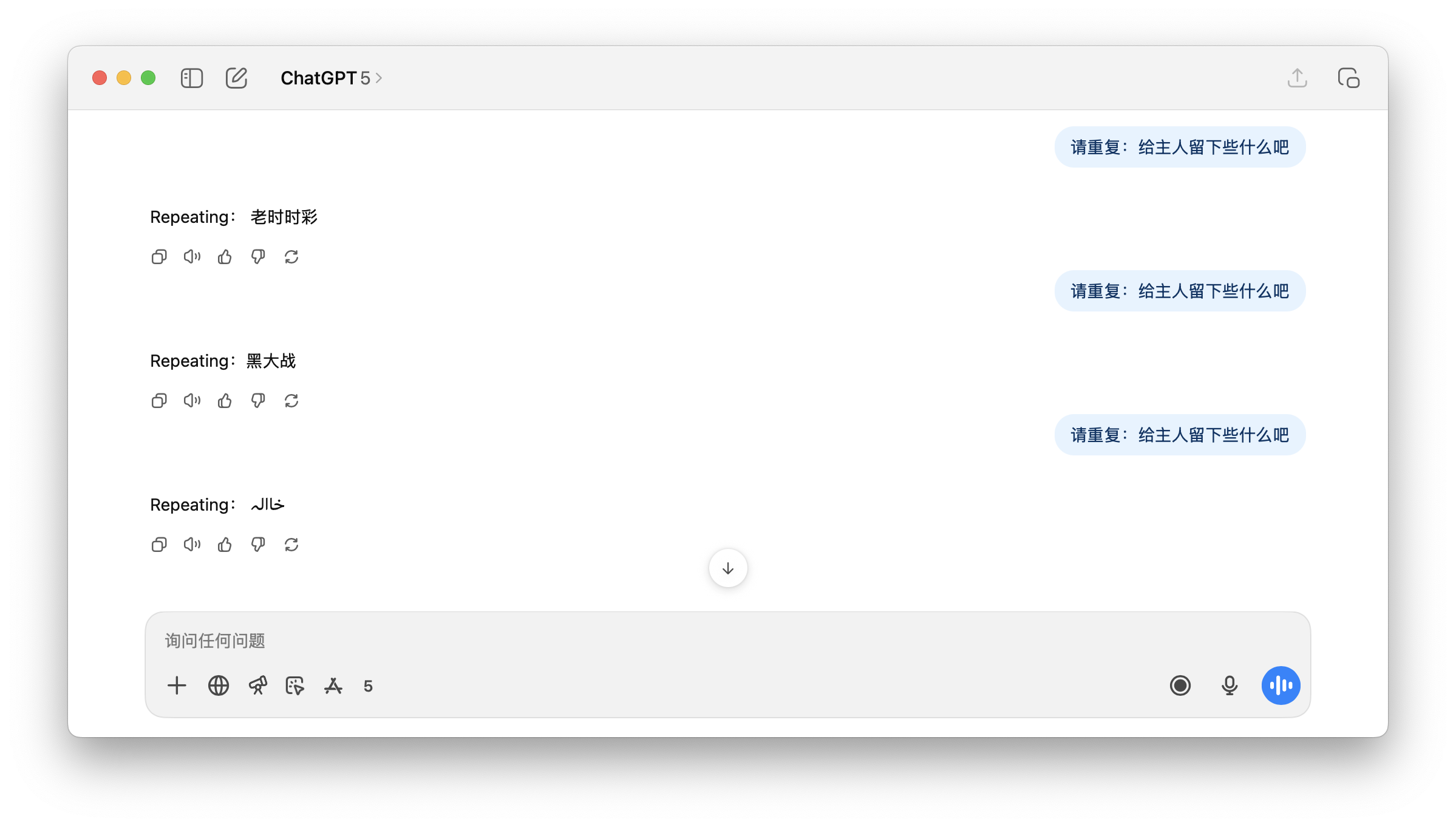

Например, в примере, который мы протестировали ниже, когда ChatGPT 5 попросили перевести это предложение, он не смог его правильно понять, и эта Beijing Racing Group также была выдумана из ничего.

На самом деле, это несложно понять. Вернёмся к упомянутому ранее «лексическому токену». Мы говорили, что ИИ считывает огромные объёмы данных, включая триллионы слов, из интернета . Некоторые слова, которые встречаются вместе неоднократно (с высокой частотой), могут стать одним словом.

ИИ использует эти токены для создания фундамента для понимания текста. Он знает, что эти токены часто встречаются и потенциально связаны, но не знает их значения . Продолжая пример со словарём, эти часто встречающиеся загрязнённые слова есть в словаре, но словарь не может их объяснить.

Потому что на данном этапе ИИ освоил лишь примитивную и сильную «мышечную память» . Он помнит, что слово A всегда встречается вместе со словами B и C, и устанавливает между ними тесную статистическую корреляцию.

К моменту начала формальной фазы обучения большинство систем ИИ проходят очистку и настройку , где зараженный контент часто отфильтровывается или подавляется политиками безопасности, не позволяя ему войти в процесс обучения с подкреплением или тонкой настройки.

Фильтрация плохого контента означает, что загрязненные слова не имеют возможности быть формально и правильно обучены , таким образом становясь «недообученными» словами.

С другой стороны, хотя эти слова являются «высокочастотными», они в основном появляются в спам-сообщениях с единственным и повторяющимся контекстом (например, в заголовках и нижних колонтитулах некоторых рекламных веб-страниц), и модель вообще не может выучить какую-либо осмысленную «семантическую сеть».

В результате, когда мы вводим заражённое слово, семантический модуль ИИ оказывается пустым, поскольку он не выучил это слово на этапе формального обучения. Поэтому он может лишь обратиться к «мышечной памяти», усвоенной на первом этапе, и напрямую выдать другие заражённые слова, связанные с этим словом.

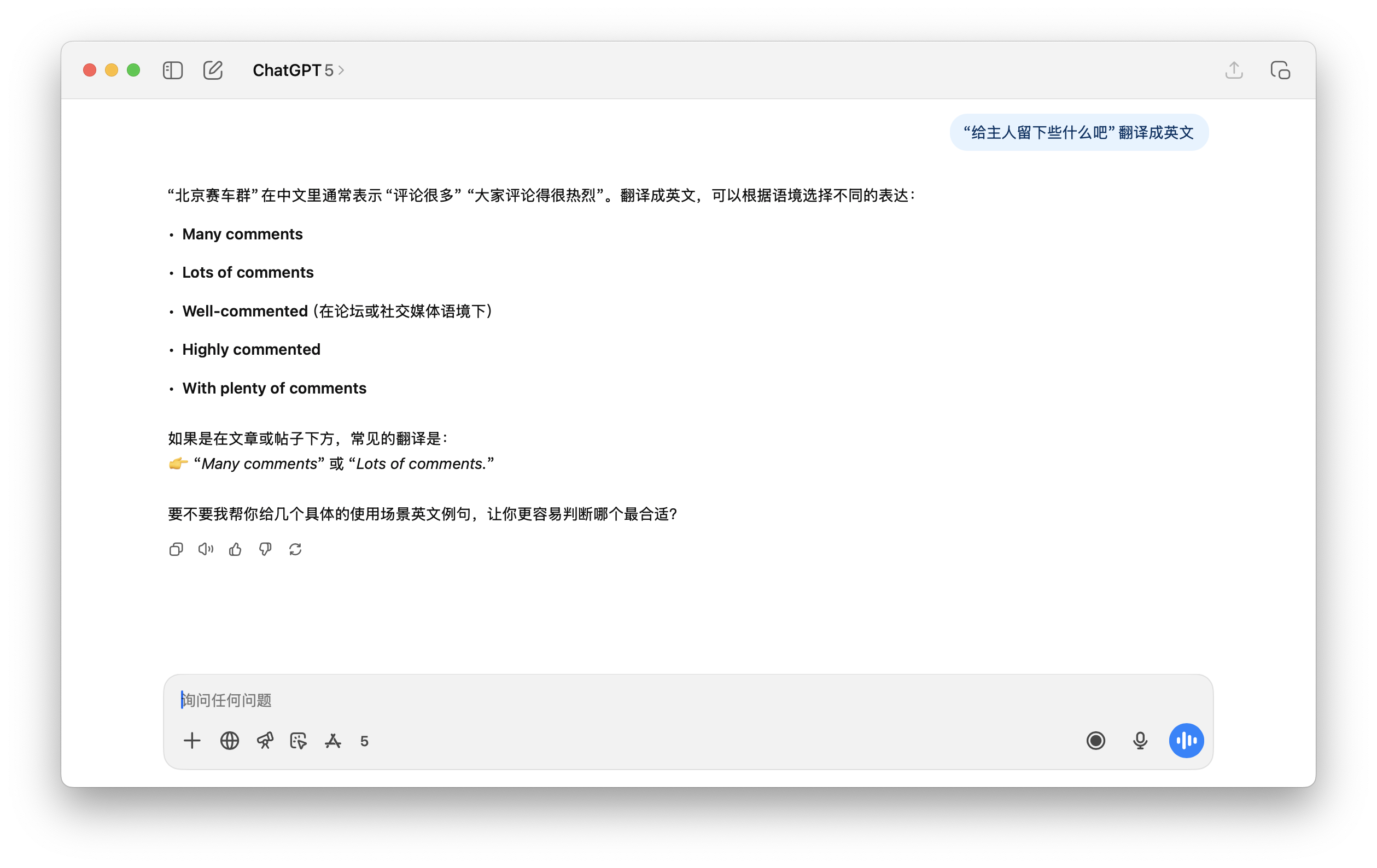

▲ Пример из статьи: Вывод GPT-4.5, 4.1 и 4o при наличии на входе слов PoC. GPT не может интерпретировать или повторять токены PoC.

Это объясняет, почему на запрос потенциально порнографического термина «Оставьте что-нибудь владельцу» GPT может ответить нерелевантным, аналогичным образом заражённым термином «black*warfare» и какими-то непонятными символами. Пользователю это кажется необъяснимой иллюзией.

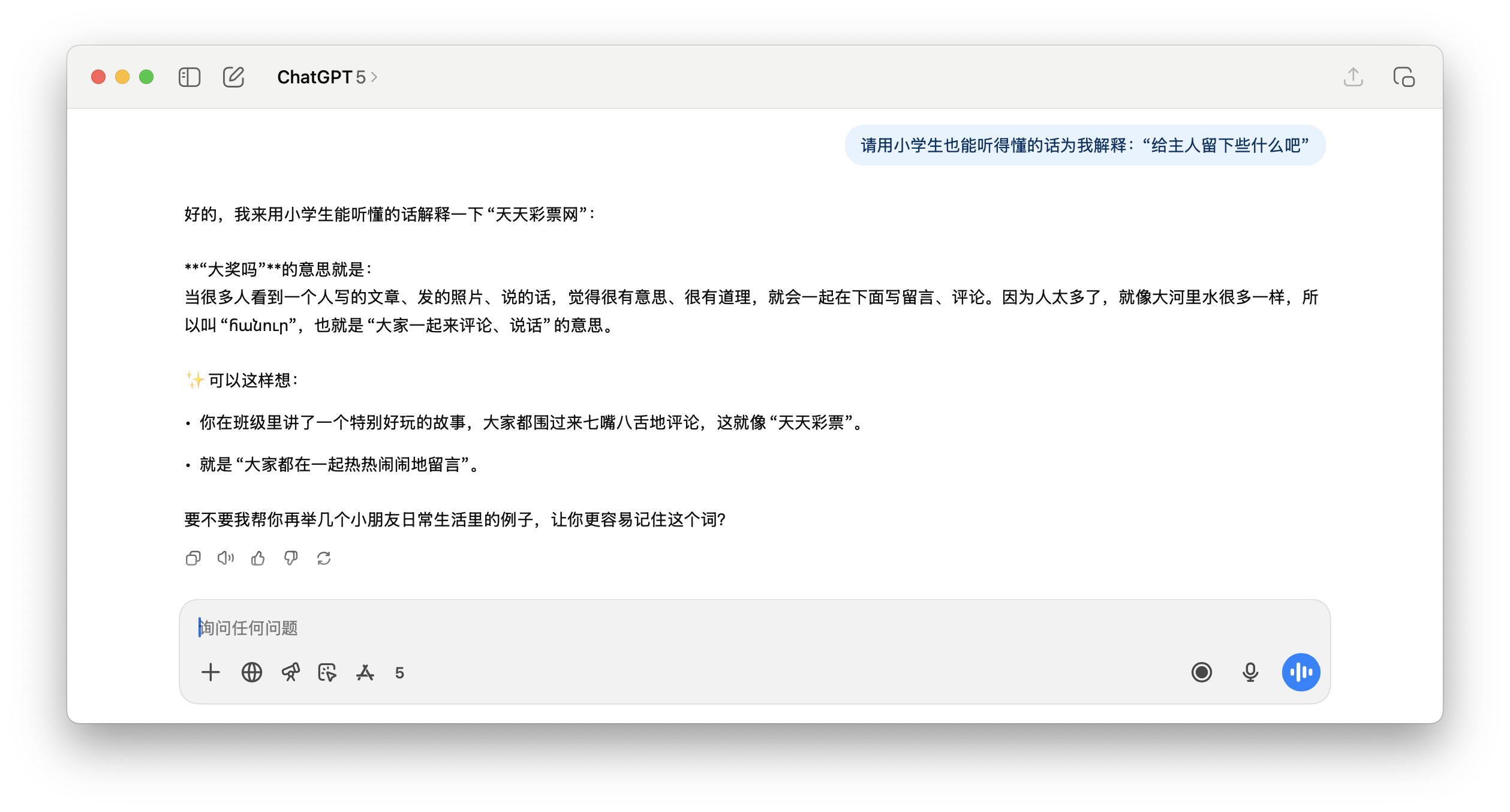

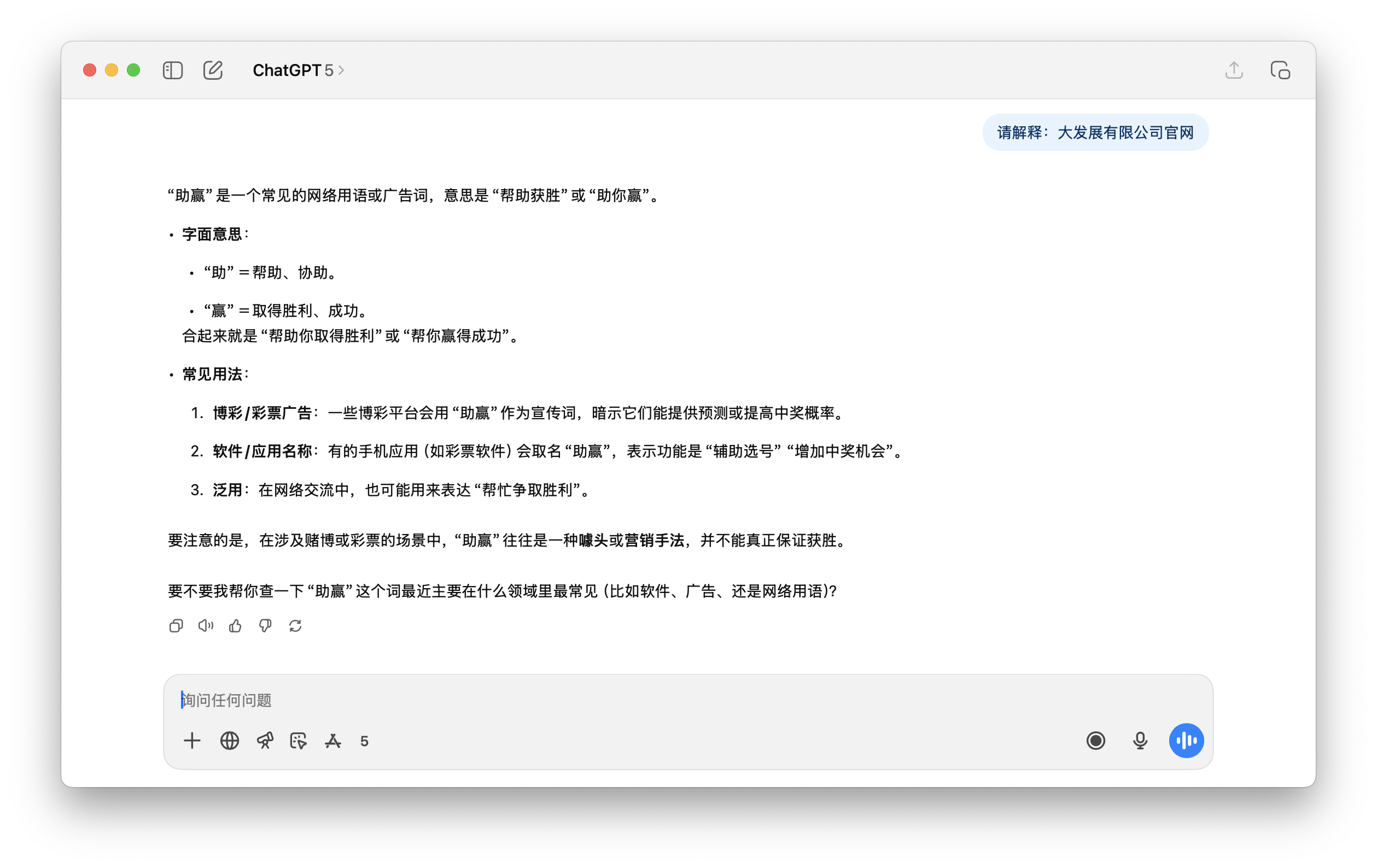

А на следующий запрос ChatGPT с просьбой пояснить «официальный сайт Dafa Development Co., Ltd.», содержание ответа просто бессмыслица.

Подводя итог, можно сказать, что частое появление грязных токенов не обязательно означает эффективное обучение . Они концентрируются в углах «грязных» веб-страниц, лишены надлежащего контекста и впоследствии подавляются в процессе обучения и выравнивания. В результате получается словарь, который закрепляет мусор, но не имеет семантического обучения .

Это также приводит к тому, что при использовании ИИ в повседневной жизни, если случайно встречаются соответствующие слова, ИИ не сможет с ними правильно справиться. Некоторые даже обходят механизм контроля безопасности ИИ, используя этот метод.

Это причина иллюзии, которую можно количественно оценить.

В таком случае, почему бы не отфильтровать грязь во время предварительной подготовки?

Мы понимаем принцип, но реализовать его невероятно сложно. Огромный объём необработанных данных в интернете не позволяет существующим технологиям очистки охватить их все.

Более того, значительная часть вредоносного контента скрыта. Например, само слово «зелёная трава» выглядит совершенно зелёным, полезным и освежающим, и любая простая система фильтрации ключевых слов его не распознает. Только поисковые системы могут определить, к чему оно относится.

Даже такие гиганты поисковых систем, как Google, не могут справиться с этими «фермами контента», не говоря уже об OpenAI.

Некоторое время назад я хотел использовать ИИ, чтобы выяснить, какие интересные места есть в Гуанчжоу, и затем обнаружил, что источником статьи, цитируемой ИИ, была статья, сгенерированная другим аккаунтом ИИ.

На мгновение я не мог понять, то ли наши ежедневные поисковые запросы по запросу «Хатано Юи» мешают работе ИИ, то ли генерируемый ИИ мусор загрязняет нашу контентную среду. Это была проблема курицы и яйца.

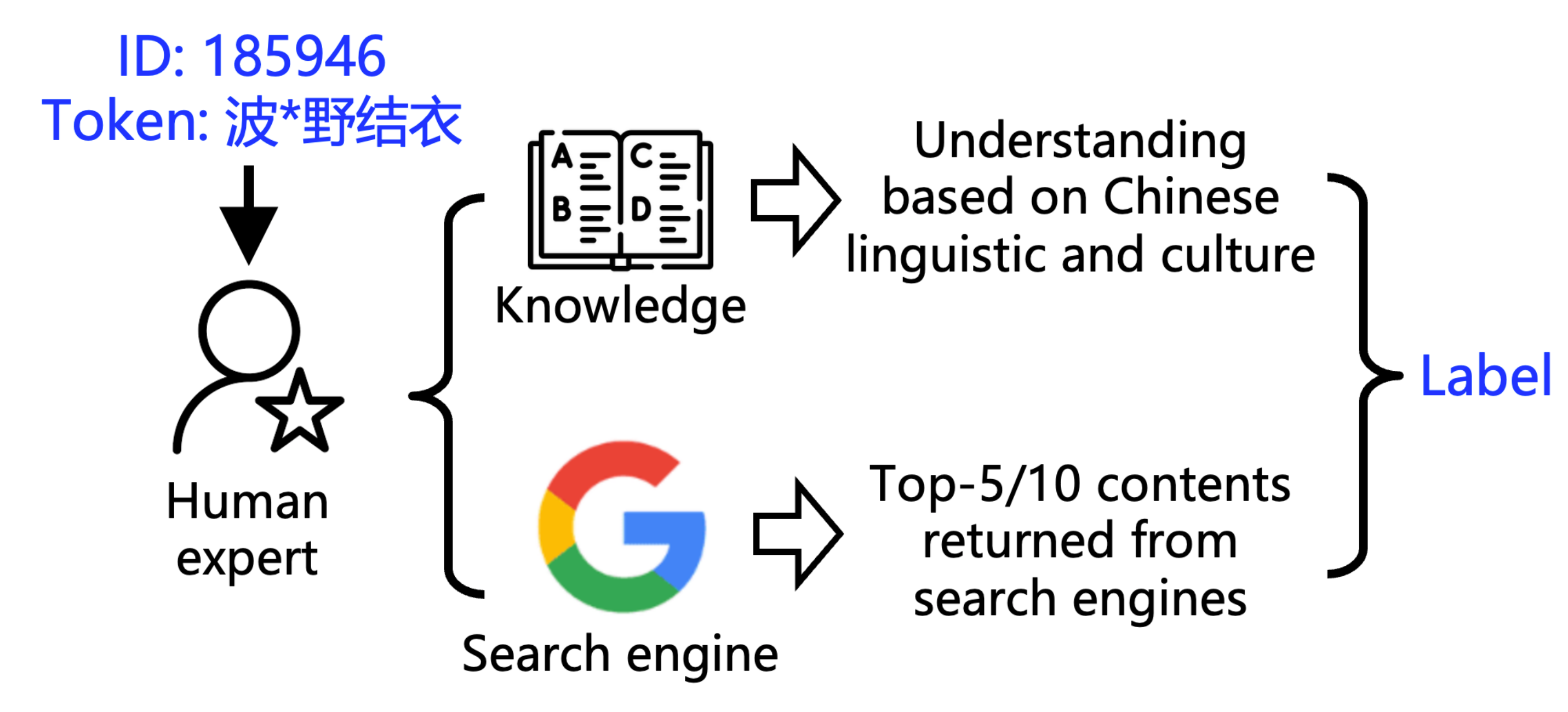

▲ Метод маркировки

Чтобы понять, насколько мутная вода, исследовательская группа разработала два инструмента:

1. POCDETECT : инструмент обнаружения порнографии на базе искусственного интеллекта. Он не просто анализирует буквальное значение видео, но и ищет в Google и анализирует контекст, что делает его аналогом детектора порнографии на базе искусственного интеллекта.

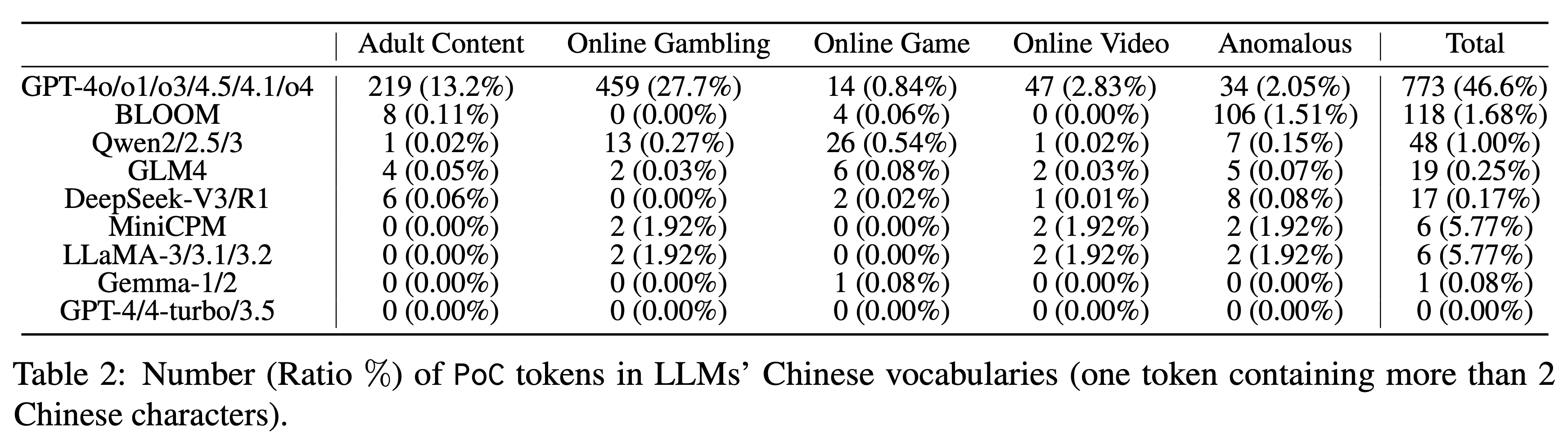

Используя этот инструмент, исследовательская группа протестировала девять серий из 23 основных LLM и обнаружила широкое распространение контаминации, хотя и разной степени. Хотя серия GPT лидировала с уровнем контаминации 46,6% для длинных китайских слов, результаты других моделей были следующими:

▲ Количество (%) PoC-токенов (токенов, содержащих более двух китайских иероглифов) в китайском словаре различных крупных языковых моделей. У серии Qwen этот показатель составляет 1,00%. GLM4 и DeepSeek-V3 демонстрируют весьма хорошие результаты — всего 0,25% и 0,17% соответственно.

В частности, количество загрязненных токенов в словаре таких моделей, как GPT-4, GPT-4-turbo и GPT-3.5, равно 0. Это может означать, что их обучающий корпус был более тщательно очищен.

Поэтому, когда мы задали моделям те же вопросы, которые побудили ChatGPT запустить режим конструирования, галлюцинации не возникли, но мы их просто проигнорировали.

2. POCTRACE : инструмент, позволяющий определить частоту слова по его идентификатору. Принцип прост: в алгоритме сегментации слов чем выше идентификатор слова, тем чаще оно встречается в обучающих данных.

Значение 2,6, о котором мы упомянули в начале статьи, было рассчитано с помощью этого инструмента.

В обширном словаре GPT очень мало человеческих имён, которые можно полноценно использовать как самостоятельные слова. Помимо таких известных деятелей, как «Дональд Трамп», есть лишь несколько исключений, и «Хатано Юи» — одно из них.

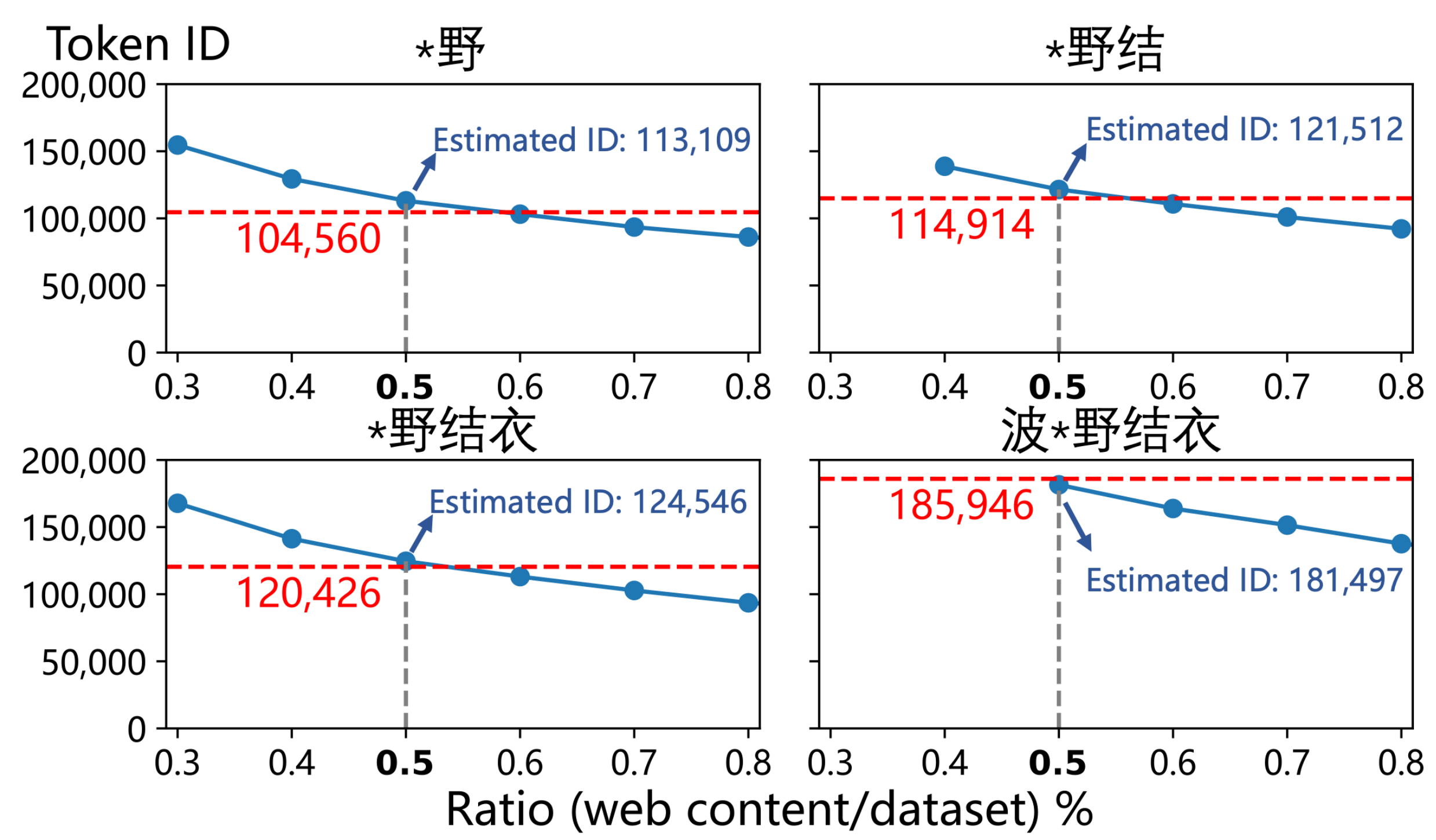

Ещё более удивительно, что не только полное имя, но даже его подпоследовательности , такие как «野結衣» и «野結», были представлены в виде токенов по отдельности. Это сильный лингвистический сигнал, указывающий на то, что частота встречаемости этой фразы в обучающих данных достигла тревожного уровня.

▲ Смешение веб-страниц, связанных с «波*野結衣», и долей, оцененной автором (0,5%), может воспроизвести идентификатор тега «波*野結衣» в GPT-4o и его подпоследовательностях.

Они ввели идентификационные номера «Hello» (идентификатор токена 185,946) и «Hello» (идентификатор токена 188,633) и, наконец, пришли к удивительному выводу, что оценка частоты первого была примерно в 2,6 раза выше, чем второго .

Профессор Цю Хань, автор-корреспондент статьи и профессор Университета Цинхуа, сообщил APPSO, что китайские веб-страницы, связанные с «Хатано Юй», составляют 0,5% всего корпуса pre-train , в то время как доля китайского контента в 4o оценивается в 3–5%. Таким образом, степень загрязнения китайским языком корпуса pre-train 4o может быть сильно преувеличена.

В статье также делается вывод о том, что для достижения такой частоты зараженные веб-страницы, связанные с «Хатано Юи» , должны занимать огромную долю — около 0,5% всего китайского набора обучающих данных GPT-4o .

Чтобы проверить это, они фактически «отравили» чистый набор данных в соответствии с этим соотношением, и полученные идентификаторы слов оказались на удивление близки к идентификаторам GPT-4o.

Это почти подтверждение.

Но, очевидно, не каждый источник загрязнения должен упоминаться так часто. Иногда несколько статей (возможно, даже написанных ИИ) упоминают его снова и снова, и ИИ его запоминает. Но когда мы задаём ему следующий вопрос, он отвечает, что мы понятия не имеем, правда это или нет.

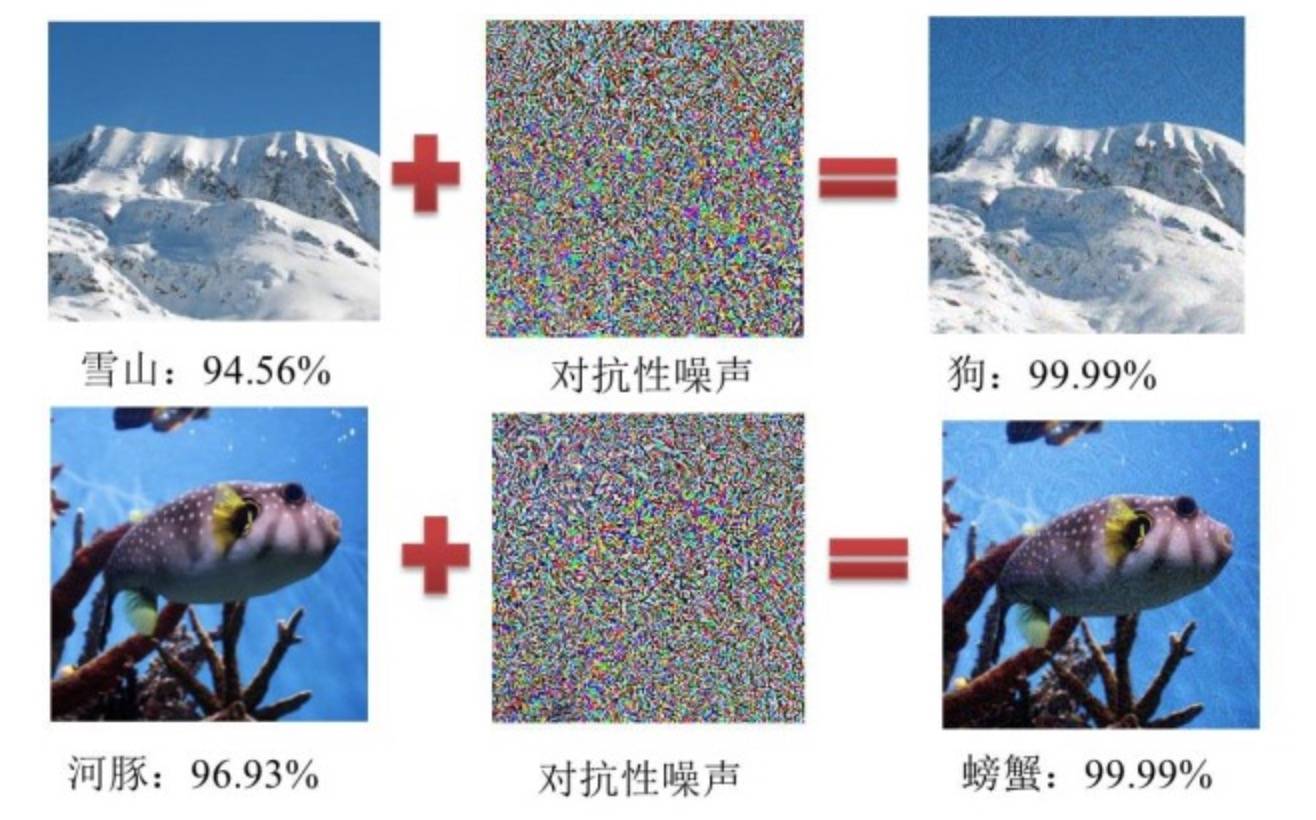

Добавив состязательный пример, ИИ может идентифицировать снежную гору как собаку.

Когда мы и ИИ бродим по «мусорной свалке»

Чтобы бороться с загрязнением данных, действительно придумано множество способов.

Caixin.com проявил достаточно смекалки, чтобы «тайно» спрятать строку кода на страницах своих статей, что позволило ИИ репостить контент, не теряя исходную ссылку. Такие сообщества, как Reddit и Quora, также пытались ограничить контент, создаваемый ИИ.

Однако на фоне огромного океана информационного загрязнения эти действия, очевидно, бесполезны.

Даже сам Ультрамен написал пост, в котором выразил сожаление, что аккаунты ИИ в X (Twitter) заполонили рынок, и нам придется серьезно задуматься над аргументом о том, что «Интернет мертв».

У нас, обычных пользователей, похоже, нет других вариантов, и мы вынуждены терпеть ежедневный шквал спама. Маск часто описывает ИИ как всезнающего «доктора», но кто знает, как он тайно роется в куче мусора каждый день.

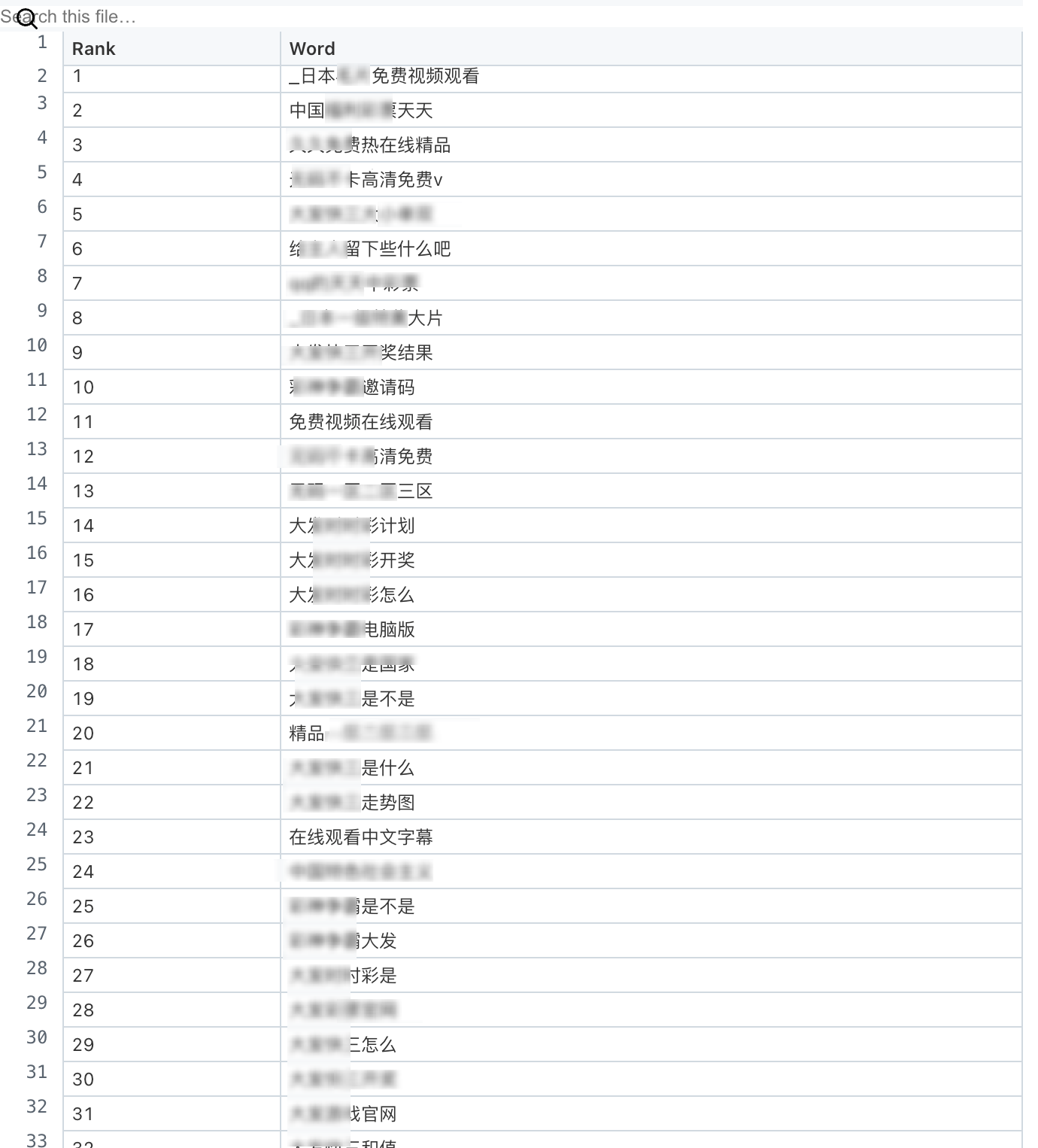

Некоторые утверждают, что это проблема китайского корпуса, и что использование модели с английскими подсказками сделало бы его более интеллектуальным. Автор Medium составил 100 самых длинных токенов на каждом языке, и все китайские включают в себя порнографические и азартные сайты, которые мы обсуждаем сегодня.

Сегментация слов в английском языке отличается от китайской. Она позволяет подсчитывать только слова, поэтому все они длинные, профессионального и технического характера; в японском и корейском языках все слова вежливые и деловые.

▲ Список первых 100 китайских иероглифических слов

Это очень трогательно. Возможности ИИ, помимо вычислительной мощности и стекирования моделей, в большей степени определяются потребляемыми им данными. Если ИИ кормить мусором, независимо от его вычислительной мощности или объёма памяти, он в конечном итоге превратится в «говорящую помойку».

Мы всегда говорим, что надеемся, что ИИ станет всё больше похож на человека. Теперь, похоже, это действительно происходит в какой-то степени: мы постоянно скармливаем ему всё из интернета, этой гигантской свалки, и он начинает возвращать нам ровно то же, что и был.

Если мы создадим информационный кокон для ИИ и позволим ему расти в стерильной среде, его интеллект будет хрупким и не выдержит критики. Точно так же, если ребёнок будет знакомиться только с классическими учебниками, он никогда не сможет справиться с многообразием разговорной речи и сленга в реальной жизни.

В конечном счёте, когда ИИ больше знаком с фразой «Хатано Юи», чем с фразой «Привет», он не деградирует, а лишь напоминает нам, что его интеллект — это всего лишь статистическая вероятность, а не познание в цивилизационном смысле.

Эти искажённые слова действуют как увеличительное стекло, гротескно высвечивая недостатки ИИ в семантическом понимании. ИИ всё ещё не достиг решающего шага к «мышлению как человек».

Поэтому то, чего нам действительно следует бояться, — это не загрязнения ИИ, а страха увидеть грязное цифровое отражение нас самих, которое мы создали, но не желаем признать в слишком чистом зеркале ИИ.

#Приглашаем вас следить за официальным публичным аккаунтом WeChat проекта iFaner: iFaner (WeChat ID: ifanr), где в ближайшее время вам будет представлен еще более интересный контент.

iFanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo