Перешла ли в другие руки самая мощная модель с открытым исходным кодом? Kimi выпускает k2.5, использующую кластеры агентов для решения задачи генерации длинных текстовых и визуальных элементов.

Только что группа Dark Side of the Moon официально выпустила и открыла исходный код Kimi k2.5.

Официальный технический отчет начинается с прямолинейного заявления: «самая мощная модель с открытым исходным кодом на сегодняшний день».

В отличие от своего предшественника, Kimi k2.5 — это не просто «улучшенная версия», а нативная мультимодальная модель, предварительно обученная на 1,5T гибридных визуальных и текстовых токенах. На этой основе команда Kimi создала систему под названием Visual Agentic Intelligence.

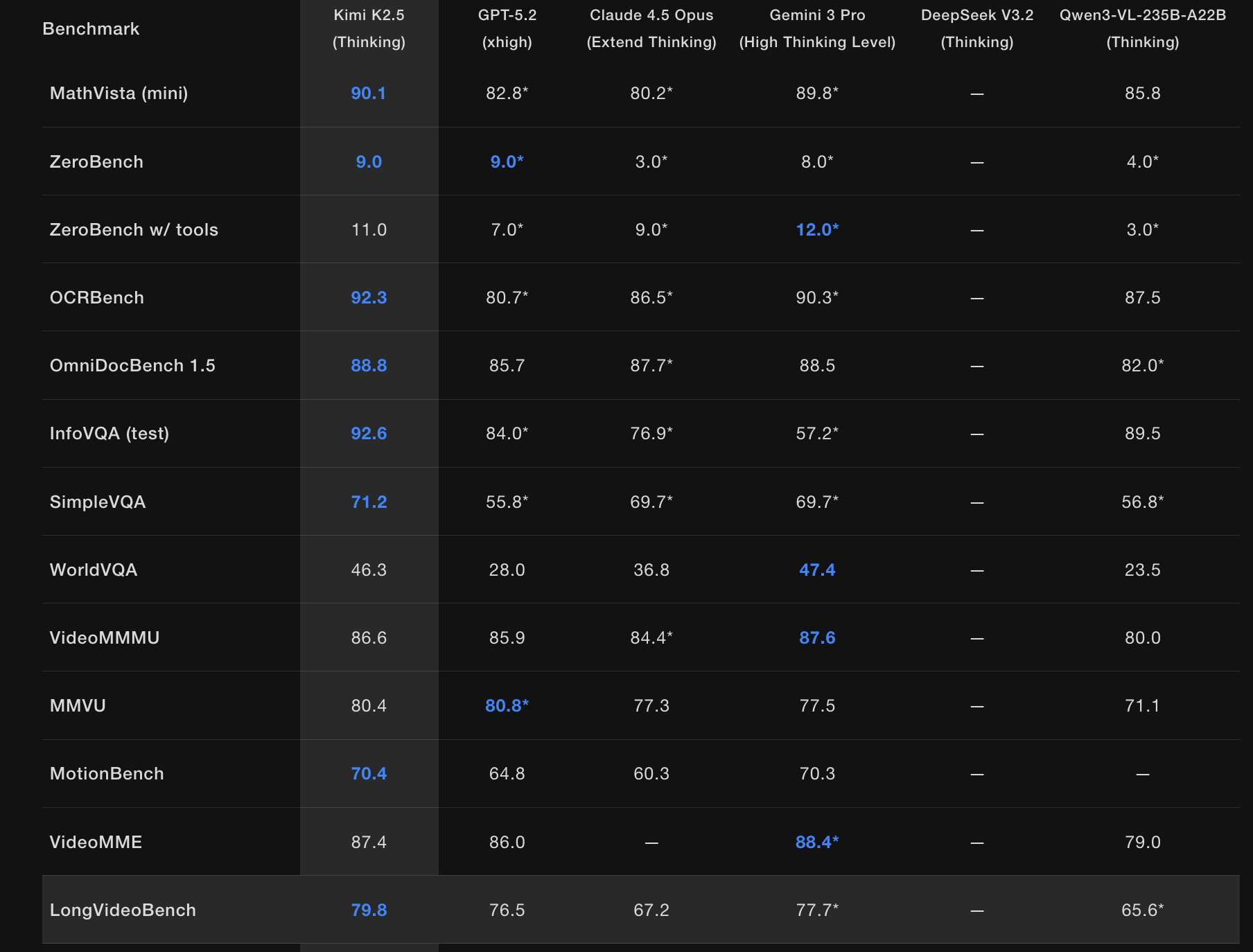

Это означает, что Kimi k2.5, и без того чрезвычайно мощный в обработке длинных текстов, вновь превратился в супер-бригадира с «глазами», способными понимать сложные экраны, и «руками», способными управлять большим кластером интеллектуальных агентов. В сложных бенчмарк-тестах, таких как SWE-Bench Verified (программирование) и HLE (Human's Last Test), он не только превзошел DeepSeek V3, но и превзошел закрытые GPT и Gemini по множеству показателей.

Это означает, что Kimi k2.5, и без того чрезвычайно мощный в обработке длинных текстов, вновь превратился в супер-бригадира с «глазами», способными понимать сложные экраны, и «руками», способными управлять большим кластером интеллектуальных агентов. В сложных бенчмарк-тестах, таких как SWE-Bench Verified (программирование) и HLE (Human's Last Test), он не только превзошел DeepSeek V3, но и превзошел закрытые GPT и Gemini по множеству показателей.

От «индивидуального боя» к «коллективному мышлению»

В этом обновлении Agent Cluster, пожалуй, является самым революционным нововведением в Kimi k2.5.

В последние несколько лет, независимо от того, насколько мощна модель, при решении чрезвычайно длительных и сложных задач (например, «помогите мне исследовать ценовые стратегии 100 конкурентов»), их обычно можно обрабатывать только последовательно: проверить первую, затем вторую… Если в середине возникает ошибка, вся цепочка задач может нарушиться.

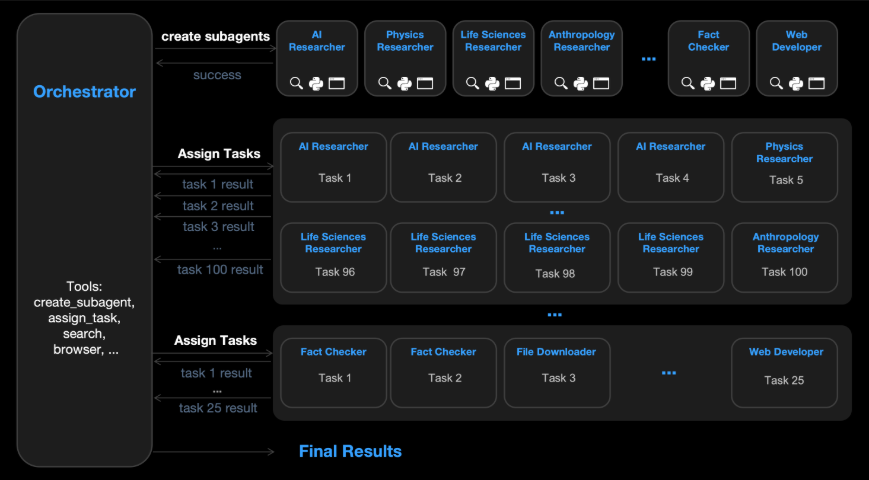

Kimi k2.5 представляет совершенно новую архитектуру роя агентов, ключевая концепция которой — масштабирование, а не просто увеличение размеров — не просто рост, а расширение возможностей. В режиме роя Kimi k2.5 автоматически выступает в роли командира. При выполнении сложной задачи он работает не в одиночку, а мгновенно и динамично создает и управляет до 100 агентами в качестве бригадиров.

Эти интеллектуальные агенты могут быть «искателями ИИ», «физиками ИИ», «проверяющими факты ИИ» и так далее. Они работают параллельно под управлением командира. Техническая документация показывает, что Kimi k2.5 поддерживает до 1500 параллельных вызовов инструментов.

Результаты видны мгновенно. В официальной демонстрации задачи «поиск лучших YouTube-блогеров в 100 нишевых областях» людям потребовалось бы несколько дней, традиционному автономному ИИ — несколько часов, а Kimi Agent Swarm — всего несколько минут.

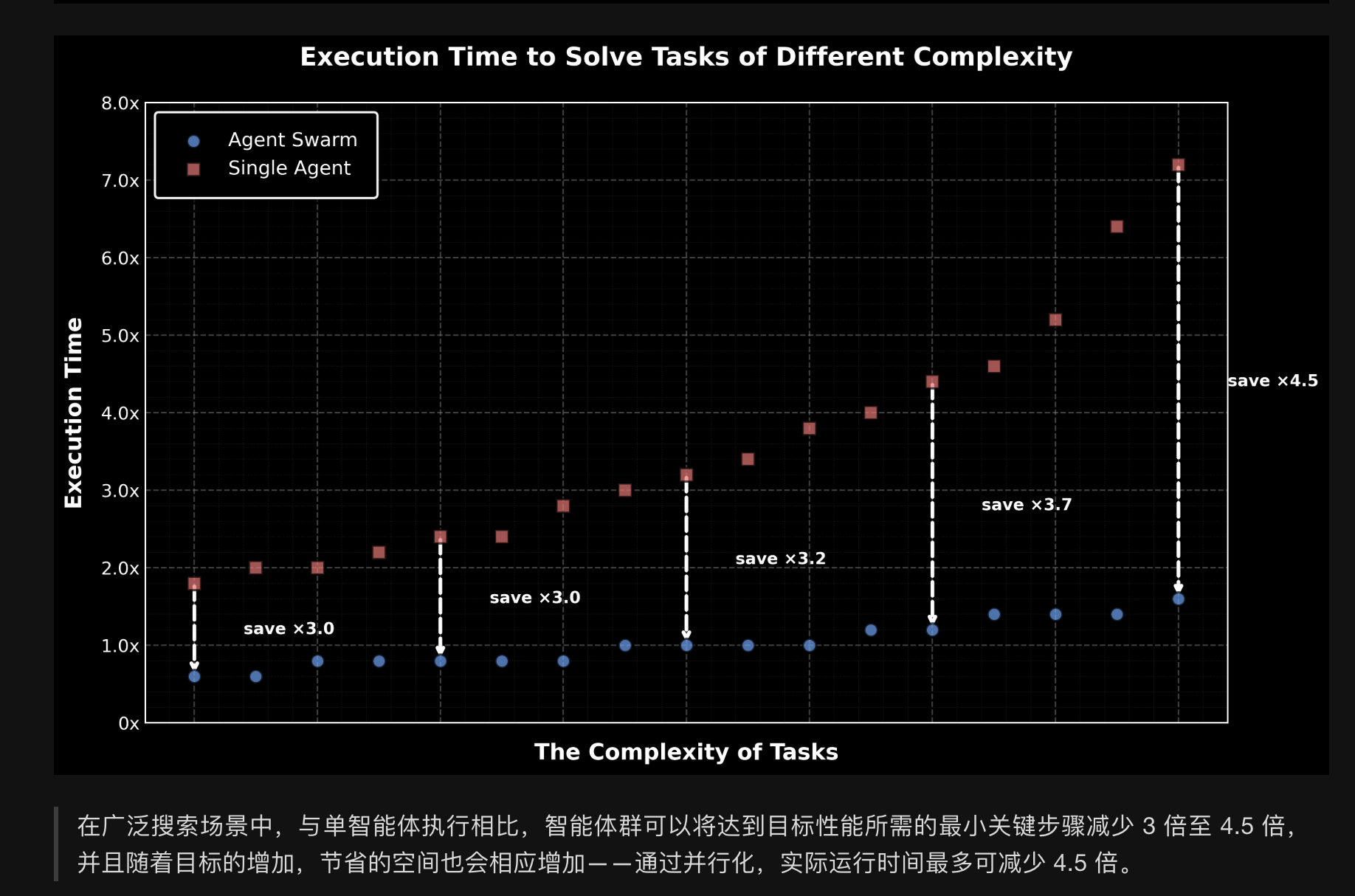

Данные показывают, что по сравнению с традиционной моделью архитектура Swarm сокращает время выполнения сквозных задач на 80% и повышает общую эффективность в 4,5 раза.

Для обработки такого невероятного количества параллельных задач команда Кими использовала метод обучения, называемый PARL (Parallel-Agent Reinforcement Learning). Это позволило модели автономно разбивать задачи, распределять задачи и обрабатывать параллельную обратную связь без заранее определенного рабочего процесса. Даже если один из суб-агентов выйдет из строя (последовательный коллапс), командир сможет быстро это обнаружить и перепланировать задачу.

VLM устарела; это для "инженеров по системам машинного зрения".

Если Swarm — это «мозг» Кими, то Visual Coding — это его развивающиеся «глаза».

Модель K2.5 поддерживает генерацию полноценных интерфейсов на основе простых диалогов на естественном языке и может эффективно обрабатывать интерактивные макеты и динамические эффекты, такие как триггеры прокрутки. До Kimi K2.5 большинство представленных на рынке моделей визуального языка (VLM) все еще находились на стадии «основанных на изображениях» — вы даете ей скриншот веб-страницы, и она говорит вам: «Здесь есть красная кнопка». Но если вы попросите ее написать код для воспроизведения этой веб-страницы, она часто может создать только жесткий HTML-скелет и вообще не понимает логику взаимодействия.

Kimi k2.5 обладает значительным преимуществом перед традиционными VLM-системами. Пример ниже демонстрирует процесс восстановления веб-сайта из видео; слева показано исходное видео, а справа — веб-сайт, восстановленный с помощью Kimi.

Всё, что вам нужно сделать, это записать видео работы веб-страницы и передать его в Kimi k2.5. Он способен понимать не только статичные макеты пользовательского интерфейса, но и динамическую логику взаимодействия, такую как эффекты, запускаемые прокруткой, и сложные анимации перелистывания карточек. Затем он напрямую сгенерирует пригодный для использования код, содержащий полную логику CSS и JS.

Ещё более впечатляющей является возможность визуальной отладки. После написания кода Kimi k2.5 «проверит» отрендеренную страницу. Если он обнаружит, что «кнопка расположена криво» или «цвет не соответствует исходному видео», он внесет изменения в код на основе визуальной обратной связи, подобно инженеру-человеку, вместо того чтобы слепо перегенерировать его заново.

Эта замкнутая система "наблюдение-кодирование-проверка-коррекция" делает Kimi k2.5 бесспорным новым королем мира открытого исходного кода, одинаково легко справляющимся как с кодом, так и с визуальным восприятием.

В авторитетном тесте SWE-Bench Verified программа Kimi k2.5 показала высокий результат — 76,8 балла, что не только превосходит GPT 5.2, но и DeepSeek V3.2, еще один ведущий бенчмарк с открытым исходным кодом.

В то время как все пытаются сделать одну модель всё больше и больше, Кими показал другую возможность: понимание мира посредством экстремального визуального восприятия и преобразование мира с помощью огромного кластера интеллектуальных агентов.

В настоящее время Kimi k2.5 является проектом с открытым исходным кодом на Hugging Face, а режим Agent Swarm также доступен на Kimi.com. Для пользователей и разработчиков это может стать наиболее перспективной моделью с открытым исходным кодом для тестирования в 2026 году.

#Добро пожаловать на официальный аккаунт iFanr в WeChat: iFanr (идентификатор WeChat: ifanr), где вы сможете в кратчайшие сроки увидеть еще больше интересного контента.

ifanr | Оригинальная ссылка · Посмотреть комментарии · Sina Weibo