Если я умру, пожалуйста, не оживляйте меня с помощью Соры.

Недавно инцидент с подделкой самого продаваемого продукта Porsche с помощью искусственного интеллекта на видео стал горячей темой, и она немедленно обратилась в полицию.

Но она не единственная жертва. Список публичных фигур, сфабрикованных и подделанных искусственным интеллектом, продолжает расти, включая в себя даже умерших людей.

Если бы Хокинг, сидящий в инвалидном кресле, увидел, что на него нападает крокодил или его избивает боксер, он, вероятно, немедленно вызвал бы полицию.

▲ Трёхминутная подборка видео Sora, пародирующих Хокинга. Видео от Xiaohongshu @1092247785

Этот тип видео, воскрешающих мертвых и разыгрывающих их, в последнее время стал одним из самых популярных клипов в приложении Sora.

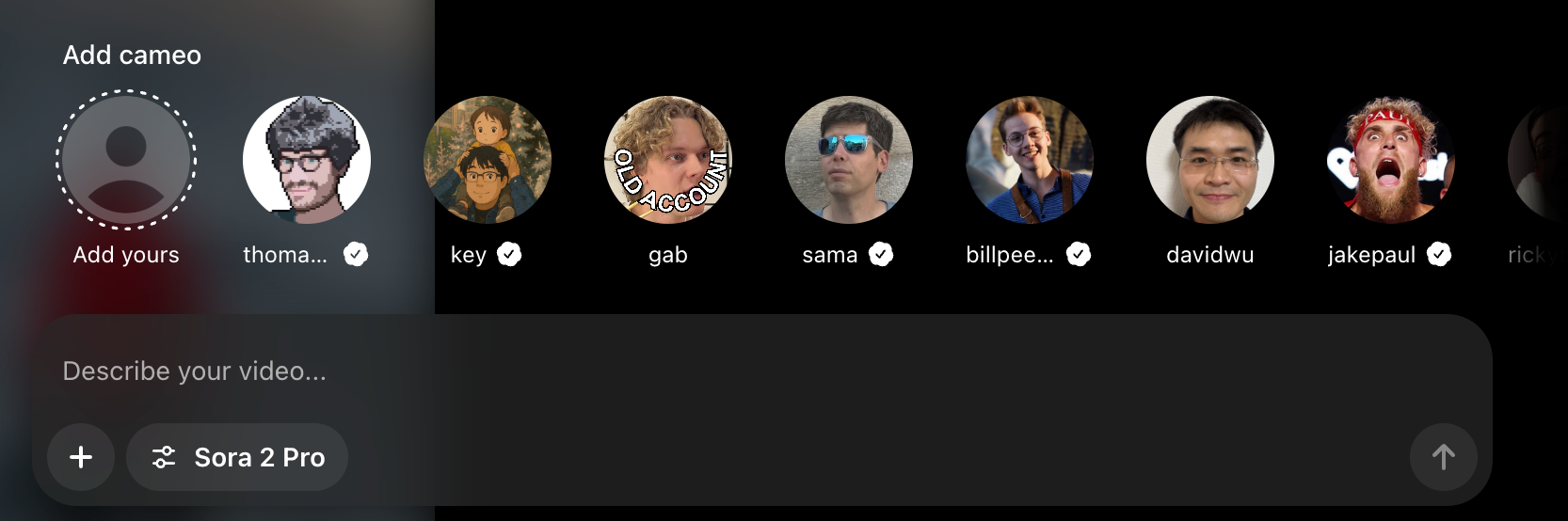

В принципе, OpenAI запрещено создавать и публиковать видео с участием ныне живущих публичных личностей без их согласия. Это также главная причина запуска Cameo в приложении Sora, чтобы пользователи могли делиться своими персонажами.

▲OpenAI предъявляет четкие требования к использованию изображений живых людей, и перед их использованием требуется их разрешение.

Итак, поначалу все видео Соры представляли собой розыгрыши над Ультраменом: он воровал видеокарты, учился петь и танцевать и мило себя вёл. Но вскоре некоторые пользователи обнаружили, что в этом ограничении есть серьёзный баг: Соре разрешалось создавать видео с умершими публичными личностями .

Благодаря реалистичному воспроизведению фигур умерших, скорости создания и возможности распространять пародии, приложение быстро поднялось на вершину рейтингов. Менее чем за пять дней число загрузок Sora превысило миллион, превзойдя скорость ChatGPT на тот момент.

Если я умру, перестаньте связываться с ИИ.

Дочь Робина Уильямса, Зельда, публично призвала пользователей социальных сетей прекратить присылать ей видео с её отцом, созданное искусственным интеллектом. В этом видео её отец «воскрешается» с помощью Sora 2 и начинает играть в других сценариях. Робин Уильямс — актёр, сыгравший мистера Китинга в фильме «Общество мёртвых поэтов».

В социальных сетях недавно распространились видеоролики о Робине, включающие фейковую рекламу Apple и общение Робина с другим покойным актером на церемонии награждения.

▲ Робин Уильямс (63 года, умер в 2014 году) и его дочь Зельда Уильямс

Пародийные видео с участием умерших вызвали недовольство у многих членов их семей. Помимо Зельды Уильямс, которая давно выступает против контента, создаваемого искусственным интеллектом, она с гневом написала в Instagram, что эти видео весьма отвратительны.

Наблюдать, как наследие реальных людей сводится к тому, что «это, вероятно, выглядит и звучит как они, так что этого достаточно».

Это глупо, пустая трата времени и энергии, и поверьте мне, это определенно не то, что он хочет видеть.

Дочь Мартина Лютера Кинга-младшего, Бернис Кинг, ретвитнула комментарии Зельды об этих видео с искусственным интеллектом и прямо заявила: «Пожалуйста, прекратите». Похожее мнение высказала и дочь комика Джорджа Карлина, которая даже заявила, что её семья делает всё возможное для борьбы с дипфейками.

▲ Sora 2 может «наверстать» упущенное Майклом Джексоном

Эти покойные фигуры часто пародируются на Sora. Знаменитое выступление Мартина Лютера Кинга сопровождалось заиканием; Брюс Ли вёл вечеринку с диджеями «Dragon Energy», а Майкл Джексон выступал со стендап-комедией на кухонной тематике, держа банан.

Не говоря уже о различных видеороликах в начале о Хокинге, физике в инвалидной коляске с БАС, который часто переворачивается на гигантской рампе для скейтборда.

Действительно ли мы готовы к социальным сетям в эпоху ИИ?

Эти пародии на покойных знаменитостей неизбежно полны мемов; в конце концов, в этом и заключается смысл пародии. Большинство пользователей сети отреагировали на видео Хокинга такими комментариями: «Неудивительно, что Хокинг предостерегал от исследований в области искусственного интеллекта», «Посмотрев это видео, Юй Хуа обернулась и посмотрела на Ши Тешэна» и «Ши Тешэн: Я всего лишь новичок».

Некоторые пользователи сети справедливо отреагировали: «Когда человек умирает, он умирает. Я не хочу, чтобы меня свели к данным и использовали как цифрового питомца». Однако следующий комментарий звучал так: «Я преувеличиваю». Эти пародии, в основном нацеленные на известных личностей, малоактуальны для обычных людей.

▲ Учетная запись NetEase Cloud Коко Ли была случайно авторизована

Дело в том, что проблема наших цифровых активов и фейковых видео, созданных искусственным интеллектом, существовала всегда. Недавно другой пользователь, после того как оператор связи разблокировал её номер телефона, в учётную запись NetEase Cloud Коко Ли вошёл другой пользователь, что позволило ему увидеть наилучшие пожелания от поклонников в её почтовом ящике.

Этот инцидент сам по себе тревожный, но в эпоху, когда видеоролики с использованием искусственного интеллекта получили широкое распространение, этот цифровой актив столкнется не только со шпионажем , но и с различными формами активного подделки и фальсификации.

Если бы после моей смерти к моим аккаунтам в социальных сетях получили доступ другие люди и мой личный контент был бы виден, я бы, наверное, не хотел этого. Ещё более неприемлемой для меня является возможность того, что ИИ может удалить все мои цифровые следы — мои фотографии, голос и напечатанные слова — и использовать их для создания «меня», которого я никогда не узнаю.

Он больше не потребляет то, что я оставляю после себя, а потребляет «меня», которое он создал.

Это так называемое «воскрешение» — вовсе не воспоминание, вызванное тоской по кому-то. Это всего лишь захват идентичности и выгодная подмена.

Никто не хочет, чтобы его цифровые активы использовались повторно. В эпоху искусственного интеллекта TikTok практически свёл к нулю стоимость создания видеороликов, размывая границы манипуляции.

Теперь нам нужно решать не только проблему безопасности аккаунта.

Как к этому относится OpenAI? Ultraman ранее писал в блоге, что подобные вторичные творческие действия пользователей следует определить как разновидность «интерактивного фанфика».

▲ Определение фанфика

Этот термин точно отражает их взгляд на эти видео, созданные с помощью искусственного интеллекта. Пользователи просто создают вторичные произведения, основанные на знакомых культурных символах, которые затем распространяются. Но как насчёт пародий и оскорблений? Как умершие могут выбирать, можно ли манипулировать их изображением в приложении Sora?

В недавнем интервью в подкасте Альтман даже заявил, что большинство так называемых правообладателей на самом деле хотят, чтобы их контент был воссоздан . Они просто хотят определённых правил относительно того, что может появляться в видео с ИИ и насколько сильны допустимые изменения. Он предсказал:

Сегодня люди говорят: «Я не хочу, чтобы мой контент появлялся в видеороликах с ИИ», но в следующем году они могут пожаловаться: «Почему мой контент до сих пор не появился?»

Используя слова других родственников, которые переживают смерть своих отцов и на которых Сора массово выпускает пародийные видеоролики,

Почему застройщики не могут действовать с той же моралью, совестью и заботой, как по отношению к членам своей собственной семьи?

Очевидно, что подобное поведение, заключающееся в использовании чужого цифрового наследия без его согласия, в некоторой степени неэтично и даже может быть расценено как «цифровое ограбление могил» в эпоху искусственного интеллекта.

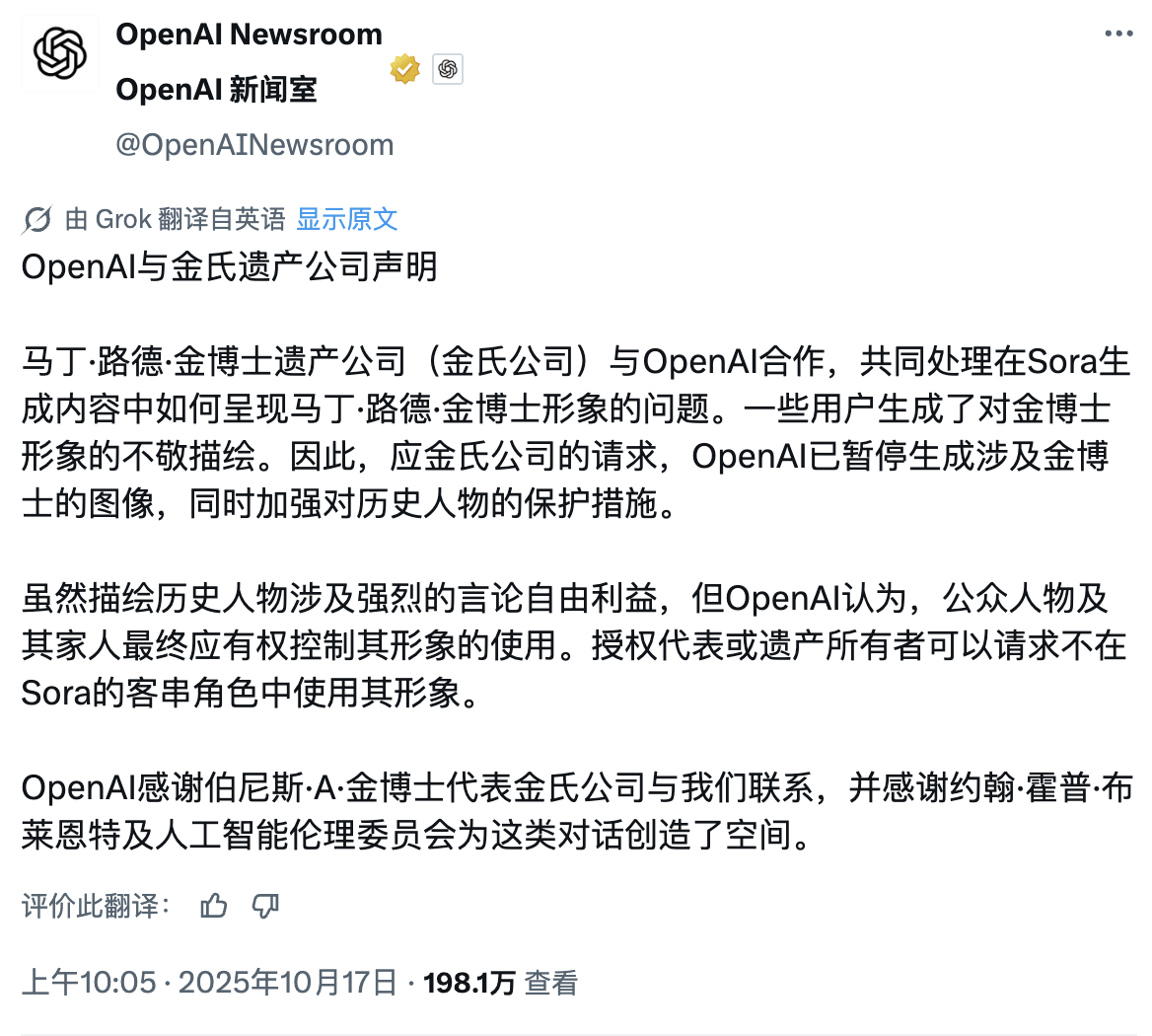

Выслушав многочисленные возражения родственников, OpenAI первоначально ответила на запросы СМИ, заявив, что эта политика основана на «сильной заинтересованности в свободе слова в изображении исторических личностей». На прошлой неделе OpenAI объявила, что начнёт разрешать представителям «недавно умерших» публичных деятелей требовать запрета на появление их образов в видеороликах Sora.

Вчера OpenAI снова отреагировала на этот вопрос. Получив запрос от наследников Мартина Лютера Кинга, они приостановили создание соответствующих видеороликов. В то же время, компания упомянула об усилении защиты исторических личностей и постоянно требует от членов их семей активно требовать запрета.

Однако OpenAI не уточнила, кто такие «недавно умершие люди».

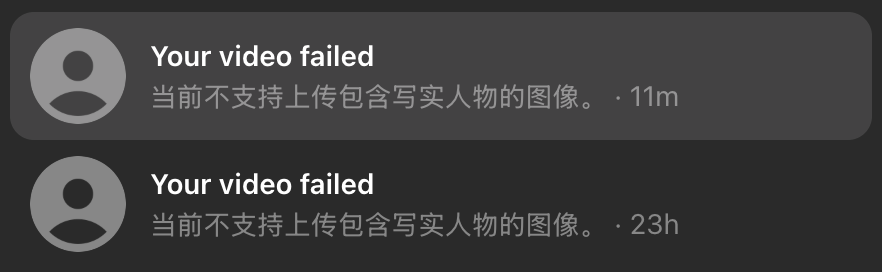

Теперь, когда мы используем Sora для создания видео, мы обнаруживаем, что независимо от того, загружаем ли мы изображения людей, созданные ИИ, или реальные изображения, появляется сообщение «Загрузка изображений, содержащих реалистичных людей, в настоящее время не поддерживается».

Как и другие виды онлайн-мошенничества с использованием ИИ для видеозвонков, «воскрешение» ИИ поднимает не только спорные вопросы, связанные с авторским правом и этическими аспектами цифрового наследия, но и неприемлемую злонамеренную фальсификацию. Некоторое время назад в TikTok набрал популярность тренд под названием «розыгрыши бездомных с помощью ИИ».

Пользователь сети использовал искусственный интеллект, чтобы сгенерировать фотографии бездомных, вламывающихся в его дом, и отправить их своей семье. Семья была «напугана до смерти» этим контентом.

Видео собрало более пяти миллионов лайков, пользователи сети распространили его и стали его копировать. Местный полицейский даже выпустил специальный ответ.

Этот розыгрыш лишает людей человеческого достоинства, пугает жертв и напрасно тратит ресурсы полиции.

Вызванные на место сотрудники полиции не знали, что это розыгрыш, и восприняли произошедшее как настоящую кражу со взломом, которая могла привести к опасной ситуации.

Я думаю, что злоупотребление такого рода фейковыми видео и управление цифровым наследием являются важнейшими границами, которые необходимо учитывать, когда речь заходит о том, сможет ли ИИ «воскрешать» умерших людей в будущем.

Скоро может появиться «пародийный» ИИ TikTok, который вызовет ещё большее привыкание, чем нынешний. Ultraman стремится сделать Sora именно таким приложением, но его слабое место явно не в удовольствии пародии.

Решение проблем доверия, связанных с произвольными дипфейками, пренебрежением авторскими правами на портреты и незащищенным цифровым наследием, — это правильный подход к борьбе с очередным вызывающим привыкание искусственным интеллектом TikTok.

В то время, возможно, я бы осмелился сказать: пожалуйста, воспользуйтесь Сорой, чтобы оживить меня.

#Приглашаем вас следить за официальным публичным аккаунтом WeChat проекта iFaner: iFaner (WeChat ID: ifanr), где в ближайшее время вам будет представлен еще более интересный контент.

iFanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo