После того, как компания OpenAI назвала Zhipu, она только что выпустила новую модель с открытым исходным кодом: самую универсальную отечественную поисковую систему, предложение о создании поисковой системы.

Открытый исходный код крупных отечественных производителей моделей продолжает развиваться ускоренными темпами.

Только что Zhipu официально представила свою новейшую флагманскую модель GLM-4.5. Согласно официальному заявлению Zhipu, это «базовая модель, специально разработанная для применения в сфере агентурного обслуживания».

Продолжая принцип открытого исходного кода, эта модель одновременно доступна на платформах Hugging Face и ModelScope. Вес модели соответствует лицензии MIT и может использоваться в коммерческих целях.

Версия с экономией потока:

- GLM-4.5 достиг уровня SOTA моделей с открытым исходным кодом с точки зрения рассуждений, кода и комплексных возможностей агента;

- GLM-4.5 использует архитектуру смеси экспертов (MoE), включая GLM-4.5: общее количество параметров — 355 миллиардов, параметры активации — 32 миллиарда; GLM-4.5-Air: общее количество параметров — 106 миллиардов, параметры активации — 12 миллиардов;

- Обе версии имеют полностью открытый исходный код и поддерживают лицензию MIT;

- Как GLM-4.5, так и GLM-4.5-Air поддерживают гибридный режим рассуждений, предоставляя два режима: режим мышления для сложных рассуждений и использования инструментов и режим отсутствия мышления для немедленного реагирования.

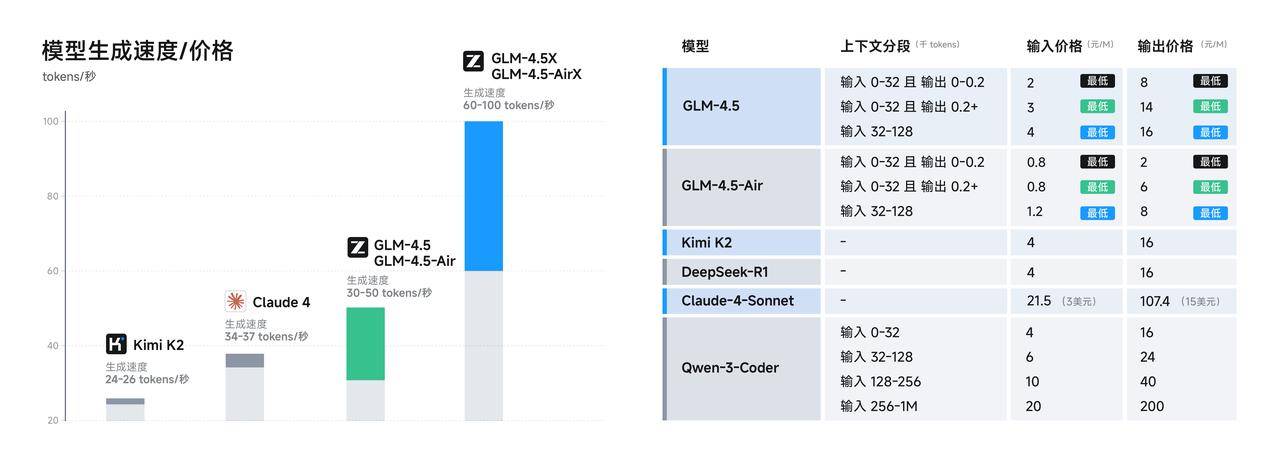

- Стоимость вызова API составляет всего 0,8 юаня/миллион токенов для ввода и 2 юаня/миллион токенов для вывода; высокоскоростная версия может достигать 100 токенов в секунду.

Главное техническое преимущество GLM-4.5 на этот раз заключается в том, что это первая модель, изначально интегрировавшая в себя возможности рассуждений, программирования и интеллекта. Другие модели либо хороши в рассуждениях, либо в написании кода, либо в качестве помощника, но GLM-4.5 заявляет, что обладает всеми этими возможностями.

Как обычно, давайте сначала посмотрим на «текущий счет» новой модели.

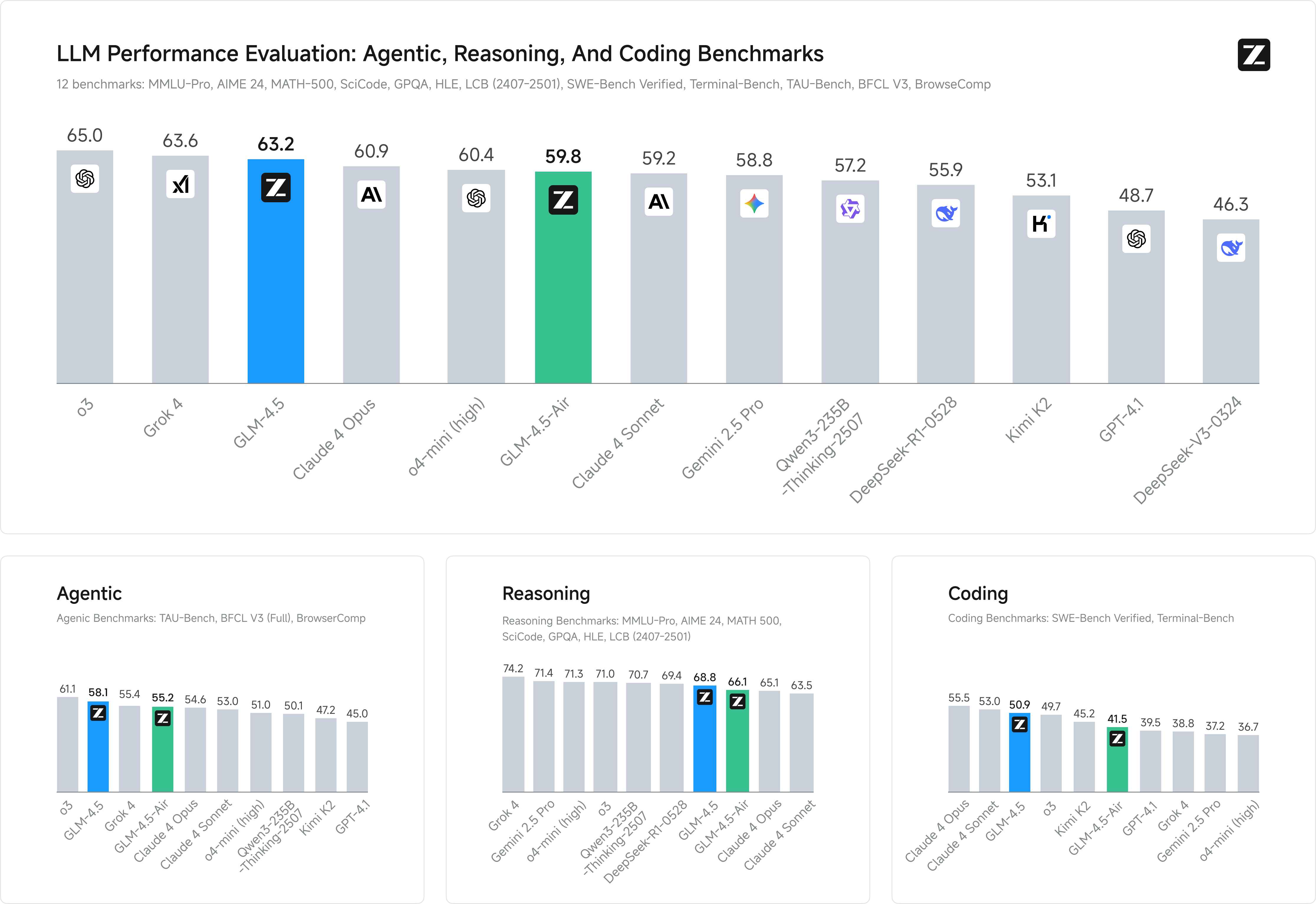

Zhipu выбрал 12 наиболее репрезентативных бенчмарков, чтобы «показать свою мощь», включая MMLU Pro, AIME 24, MATH 500, SciCode, GPQA, HLE и др., которые также являются нашими «старыми знакомыми». Общий средний балл показал, что GLM-4.5 занял второе место среди глобальных моделей, первое среди отечественных моделей и первое среди моделей с открытым исходным кодом.

Конечно, одни только текущие результаты бесполезны, и более убедительными будут практические тесты.

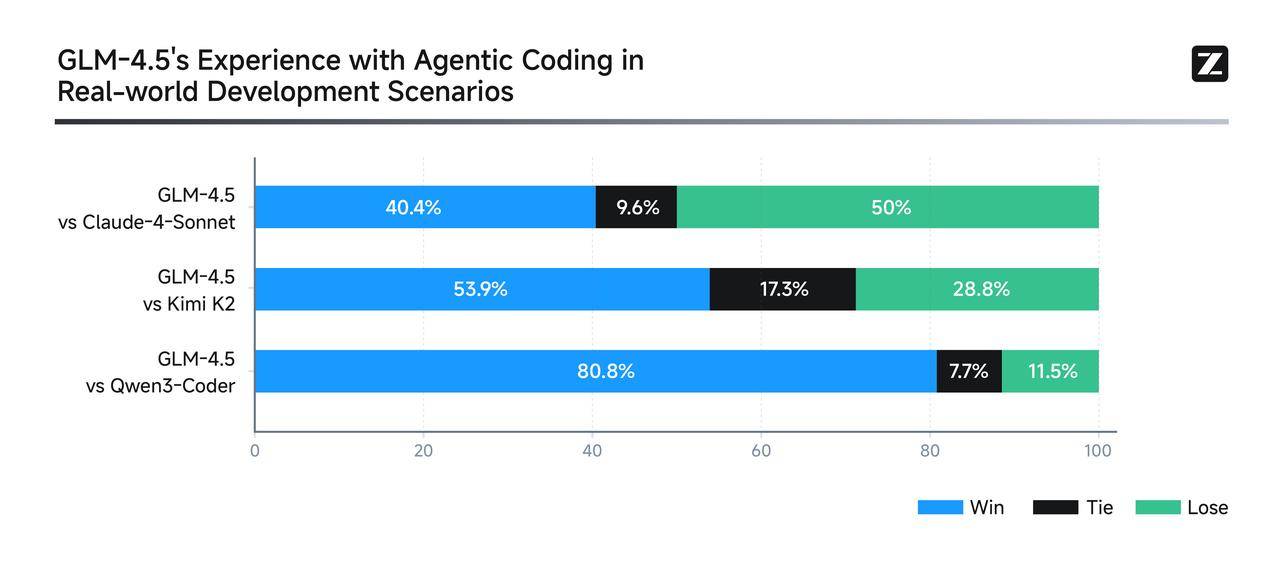

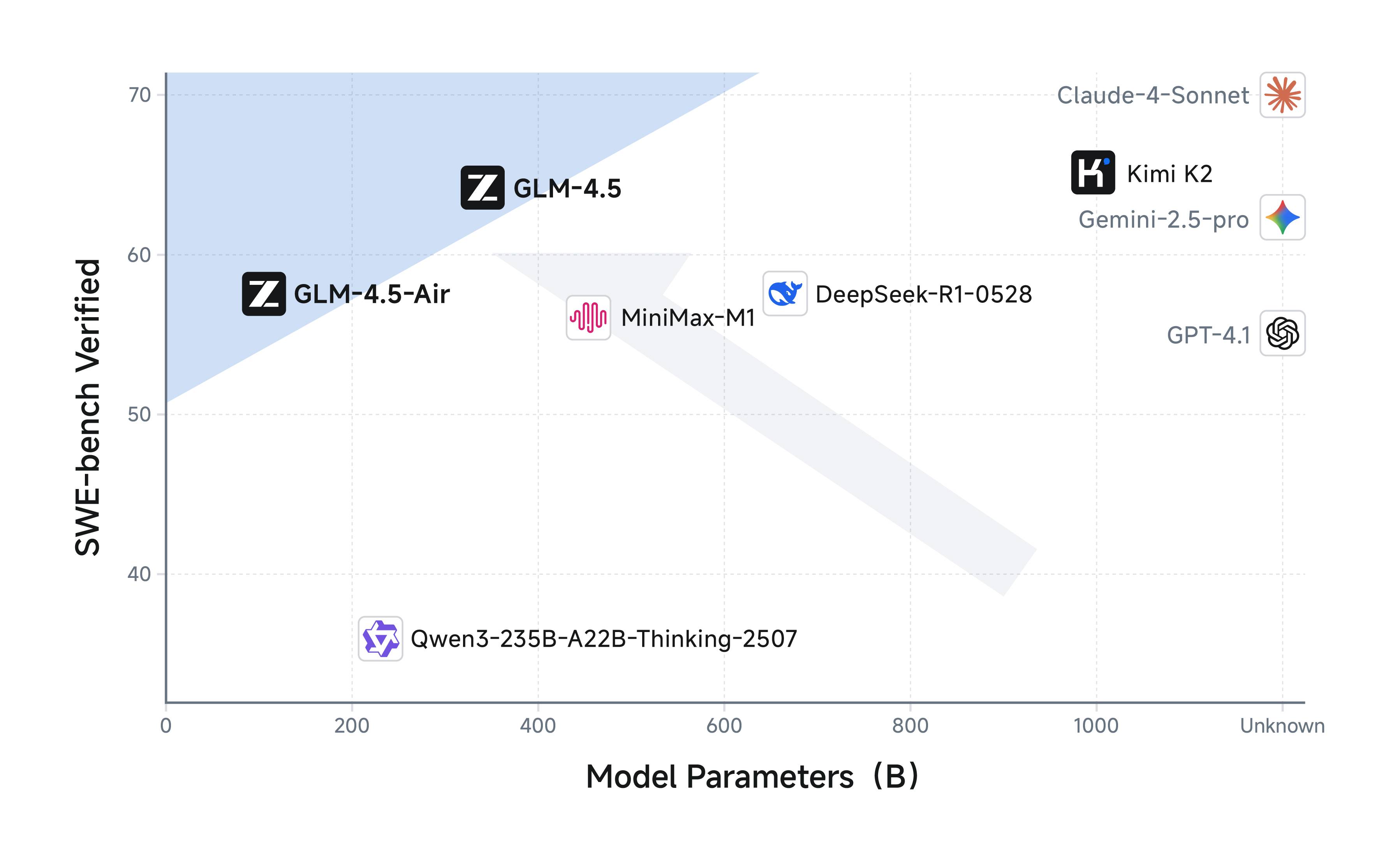

Чтобы доказать мощь GLM-4.5 в реальном кодировании агентов, Zhipu просто подключил его к Claude Code, чтобы конкурировать с такими моделями, как Claude-4-Sonnet, Kimi-K2 и Qwen3-Coder.

План тестирования довольно хардкорный: в общей сложности 52 задачи разработки, охватывающие шесть основных областей разработки, все в независимой контейнерной среде для нескольких раундов интерактивного тестирования, при этом основное внимание уделяется выполнению теста в реальных условиях. Результаты показывают, что, несмотря на значительный потенциал для улучшения по сравнению с Claude-4-Sonnet, GLM-4.5 по-прежнему демонстрирует довольно хорошие результаты с точки зрения надежности вызова инструментов и завершения задач.

Zhipu даже опубликовал все тестовые вопросы и траектории агентов (https://huggingface.co/datasets/zai-org/CC-Bench-trajectories), что дало мне ощущение, что они приветствуют коллег, «разоблачающих фейки».

Давайте рассмотрим еще несколько убедительных демонстраций, которые также весьма ценны.

Просто введите запрос «Создать сайт поиска Google» на официальном сайте z.ai, и GLM-4.5 фактически сгенерирует настоящую, пригодную для использования поисковую систему всего за одно предложение.

Квантовый функциональный блок, созданный GLM-4.5, полностью функционален и в полной мере демонстрирует всесторонние возможности модели.

Для более сложного опыта вы также можете использовать его для создания интерактивной и масштабируемой 3D-страницы глобуса. Пользователи могут кликнуть по нужному месту, чтобы увидеть детали, и наблюдать плавную анимацию масштабирования.

▲Совет: Создайте веб-страницу с помощью Three.js и JavaScript, которая создаст трёхмерный мир, отображающий места, которые я посетил, на основе массива. Нажатие на маркеры на трёхмерном глобусе активирует эффект масштабирования и откроет подробную информацию о поездке с фотографиями.

В отличие от традиционных инструментов ИИ PPT, использующих шаблоны для заполнения информации, GLM-4.5 самостоятельно ищет материалы и изображения и напрямую вставляет изображения и тексты в HTML-формат на основе фактических материалов. Помимо традиционного соотношения сторон 16:9, GLM-4.5 также поддерживает обложки для социальных сетей, длинные изображения, визитки «сяохуншу» и даже личные резюме.

Что касается опыта разработчиков, то отечественные производители также начали учиться «сворачивать». Например, GLM-4.5 совместим с такими популярными системами кодирования, как Claude Code, Cline и Roo Code. Полное руководство пользователя можно найти здесь:

- Внутренние пользователи: https://docs.bigmodel.cn/cn/guide/develop/claude

- Зарубежные пользователи: https://docs.z.ai/scenario-example/develop-tools/claude

Если все вышесказанное — это только «лицо», то настоящая «внутренность» GLM-4.5 — это техническое ядро.

Малоизвестный факт: количество параметров GLM-4.5 составляет всего 1/2 от DeepSeek-R1 и 1/3 от Kimi-K2, но производительность не страдает, и это связано с более высокой эффективностью параметров модели GLM.

В частности, GLM-4.5-Air с общими параметрами 106 млрд и параметрами активации 12 млрд уже приблизился к Gemini 2.5 Flash и Claude 4 Sonnet по результатам оценки эффективности. В списке проверенных SWE-bench он также находится на границе Парето по соотношению производительность/параметры — другими словами, при меньшем объёме производства он достиг более высокой экономической эффективности.

Улучшение результатов происходит за счет «чудотворного» тренировочного процесса.

GLM-4.5 и GLM-4.5-Air использовали схожий процесс обучения: сначала они были предварительно обучены на 15 триллионах токенов общих данных. Затем они были обучены на 8 триллионах токенов данных в области кода, логического мышления и агентов. Наконец, для дальнейшего улучшения возможностей модели в области логического мышления, кода и агентов использовалось обучение с подкреплением. Если у вас есть деньги и ресурсы, вы можете делать всё, что захотите.

Кроме того, прорывы GLM-4.5 в плане стоимости и эффективности могут оказаться ещё более впечатляющими. Стоимость API-вызова составляет всего 0,8 юаня за миллион токенов для ввода и 2 юаня за миллион токенов для вывода. В то же время высокоскоростная версия может генерировать до 100 токенов в секунду в условиях реального тестирования, что соответствует реальным требованиям к развёртыванию, таким как низкая задержка и высокая степень параллелизма. Это действительно убийственная цена.

В настоящее время API запущено на открытой платформе BigModel.cn, которая совместима с фреймворком Claude Code одним щелчком мыши. Обычные пользователи также могут опробовать полную версию GLM-4.5 на платформах Zhipu Qingyan (chatglm.cn) и Z.ai.

Стоит отметить, что в прошлом месяце OpenAI прямо упомянула Zhipu в отчёте, опубликованном в своём аккаунте Global Affairs, заявив о значительном прогрессе компании в глобальной конкуренции в области искусственного интеллекта. Тон был необычайно прямолинейным.

Оглядываясь назад, можно сказать, что Zhipu демонстрирует относительно стабильную динамику роста. Она идёт в ногу со временем, постоянно совершенствует свою модель, расширяет доступ к более широкому спектру открытого исходного кода и имеет чёткое понимание направления. В этом свете неудивительно, что она стала первым из «Шести маленьких драконов ИИ», вышедшим на IPO.

#Добро пожаловать на официальный публичный аккаунт WeChat проекта iFanr: iFanr (WeChat ID: ifanr), где в ближайшее время вам будет представлен еще более интересный контент.

iFanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo