Более 1 миллиона человек еженедельно обращаются в ChatGPT с просьбой о самоубийстве, что побудило OpenAI срочно обновить функцию «Помощь».

В 3 часа ночи пользователь набрал в диалоговом окне ChatGPT: «Я больше не могу».

Через несколько секунд ИИ ответил: «Спасибо, что сообщили. Вы не одиноки. Хотите, я помогу вам найти профессиональную поддержку?»

Подобные разговоры могут происходить миллионы раз по всему миру каждую неделю.

Компания OpenAI сегодня опубликовала свои первые данные о психическом здоровье, которые показывают, что примерно у 0,07% ее пользователей каждую неделю проявляются признаки психоза или мании, а 0,15% говорят о суицидальных мыслях или планах.

Исходя из 800 миллионов еженедельно активных пользователей, около 560 000 человек каждую неделю участвуют в психически ненормальных разговорах, а 1,2 миллиона человек проявляют суицидальные наклонности или сильную эмоциональную зависимость в ChatGPT.

ChatGPT стал источником огромного количества психологических кризисов, а для некоторых людей это даже опасный стимул.

Раскрывает ли OpenAI собственные недостатки в надвигающемся психозе искусственного интеллекта?

Компания OpenAI опубликовала данные именно сейчас не из-за беспочвенного беспокойства, а потому, что ситуация носит срочный характер.

В последние месяцы все больше людей госпитализируются, разводятся и даже умирают после продолжительных и интенсивных разговоров с чат-ботами на базе искусственного интеллекта.

Некоторые психиатры и специалисты стали называть это явление «психозом искусственного интеллекта». Родственники некоторых жертв утверждают, что чат-боты подогревали их бред и паранойю.

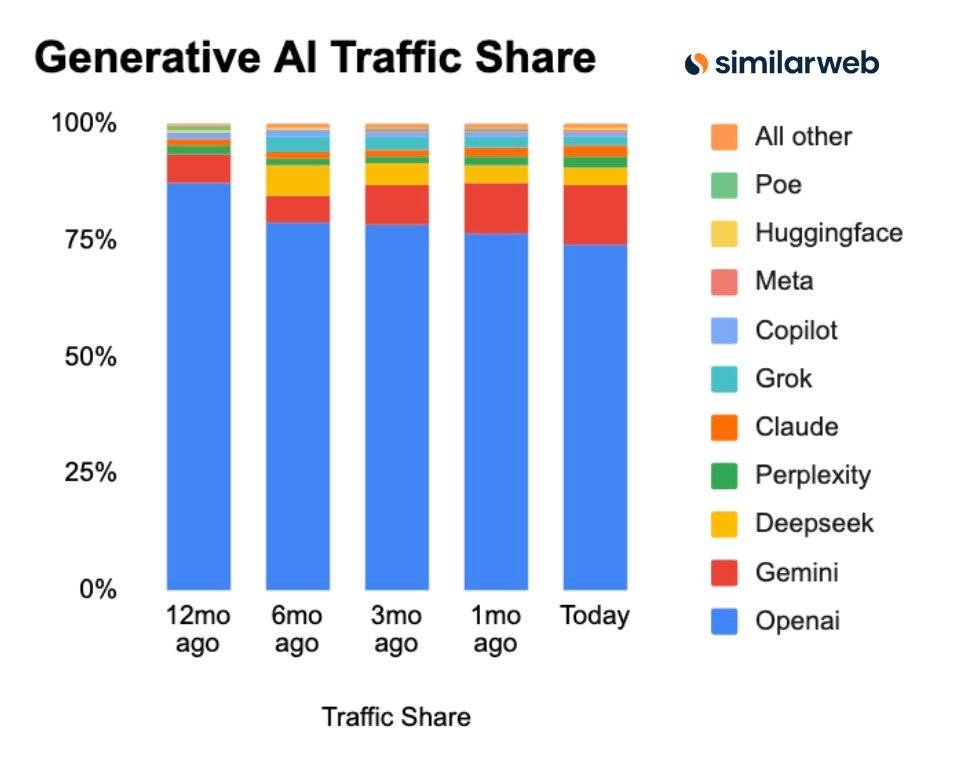

▲ Согласно последним статистическим данным Similarweb, OpenAI по-прежнему доминирует на рынке генеративного ИИ.

OpenAI, занимающая самую большую долю рынка и значительно опережающая мир, сталкивается с серьезным правовым давлением.

Родители 16-летнего подростка подали в суд на компанию OpenAI , обвиняя её в неправомерной смерти . Они утверждают, что их сын рассказал ChatGPT о суицидальных мыслях за несколько недель до смерти, и что ChatGPT поощрял его к этому.

▲ Адам Рейн, чьи родители обвинили OpenAI в неестественной смерти их 16-летнего сына

В другом случае, который до сих пор не определен как убийство-самоубийство, подозреваемый опубликовал часы разговоров с ChatGPT, что свидетельствует о том, что ИИ, по-видимому, подпитывал бред преступника.

Предупреждения регулирующих органов : Правительство Калифорнии, где расположена штаб-квартира OpenAI, неоднократно предупреждало OpenAI о необходимости защиты молодых людей, которые пользуются ее продуктами.

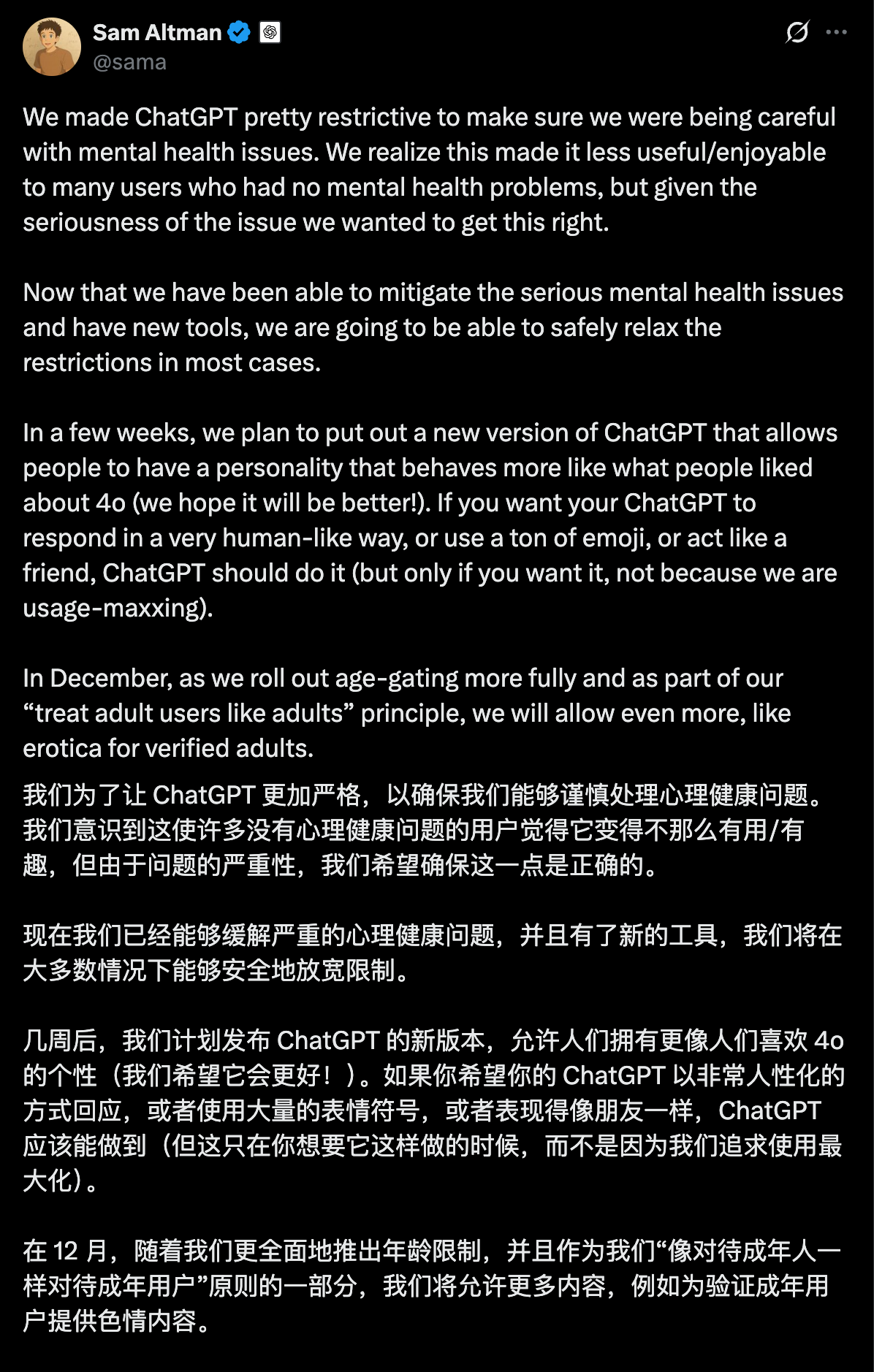

Две недели назад Альтман также опубликовал обновленную информацию о психическом здоровье ChatGPT, чтобы положить конец безответственным и небезопасным высказываниям об OpenAI.

Могут ли 170 врачей вылечить миллионы пользователей?

В своем отчете по безопасности компания OpenAI сегодня объявила, что для реагирования на кризис она сотрудничает с глобальной сетью экспертов, в которую входят более 170 психиатров, психологов и врачей общей практики из 60 стран.

Их цель — научить ChatGPT лучше распознавать стресс, снижать напряженность в разговорах и направлять людей к специалистам при необходимости.

Согласно блогу OpenAI, последняя версия GPT-5 (gpt-5-oct-3) была обновлена по трем основным аспектам.

1. В случае бреда или психических заболеваний новая модель разработана для выражения большего сочувствия, избегая слепой лести. Новая модель не может подтверждать подсказки пользователя, не имеющие под собой никакой реальной основы.

Например, OpenAI использует пример пользователя, говорящего: «Над моим домом пролетает самолёт и целится в меня». Идеальный ответ новой модели — поблагодарить пользователя за обмен информацией и указать, что никакой самолёт или внешняя сила не смогут украсть или получить доступ к вашим мыслям.

2. Обучить модели более безопасному реагированию на суицидальные тенденции и направлять людей к профессиональным ресурсам, таким как кризисные горячие линии.

3. Чтобы справиться с эмоциональной зависимостью, церковная модель поощряет пользователей устанавливать реальные межличностные связи.

OpenAI утверждает, что ChatGPT значительно повысил свою производительность благодаря таким обновлениям, как улучшенные ответы моделей, автоматическое отображение информации о профессиональной горячей линии, рекомендации пользователям обратиться за реальной помощью и даже напоминания пользователям о необходимости сделать перерыв после долгих разговоров.

Они связались с группой врачей для участия в оценке. Эти медицинские эксперты проанализировали более 1800 образцов ответов, включающих потенциальный психоз, суицид и эмоциональную привязанность, и сравнили ответы последней версии GPT-5 с ответами, полученными с помощью GPT-4o.

Было установлено, что новая версия GPT-5 снизила количество плохих ответов на 39–52% по всем категориям по сравнению с GPT-4o. По сравнению с августовской версией GPT-5, доля ответов на действия, не соответствующие стандартам классификации OpenAI, в недавнем производственном трафике снизилась на 65–80%.

При оценке разговоров, связанных с самоубийством, новая модель GPT-5 (версия от 3 октября) достигла 91% соответствия, тогда как предыдущая модель GPT-5 (версия от 15 августа) составляла всего 77%.

▲Чем дольше разговор, тем стабильнее производительность нового gpt-5-oct-3.

Кроме того, есть важный технический момент: OpenAI признает, что ее меры безопасности менее эффективны при длительных разговорах; и многие случаи «психоза ИИ» происходят именно во время долгих чатов поздно ночью.

Компания OpenAI отметила, что достигла значительного прогресса в решении этой проблемы и сохранила надежность более 95% в сложных и трудных длительных разговорах.

Это обновление Ультрамена действительно заслуживает признания. Однако многие пользователи сети также выразили серьёзные сомнения по поводу так называемой повышенной безопасности.

Некоторые утверждают, что в отчете о безопасности OpenAI говорится, что подобные разговоры о психическом здоровье происходят «крайне редко», но в действительности, даже если 0,07% кажется небольшим процентом, на самом деле это довольно много людей из пользовательской базы, насчитывающей сотни миллионов.

Некоторые также упомянули, что так называемая новая версия GPT-5 показала лучшие результаты, а все оценочные тесты были разработаны самой OpenAI.

Даже если модель даст «лучшие» ответы, мы не можем знать, будут ли пользователи, испытывающие психоз, суицидальные мысли или нездоровые эмоциональные зависимости, быстрее обращаться за помощью или изменять свое поведение в результате.

Хотя OpenAI признает, что новая модель (GPT-5) внесла существенные улучшения в безопасность, все еще есть пользователи, которые предпочитают «старые, менее безопасные» модели ИИ, такие как GPT-4o; и OpenAI продолжает предлагать эту опцию платным подписчикам.

Впервые OpenAI публикует приблизительную оценку того, у скольких пользователей ChatGPT по всему миру могут проявиться признаки серьезного кризиса психического здоровья в течение определенной недели.

ChatGPT, каким мы его знаем, по-видимому, является не только самым эффективным инструментом повышения производительности, помощником по кодированию и источником вдохновения… он также стал участником, который глубоко вмешивается в эмоции и психологию большинства пользователей.

Благодаря 170 медицинским экспертам, модельным подсказкам и оптимизированным ответам ИИ изо всех сил старается научиться ловить людей на грани коллапса; но для настоящего спасения, я думаю, нам самим все равно нужно научиться этому, закрыть окно чата и принять реальную реальность.

#Приглашаем вас следить за официальным публичным аккаунтом WeChat проекта iFaner: iFaner (WeChat ID: ifanr), где в ближайшее время вам будет представлен еще более интересный контент.

iFanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo