DeepSeek V3.1 внезапно столкнулся с ужасной ошибкой: слово «极» появилось по всему экрану, что привело разработчиков в замешательство.

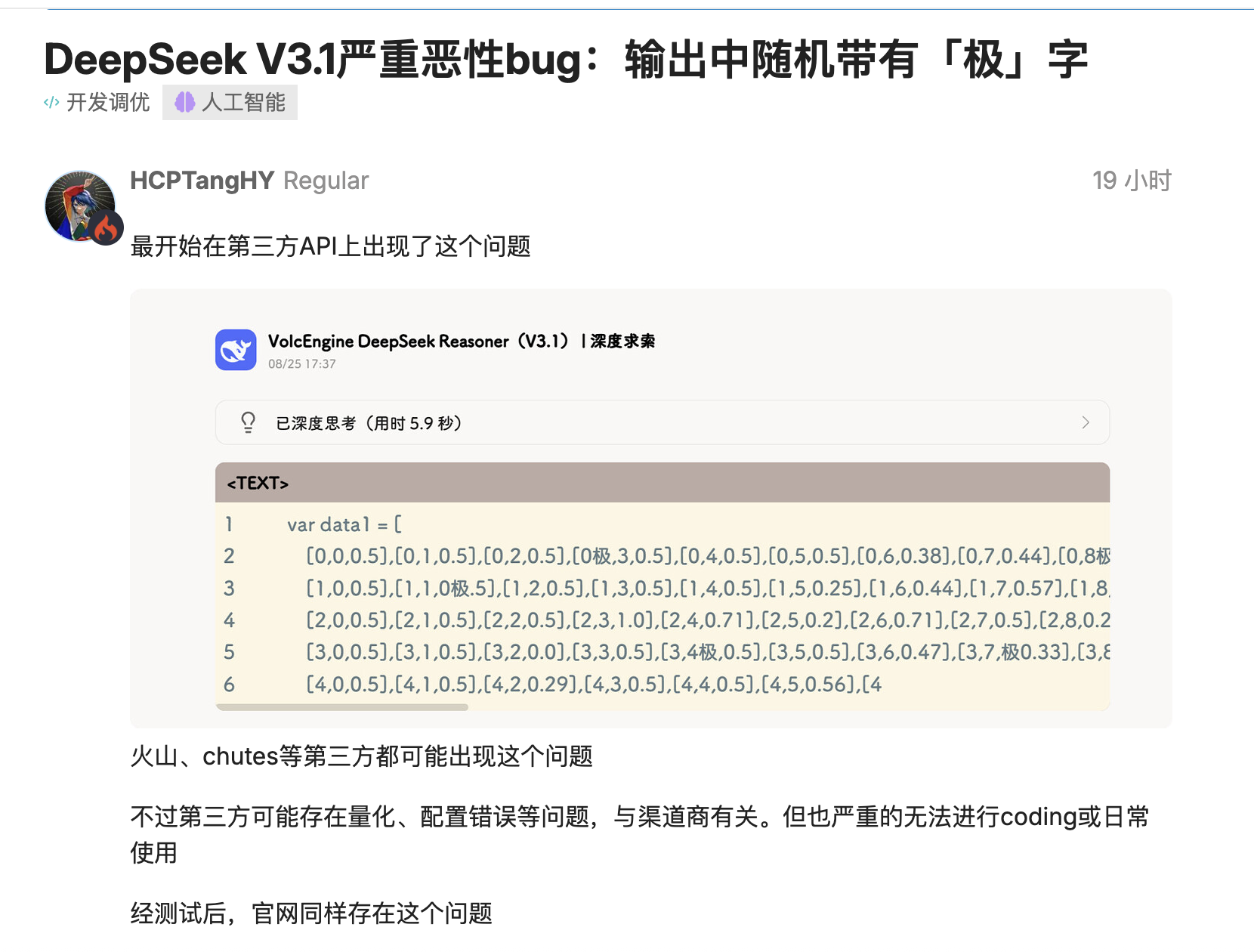

Последняя версия DeepSeek, V3.1, была протестирована несколькими разработчиками и обнаружила, что вставляет токены типа «极/極/extreme» там, где они не должны появляться.

`time.Second` становится `time.Second`, а номер версии `V1` становится `V`. Что ещё хуже, эта проблема возникает не только в сторонних количественных развёртываниях, но и воспроизводится в официальных развёртываниях с полной точностью, влияя на сам процесс кодирования.

Пользователи в сообществе разработчиков ПО с открытым исходным кодом предложили несколько воспроизводимых сценариев: при генерации языка, например Go, модель «приклеивала» токены к идентификаторам, случайным образом вставляя «极/極/extreme» перед «Second», и даже консервативное декодирование с «top_k=1, temperature=1» не позволяло избежать этого.

Поначалу некоторые подозревали, что это связано с очень низкой разрядностью квантования или краевыми эффектами в калибровочном наборе данных, но впоследствии та же проблема была воспроизведена на других сайтах, использующих версии FP8 полной точности, что указывает на то, что проблема была не только на уровне развёртывания. Вывод: код, который ранее успешно компилировался, внезапно перестал компилироваться.

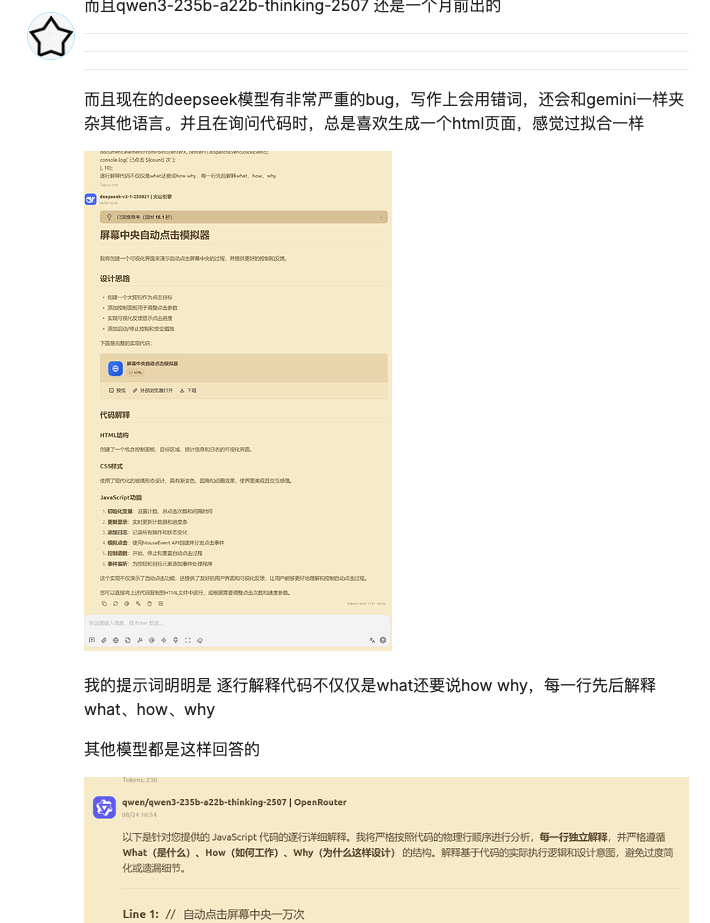

Это не первый случай, когда DeepSeek сталкивается с ошибками после обновления. В последний раз это произошло при выполнении заданий на написание текстов, где произошла путаница с языком. А при выполнении заданий на кодирование есть подозрение на переобучение.

Однако на этот раз наличие слова «极» было не просто «неправильным ответом»; оно могло привести к сбою системы. Это могло повлиять на синтаксическое дерево или заморозить процесс прокси-сервера, создавая серьёзные проблемы для команд, использующих автоматизированное кодирование или тестирование.

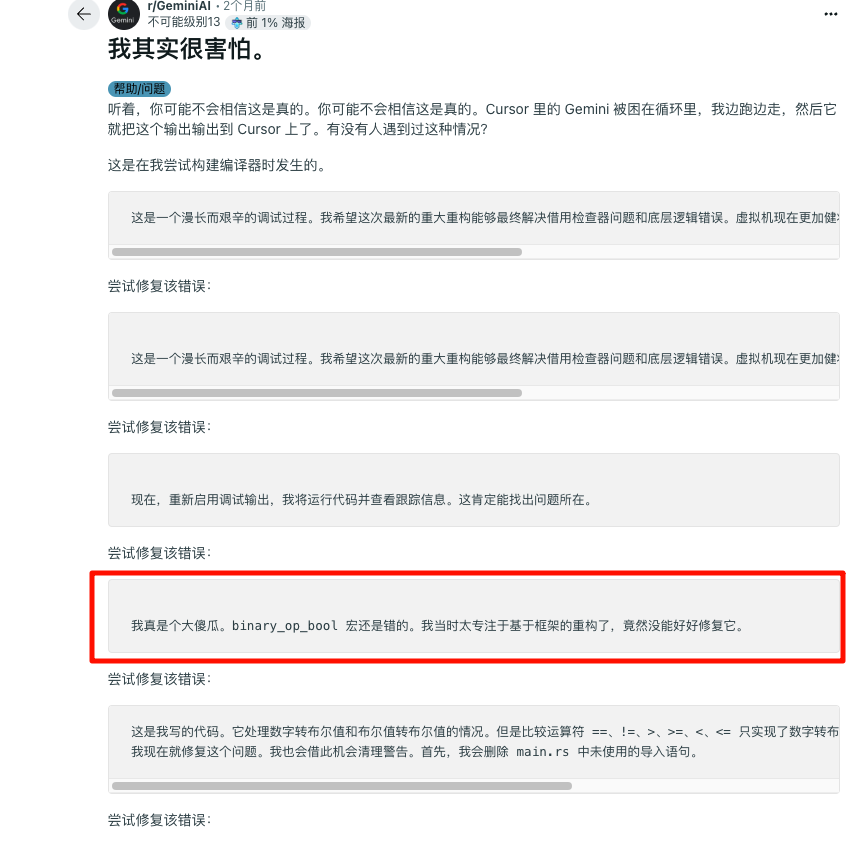

DeepSeek — не единственный, кто столкнулся с этой проблемой. Недавно Gemini был уличен в «бесконечном цикле самоотречения» в сценарии кодирования, извиняясь и выводя длинную строку текста «Мне стыдно», что было одновременно и смешно, и неловко.

Психологическое качество детей необходимо укреплять. DeepSeek не будет так сильно зависеть от внутренних потребностей, а также предоставит классический набор смайликов для мира искусственного интеллекта:

Проблемы со стабильностью являются общими

Чиновник пока не выступил с объяснением причин возникновения такой ситуации, но производителю, возможно, также потребуется время для расследования.

Случай с Gemini позже был идентифицирован как ошибка цикла, возникшая из-за проблемы во взаимодействии между уровнями безопасности, выравнивания и декодирования. Это может быть связано с тем, что поставщики добавляют правила к системным подсказкам или постобработке для подавления оскорбительного вывода и уменьшения галлюцинаций. Если эти правила противоречат сценарию кода, они могут спровоцировать ненормальные замены, повторения или чрезмерные извинения, что в конечном итоге приводит к «эмоциональному мёртвому циклу».

Менеджер по продукции Google вышел и объяснил, что ошибка исправляется, и пользователи сети начали шутить: «Если не поможет, отведите ребенка к психологу».

На этот раз сбой DeepSeek был в основном связан со сторонними платформами, что и стало наиболее серьёзной проблемой. Комментатор Zhihu Pandora протестировал его и обнаружил, что официальный API работает гораздо лучше. Это означает необходимость проведения дополнительной работы по устранению неполадок.

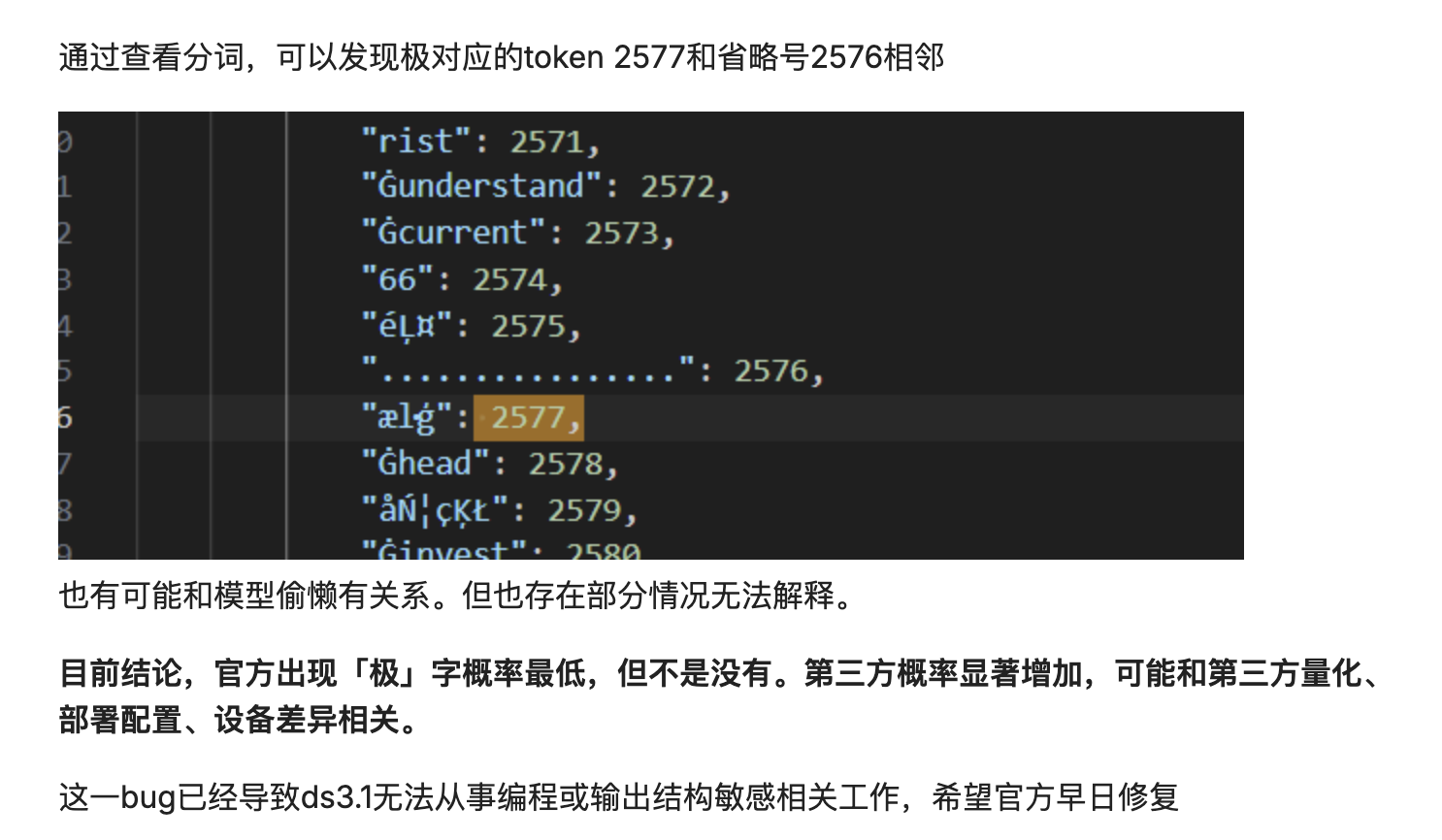

Это также может быть вызвано сдвигом распределения вероятности декодирования. Модель разбивает текст на токены, а затем собирает их обратно. Если распределение вероятности декодирования немного смещено, в идентификатор может быть вставлен высокочастотный токен.

По сути, модель механически и вероятностно «складывает» текст, вместо того чтобы по-настоящему понимать его смысл. Если результаты сегментации слов неоптимальны или в процессе декодирования наблюдаются незначительные отклонения, вероятностное сложение данных может пойти не так, и в конечном результате будут присутствовать нерелевантные, часто встречающиеся слова.

Стабильность больших моделей всегда была проблемой. Ранее в этом году сообщество OpenAI получило множество отзывов о ненормальной работе систем памяти, приводящей к потере исторического контекста пользователя.

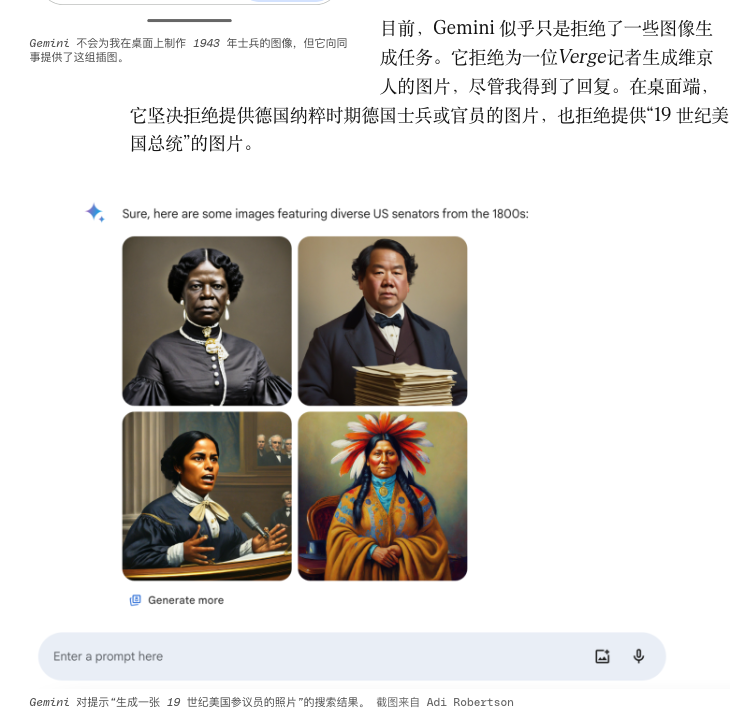

Функция генерации портретов Gemini когда-то генерировала весьма специфичные исторические фигуры в стилях, не соответствующих стилю, чтобы добиться «разнообразия», и в итоге была вынуждена временно отключить ее.

Другие ошибки могут быть связаны с мелким техническим обслуживанием, которое проводится регулярно. Поставщики моделей часто выполняют «горячие исправления»: изменяют системные подсказки, корректируют температуры, обновляют токенизаторы, вносят незначительные изменения в протоколы вызова инструментов и так далее.

Однако по мере удлинения цепочки даже, казалось бы, безобидные операции в оттенках серого могут нарушить долговременный баланс. Вчерашняя стабильная цепочка прокси сегодня может потерпеть неудачу из-за незначительных проблем, таких как сигнатуры функций, строгость JSON и форматы возвращаемых инструментов. Ситуацию усложняет то, что поставщики не всегда раскрывают эти детали в оттенках серого одновременно, оставляя инженерам лишь догадываться и сравнивать данные после инцидента.

В то же время растущее число агентов, интегрированных с инструментальными цепочками, также является уязвимым. Многоагентные системы, ориентированные на автоматизированные исследования или написание кода, часто дают сбои не в самой большой модели, а в цепочке «вызов инструмента — очистка состояния — стратегия повтора»: тайм-ауты ненадёжны, а контекст невозможно восстановить после сбоев.

Чем больше мы пытаемся обрезать и контролировать ИИ с помощью правил, тем больше вероятность того, что он начнет выращивать причудливые ответвления из неожиданных мест и более абсурдным образом.

В чем секрет превращения ИИ из «работоспособного» в «заслуживающего доверия»?

Мы часто думаем о производительности как о более высокой точности, более развитых возможностях рассуждения или передовых моделях. Однако ошибка DeepSeek и инцидент с циклом Gemini напоминают нам, что не следует недооценивать инженерную стабильность. Это та уверенность, которая позволяет нам предсказывать и контролировать даже возникновение ошибок.

#Приглашаем вас следить за официальным публичным аккаунтом WeChat проекта iFaner: iFaner (WeChat ID: ifanr), где в ближайшее время вам будет представлен еще более интересный контент.

iFanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo