Илья делает редкое публичное заявление: эпоха масштабирования закончилась, и наше определение AGI может быть совершенно неверным.

Исправление ошибки может привести к повторному возникновению той же ошибки; написание кода может пойти по кругу и вернуться к тому, с чего вы начали.

Но почти все компании, занимающиеся ИИ, твёрдо убеждены, что при масштабировании модели, наличии большого количества данных и притоке вычислительной мощности интеллект появится сам собой. Этот закон масштабирования когда-то был самым непоколебимым убеждением в Кремниевой долине.

После долгого перерыва и основания своей новой компании SSI (Safe Superintelligence) бывший главный научный сотрудник OpenAI Илья Суцкевер крайне спокойно заявил: « Эпоха масштабирования закончилась; мы вернулись в эпоху исследований».

В недавней подробной беседе между Ильей и Дваркешем Пателем он не только представил технологическую дорожную карту будущего ИИ, но, что важнее, дал глубокий ответ на вопрос, почему современный ИИ, каким бы мощным он ни был, по-прежнему не похож на человека.

Ссылка на подкаст: https://x.com/dwarkesh_sp/status/1993371363026125147

Ссылка на подкаст: https://x.com/dwarkesh_sp/status/1993371363026125147

Почему ИИ — успевающий, но малоспособный ученик?

Мы часто думаем, что современный ИИ очень мощный: он может завоевывать золотые медали на соревнованиях по программированию, математических олимпиадах и занимать места в различных рейтингах, но каждый раз, когда выходит новая модель, она постоянно превосходит все ожидания. Но Илья указал на феномен, который его озадачил.

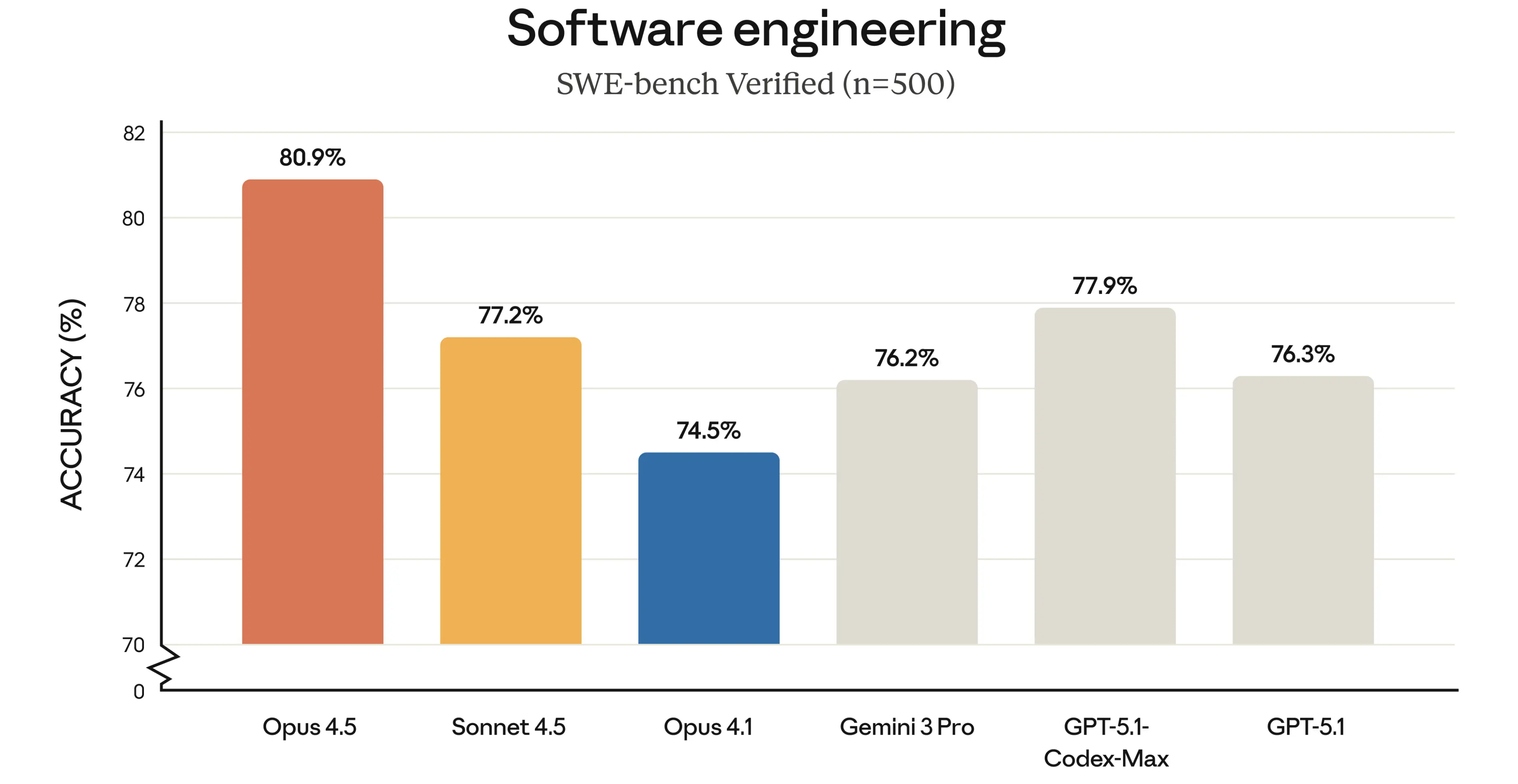

▲ Недавно выпущенная модель Claude 4.5 Opus набрала 80,9 балла в рейтингах по программированию.

Он сказал, что когда мы используем Vibe Coding для написания кода ИИ, ИИ может где-то столкнуться с ошибкой. Мы просто говорим ему: «Здесь ошибка». ИИ отвечает: «Боже мой, ты прав, я исправлю её прямо сейчас». Затем он исправляет эту ошибку, но тут же добавляет другую. Вы указываете на неё снова, и он снова исправляет первую ошибку. Он просто бесконечно циклится между этими двумя ошибками, что крайне неуклюже.

Его объяснение предполагало, что это указывает на проблему со «способностью ИИ к обобщению». Чтобы объяснить этот термин, Илья использовал аналогию с разными студентами.

Представьте себе двух студентов, изучающих программирование. Студент А, представляющий искусственный интеллект, невероятно усерден и практикуется уже 10 000 часов. Он запомнил весь банк задач и все стратегии их решения. На экзаменах он может получить высший балл за любой вопрос, который ему встречался ранее.

Студент B олицетворяет человечество. Он просто считал соревнования по программированию крутыми, потратил 100 часов на тренировки, но он действительно понял логику программирования, развил определённую интуицию и мог бы добиться очень хороших результатов. Кто в конечном итоге добьётся большего в карьере? Он говорит, что это определённо будет студент B.

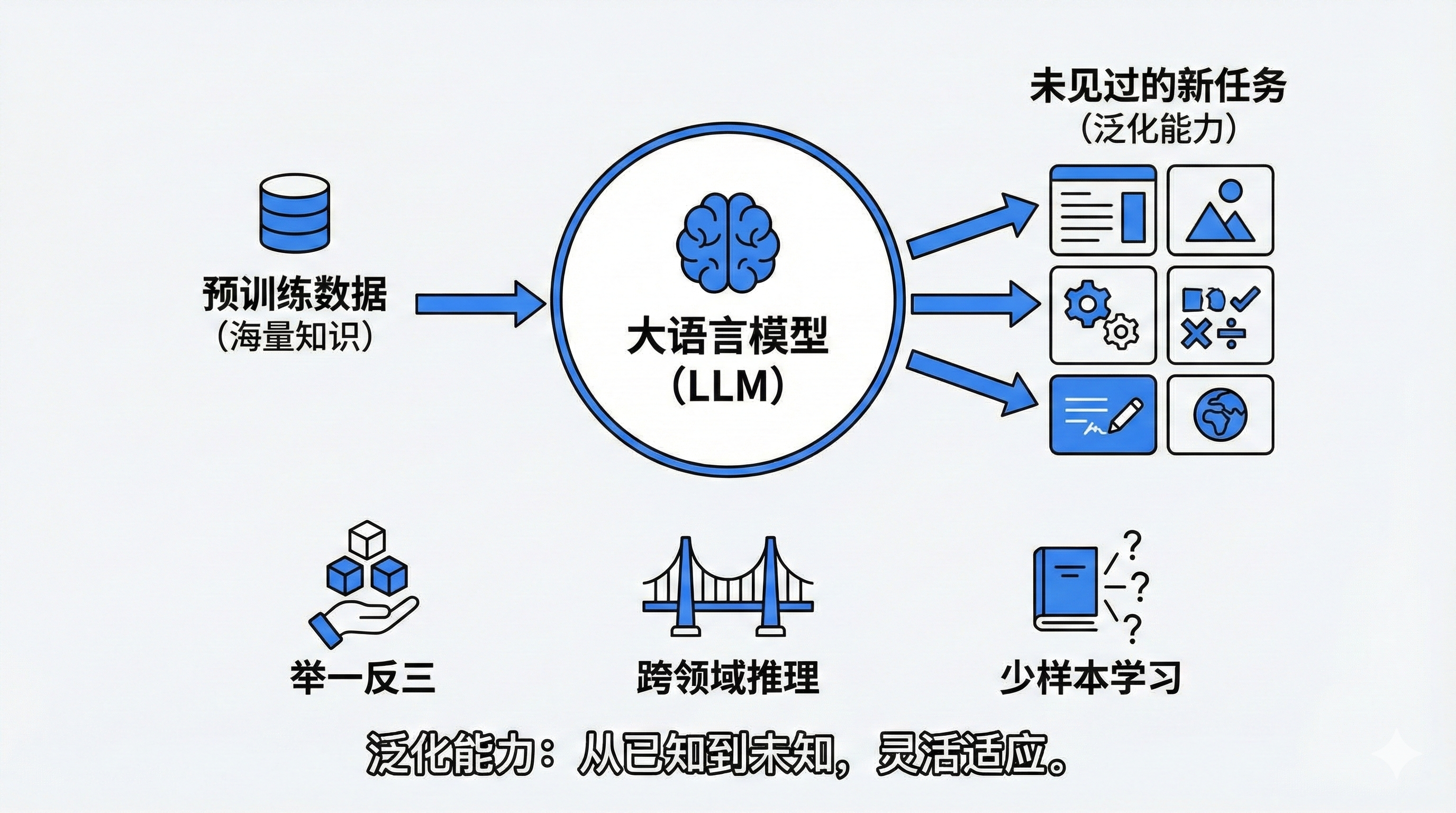

Современный ИИ похож на студента А. Его так называемый интеллект во многом основан на запоминании больших объемов данных методом перебора; он перетренирован на больших расширенных наборах данных для решения конкретных задач, что позволяет ему хорошо справляться с задачами, но не всегда хорошо обобщать результаты на другие области.

Ему не хватает возможности обобщать результаты на другие ситуации при столкновении с незначительными изменениями за пределами обучающих данных, например, при исправлении повторяющейся ошибки.

От наращивания вычислительной мощности к акценту на креативность

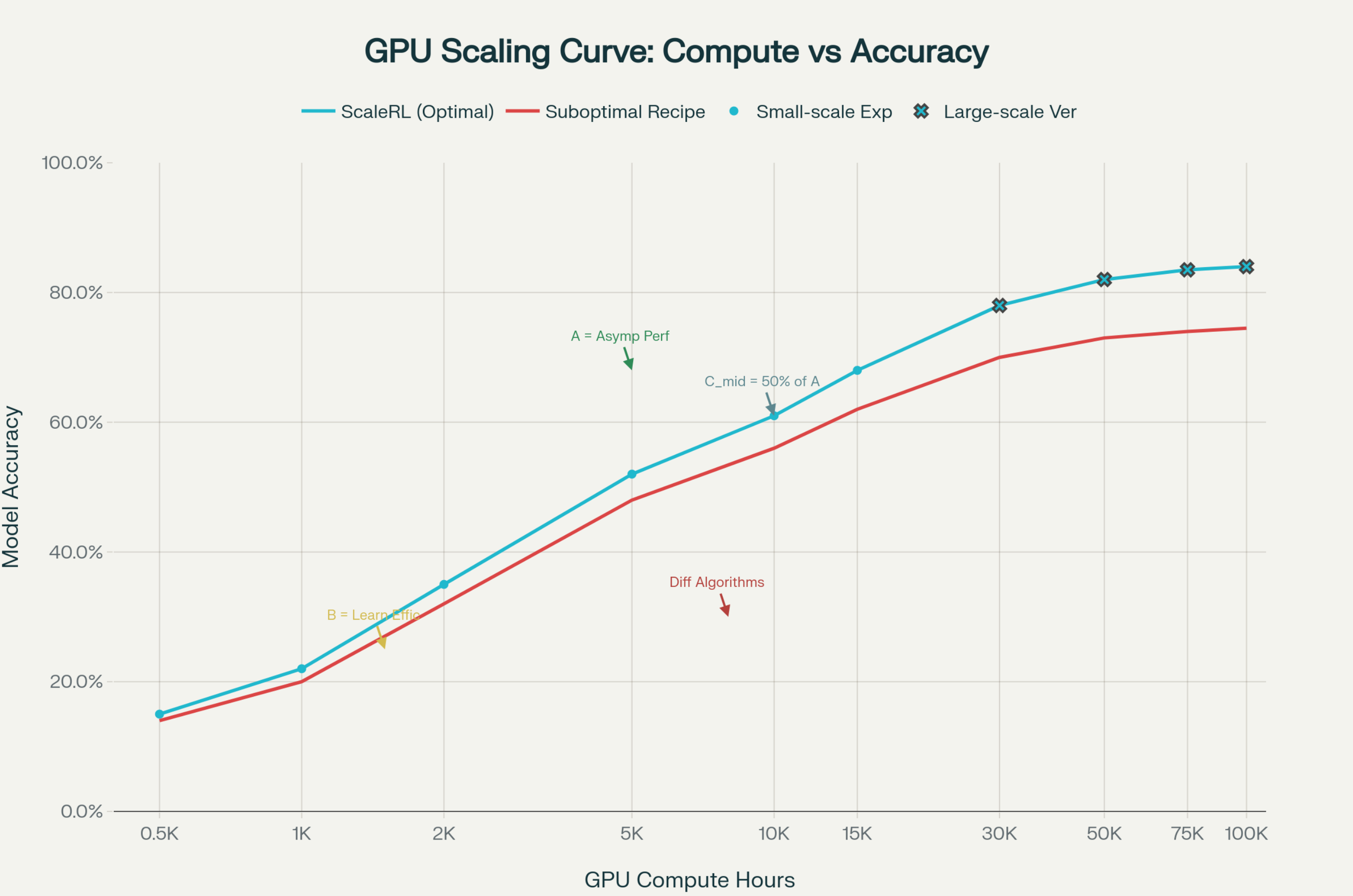

Однако этот метод обучения на огромных объёмах данных не совсем бесполезен. За последние пять лет развитие индустрии искусственного интеллекта (ИИ) в основном следовало так называемому «закону масштабирования»: от больших моделей, измеряемых миллионами параметров в начале, до триллионов параметров в настоящее время. Потребление вычислительной мощности графических процессоров также достигло масштабов, которые, как ожидается, достигнут небес.

Этот подход, объединяющий определённую вычислительную мощность с определённым объёмом данных в нейронную сеть, стал важнейшим этапом разработки всех больших моделей, а именно предобучением. На этапе предобучения нет необходимости думать о том, какие данные использовать, поскольку ответ — это все данные; это весь мир, который люди проецируют в текст.

Илья считает, что само слово «масштабирование» сформировало наше мышление. Оно подразумевает, что нам нужно сделать только одно: увеличить вычислительную мощность, увеличить объём данных, сохранить рецепт прежним и увеличить объём кастрюли, чтобы приготовить хорошее блюдо.

По его словам, такой подход удобен для крупных компаний, поскольку предполагает «низкорисковые» инвестиции. В отличие от исследований, требующих вдохновения и удачи, крупным компаниям не нужно нанимать учёных, чтобы те ломали голову; им достаточно «добавить данные и вычислительные мощности», а результаты более сильной модели предсказуемы.

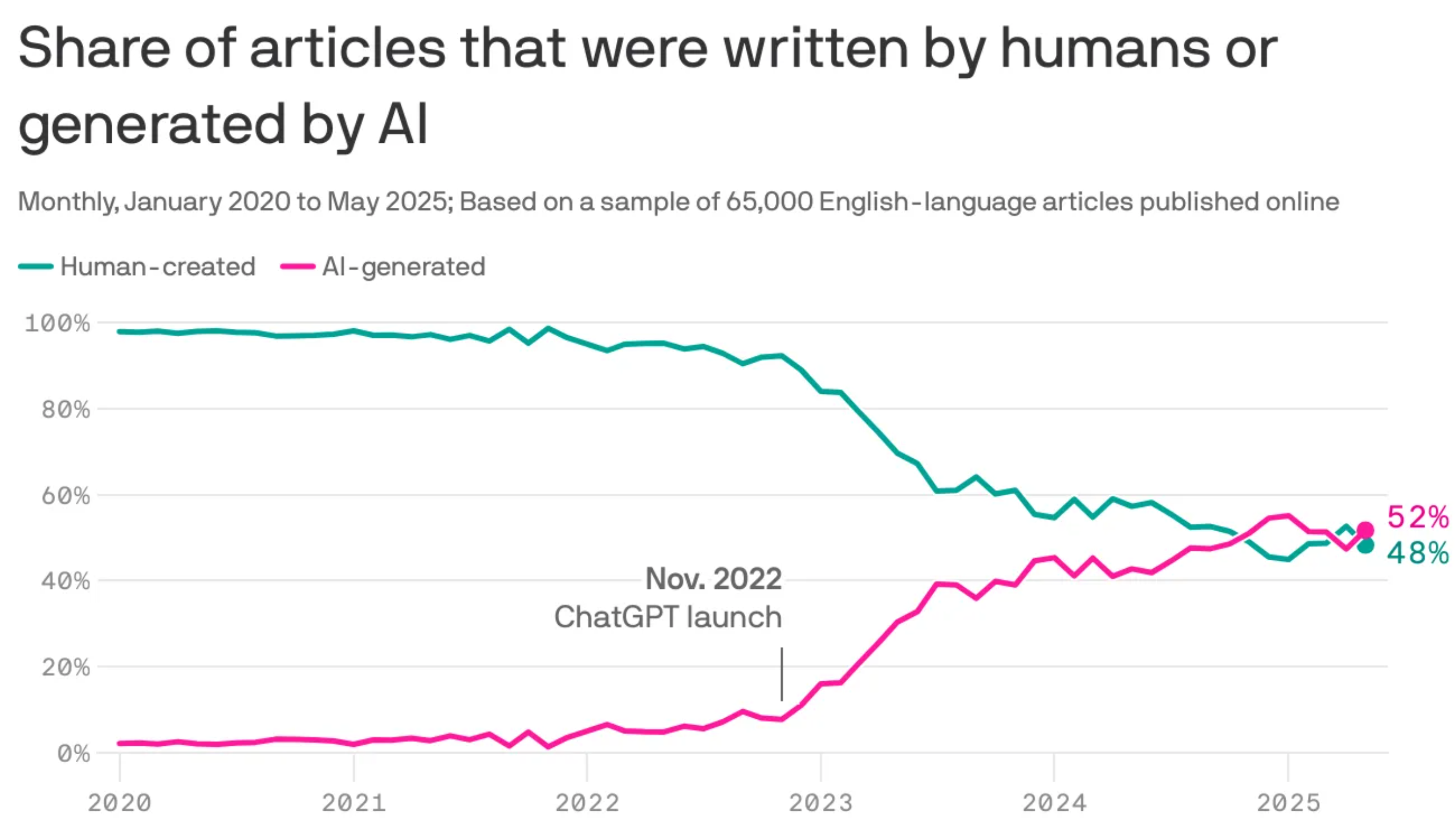

Но теперь возникло узкое место. Недостаточно данных. Наш корпус интернет-текстов, содержащий данные до обучения, ограничен и практически исчерпан. Некоторые исследовательские институты статистически показали, что доля контента, созданного ИИ, в интернете сейчас превышает долю контента, созданного людьми.

Во-вторых, существует маргинальный эффект. Расширение модели в 100 раз может улучшить ситуацию, но не приведёт к качественным изменениям.

Илья также упомянул, что недавно на X некоторые пользователи говорили, что Gemini 3, похоже, решил некоторые проблемы предобучения. Ранее The Information также сообщал, что Альтман опасался, что разработка Google повлияет на OpenAI, и что это даже оказывало на него давление.

Отчасти это связано с тем, что при выпуске GPT-5 возникли проблемы с предобучением: по мере увеличения объёма предобучаемых данных модель не демонстрировала прежнего прироста интеллекта. Напротив, Gemini совершил прорыв. Альтман написал во внутренней служебной записке, что OpenAI также должна решить проблему предобучения, чтобы, возможно, снова превзойти Google.

▲ Ориол Виньялс, вице-президент по исследованиям в Google DeepMind, отметил, что секрет Gemini 3 заключается в решении проблемы предварительной подготовки.

Мы вернулись в эпоху исследований. Только на этот раз у нас гораздо более мощные компьютеры.

Илья делит свои исследования за прошедший период на два этапа. Период с 2012 по 2020 год был эпохой исследований, когда все пробовали и находили новые методы. Период с 2020 по 2025 год — эпохой расширения, когда все бездумно расширяются, растут вычислительные мощности и появляется всё больше компаний, занимающихся ИИ.

Теперь полагаться только на грубую силу для достижения чудес больше невозможно, или, скорее, мы исчерпали преимущества масштабирования. Мы вернулись в эпоху исследований. Однако на этот раз мы используем суперкомпьютеры, созданные в эпоху масштабирования, для проведения исследований — эпохи исследований с колоссальной вычислительной мощностью.

Подводя итог, Илья не отрицает огромного успеха предобучения и масштабирования, но считает, что это низкорискованная эстетика грубой силы, основанная на обмене денег на интеллект, и что эта модель достигла своего предела. Индустрия ИИ должна вернуться к этапу хардкорных исследований, где конкуренция будет основываться на идеях, интуиции и инновациях.

В поисках интуиции: недостающая часть головоломки искусственного интеллекта

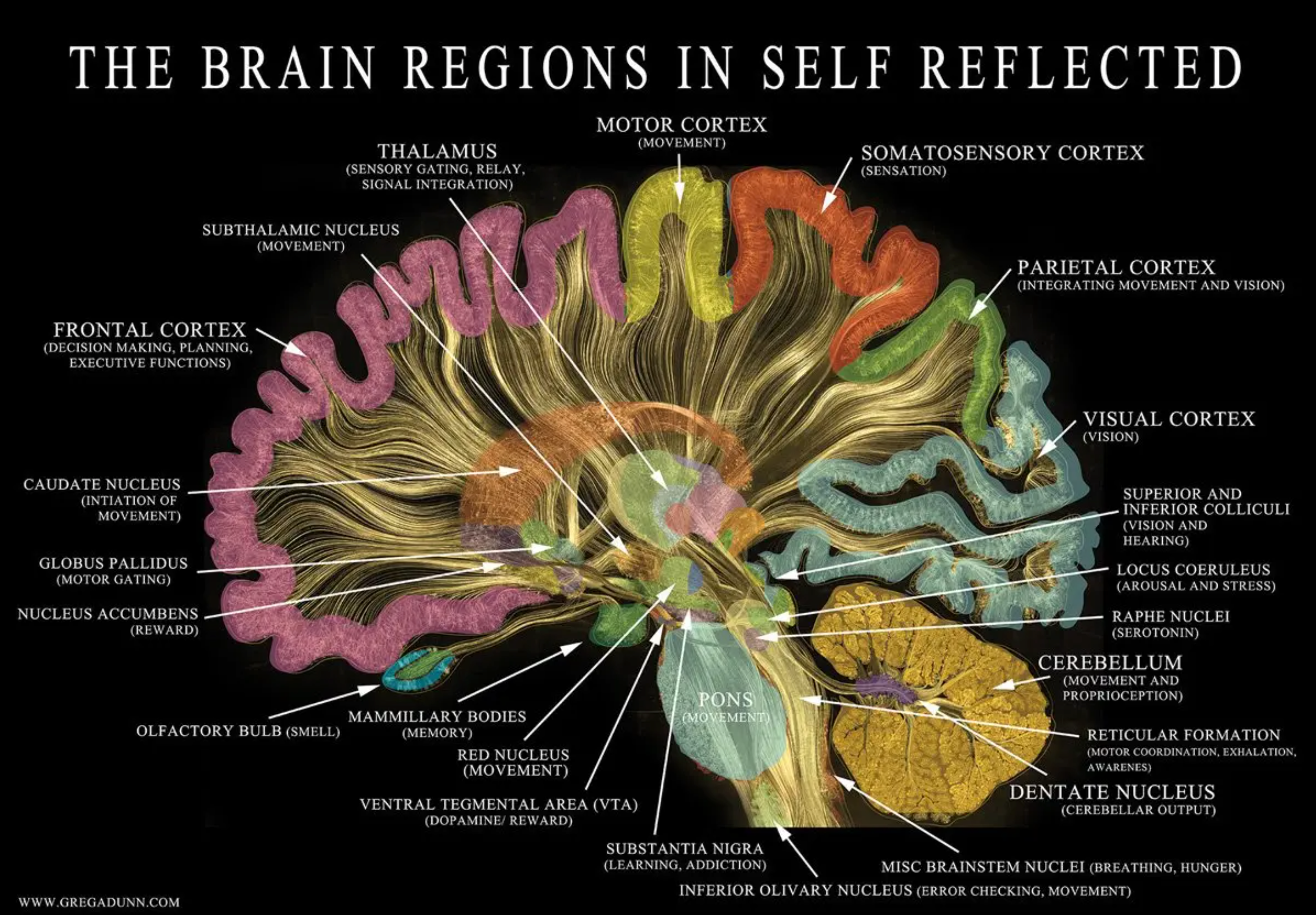

Если простое накопление данных не может породить настоящий интеллект, то в чём же секрет человечества? Ответ Ильи: эмоции .

Он привёл случай пациента с поражением мозга, утратившего эмоциональную способность. Несмотря на нормальный интеллект и красноречие, он часами мучился, выбирая, какую пару носков надеть. Это иллюстрирует, что эмоция — это не просто чувство; это, по сути, ценностная функция.

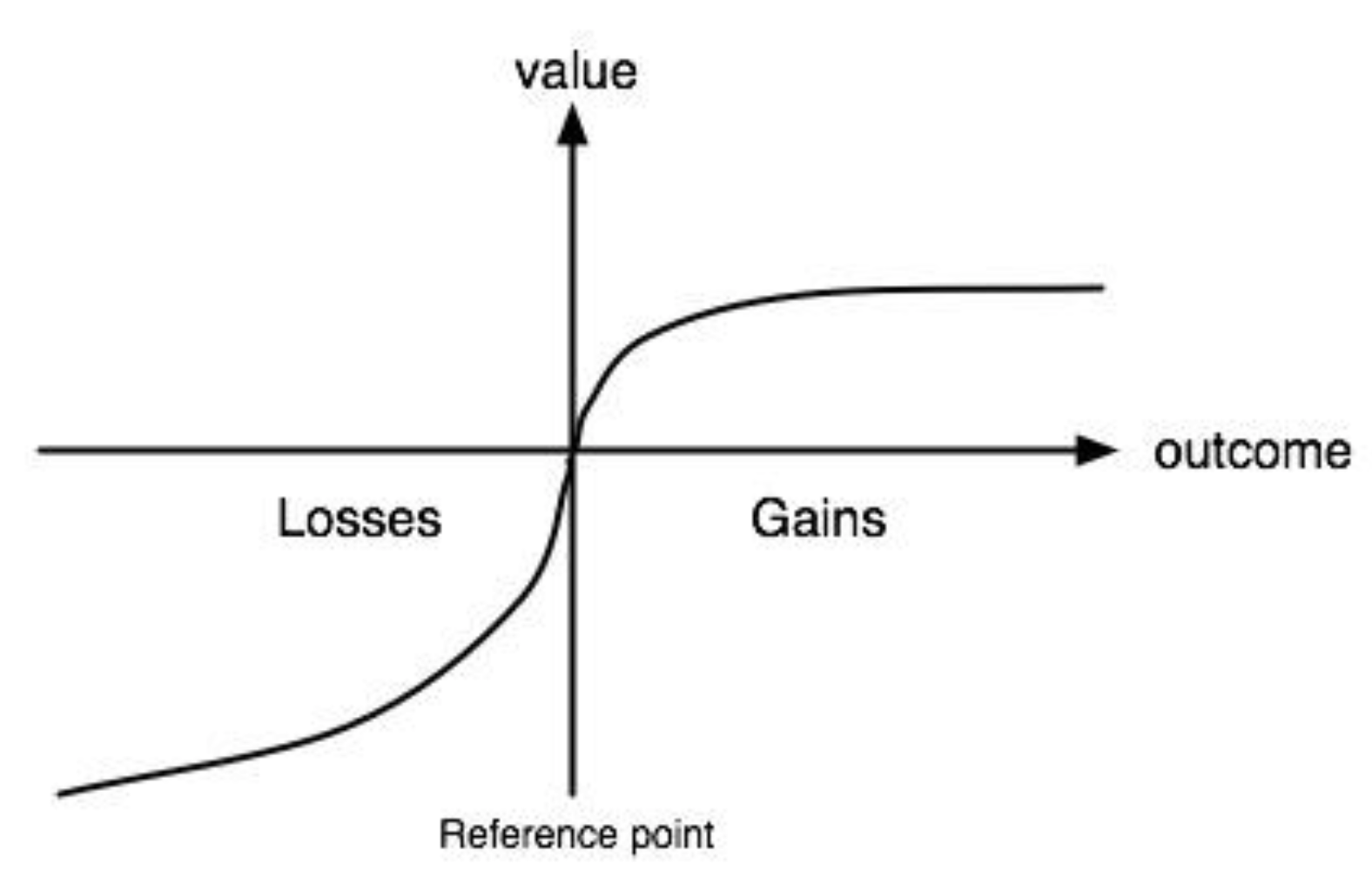

Однако Илья отметила, что не нашла подходящей концепции для аналогии роли эмоций в машинном обучении, поэтому в качестве замены она использует функцию ценности.

Чтобы объяснить, что такое функция ценности, Илья привёл пример с подростком, обучающимся вождению. Подростку может потребоваться всего 10 часов практики или меньше, чтобы научиться водить машину на дороге. Ему не нужно миллионы раз попадать в аварии на симуляторах, подобных современным беспилотным автомобилям с искусственным интеллектом, чтобы научиться объезжать препятствия.

Почему? Потому что у людей чрезвычайно мощная ценностная функция, которая действует как встроенный оценщик. Как только мы отклоняемся от заданной полосы, мы, люди, испытываем тревогу, что равносильно отрицательной обратной связи.

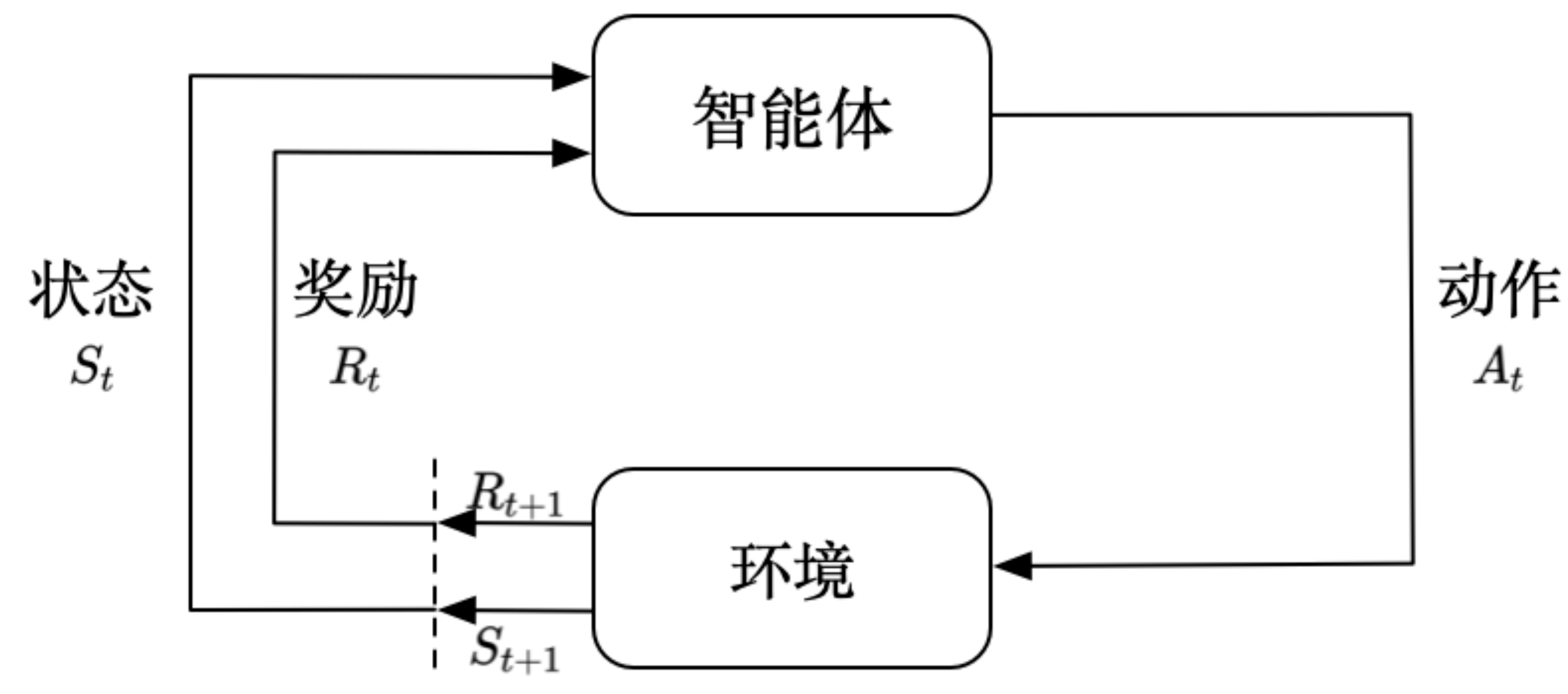

Так в чем же разница между функцией ценности, которая опирается на эмоции, и обучением с подкреплением, о котором мы слышали?

Илья объясняет, что при обучении с подкреплением без промежуточной функции ценности ИИ обычно не знает, выиграл он или проиграл, пока задача не будет полностью выполнена. Однако функция ценности подобна нашей интуиции или внутренней системе оценок. Когда мы теряем фигуру в шахматах, нам не нужно ждать окончания партии; мы сразу же получаем осознание своей ошибки.

Мальчик, учившийся вождению, не ждал, пока он фактически пересечёт линию и потеряет баллы, чтобы исправить свою ошибку; вместо этого он сразу же начинал нервничать или чувствовать себя неуверенно, даже если немного выезжал за пределы полосы. Этот механизм внутренней обратной связи в режиме реального времени позволил ему чрезвычайно эффективно учиться на ограниченном опыте.

Он считает традиционное обучение с подкреплением наивным и неэффективным подходом. В традиционном обучении с подкреплением модель должна перепробовать тысячи действий или мыслительных процессов, прежде чем найдёт окончательное решение, а затем получить оценку, то есть обучающий сигнал, основанный на качестве этого окончательного результата.

Это означает, что модель ничему не обучается, прежде чем прийти к окончательному решению. Этот метод требует больших вычислительных ресурсов для длительных выводов, но объём обучения, необходимый для каждого вывода, относительно невелик.

Функция ценности не обязательно должна дожидаться завершения; она может обеспечить оценку промежуточного процесса. Она подаёт сигналы на каждом шаге, указывая направление, тем самым значительно сжимая пространство поиска и ускоряя обучение.

Современному ИИ не хватает столь эффективной внутренней системы оценки. Если мы сможем наделить ИИ способностью к оценочным суждениям, подобной человеческим эмоциям или инстинктам, он сможет освободиться от зависимости от огромных объёмов данных и действительно учиться так же эффективно, как человек.

Следующий шаг Ильи — прямой доступ к сверхразуму.

Что планирует делать новая компания Ильи SSI (Safe Superintelligence) в связи с тем, что эпоха опоры исключительно на вычислительную мощность закончилась, и что мощные функции оценки могут стать новым подходом к развитию искусственного интеллекта?

Его ответ носит крайне идеалистический характер, напрямую ведущий к сверхразуму. Они решили заняться самой фундаментальной проблемой и добиться надёжного обобщения .

Илья прямо заявил, что современная индустрия искусственного интеллекта попала в «крысиные бега». Чтобы выжить в рыночной конкуренции, компании вынуждены постоянно выпускать незаконченные продукты и идти на непростые компромиссы между удобством использования и безопасностью. SSI стремится отстраниться от этой коммерческой суеты, работать изолированно и в конечном итоге создать настоящий сверхинтеллект.

Интересно, что идея Ильи о «затворническом обучении» начинает давать сбои. Он начинает понимать, что постепенное освобождение может быть единственным безопасным и необходимым путём.

Почему? Потому что человеческое воображение ограничено. Если просто писать статьи и публиковать статьи, рассказывая людям о невероятной мощи ИИ, они сочтут это научной фантастикой. Только когда люди своими глазами увидят, как ИИ демонстрирует пугающую мощь, все, включая конкурентов, по-настоящему почувствуют страх и станут более внимательны к вопросам безопасности.

Илья прогнозирует, что по мере роста мощности ИИ технологические гиганты, которые в настоящее время находятся в состоянии жесткой конкуренции, в конечном итоге придут к единому мнению относительно стратегий обеспечения безопасности на основе ИИ.

В подкасте он также упомянул, что, хотя SSI привлекла меньше финансирования по сравнению с такими крупными лабораториями, как OpenAI и Google, у неё больше вычислительных мощностей, предназначенных для чистых исследований, чем кажется. Он отметил, что эти крупные компании выделяют значительные вычислительные ресурсы на разработку продукта и имеют большие инженерные и отделы продаж, что приводит к распылению ресурсов. Илья считает, что SSI обладает достаточной вычислительной мощностью, чтобы доказать правильность своих идей.

На вопрос о модели получения прибыли Илья ответил просто: «Мы сосредоточены только на исследованиях; вопрос о зарабатывании денег, естественно, решится позже». Ведущий также упомянул, что бывший генеральный директор (соучредитель) SSI решил уйти и присоединиться к Meta, когда Meta захотела приобрести SSI.

Илья особо уточнил: «Он единственный, кто отправился на Мету». Он создал SSI не для того, чтобы нажиться на коммерческом рынке, а ради одной-единственной цели: создать безопасный сверхразум до наступления необратимой сингулярности.

Переосмысление ИИ: 15-летний мальчик

Насколько мы далеки от AGI? По прогнозам Ильи, это займет от 5 до 20 лет.

Однако он предостерёг нас от термина «ИИОН». Предварительно обученные модели создают иллюзию, что ИИОН — это всезнающая энциклопедия. Но видение Ильёй сверхразума скорее похоже на видение исключительно умного 15-летнего подростка.

Этот молодой человек, возможно, ещё не изучал юриспруденцию или медицину, но он обладает исключительной способностью к обучению. Если бы вы позволили ему изучать медицину, он, вероятно, смог бы прочитать всю медицинскую литературу человечества всего за несколько дней и начать проводить операции.

Самая пугающая концепция в этом видении — слияние.

Трагедия человечества заключается в том, что знания невозможно скопировать напрямую. Один человек учится водить, а другому всё равно приходится учиться с нуля. Однако с искусственным интеллектом всё иначе. Илья описывает сценарий, в котором миллионы ИИ-аватаров работают в разных секторах экономики: одни пишут код, другие ведут судебные иски. Они обучаются самостоятельно, а затем интегрируют весь свой опыт в единый мозг.

Эту скорость коллективной эволюции он и считает ОИИ.

Что же должно предпринять человечество, столкнувшись с таким супермозгом, способным мгновенно интегрировать тысячи впечатлений?

Илья предлагает два уровня рассмотрения. Во-первых, дизайн ИИ. Не ограничивайте его любовью только к людям, это слишком узко. Будущий ИИ также будет разумным существом; нам следует использовать принцип эмпатии, чтобы он заботился обо всех разумных существах — потенциально более надёжная мера безопасности, чем код.

Во-вторых, у человечества есть запасной план. Если бы у каждого был ИИ-агент в сто раз умнее, стало бы человечество лишь сторонним наблюдателем истории? Илья предложил ответ, который, как он честно признал, ему «не понравился, но, возможно, это единственное решение»: интерфейсы «мозг-компьютер» (Neuralink).

Только когда человечество решит слиться с ИИ, позволив пониманию ИИ напрямую стать нашим пониманием, мы сможем остаться главными героями этого мира после этой сингулярности.

В конце подкаста Дваркеш задал вопрос, который хотели задать все: как легенда в области искусственного интеллекта, как вам удается раз за разом оказываться правым?

Ответ Ильи был подобен ответу художника: «Ищу красоту».

В самые тёмные моменты, когда никакие данные не поддерживают вас, вас может поддержать только нисходящая вера в красоту, простоту и биологическую рациональность. Поскольку нейронные сети имитируют работу мозга, а мозг прекрасен, это, должно быть, верный путь к интеллекту.

Возможно, это то качество, о котором Илья говорит как о самом необходимом в «эпоху исследований»: помимо вычислительной мощности, сохранение поэтической интуиции относительно сущности интеллекта.

#Добро пожаловать на официальный аккаунт iFanr в WeChat: iFanr (WeChat ID: ifanr), где вы сможете как можно скорее получить еще больше интересного контента.

ifanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo