После того, как компания OpenAI назвала ее своим именем, Zhipu только что выпустила новую модель с открытым исходным кодом: самую универсальную отечественную поисковую систему, создающую поисковую систему в одном предложении.

Открытое ПО для отечественных производителей крупномасштабных моделей продолжает развиваться ускоренными темпами.

Только что компания Zhipu официально представила свою новейшую флагманскую модель GLM-4.5. Согласно официальному заявлению Zhipu, это «базовая модель, разработанная специально для агентурного применения».

Следуя нашим принципам открытого исходного кода, эта модель теперь доступна одновременно на платформах Hugging Face и ModelScope. Весовые коэффициенты модели соответствуют лицензии MIT и могут использоваться в коммерческих целях.

Версия с экономией потока:

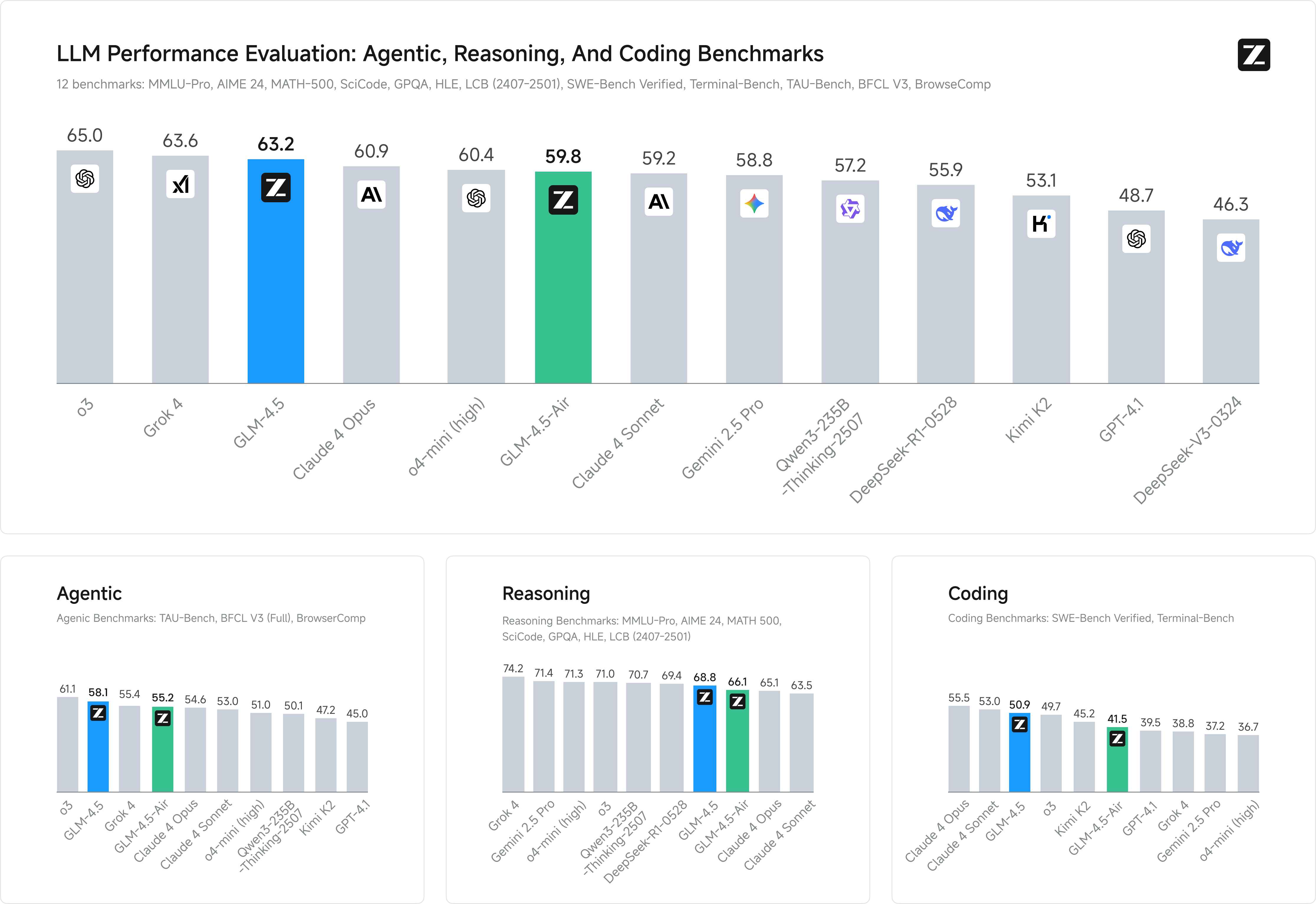

- GLM-4.5 достигла самого современного уровня среди моделей с открытым исходным кодом с точки зрения рассуждений, кода и комплексных возможностей агента.

- GLM-4.5 использует архитектуру смеси экспертов (MoE), включая GLM-4.5: общее количество параметров — 355 миллиардов, параметры активации — 32 миллиарда; GLM-4.5-Air: общее количество параметров — 106 миллиардов, параметры активации — 12 миллиардов;

- Обе версии имеют полностью открытый исходный код и поддерживают лицензию MIT;

- Как GLM-4.5, так и GLM-4.5-Air поддерживают гибридный режим рассуждений, предоставляя два режима: режим мышления для сложных рассуждений и использования инструментов и режим отсутствия мышления для немедленного реагирования.

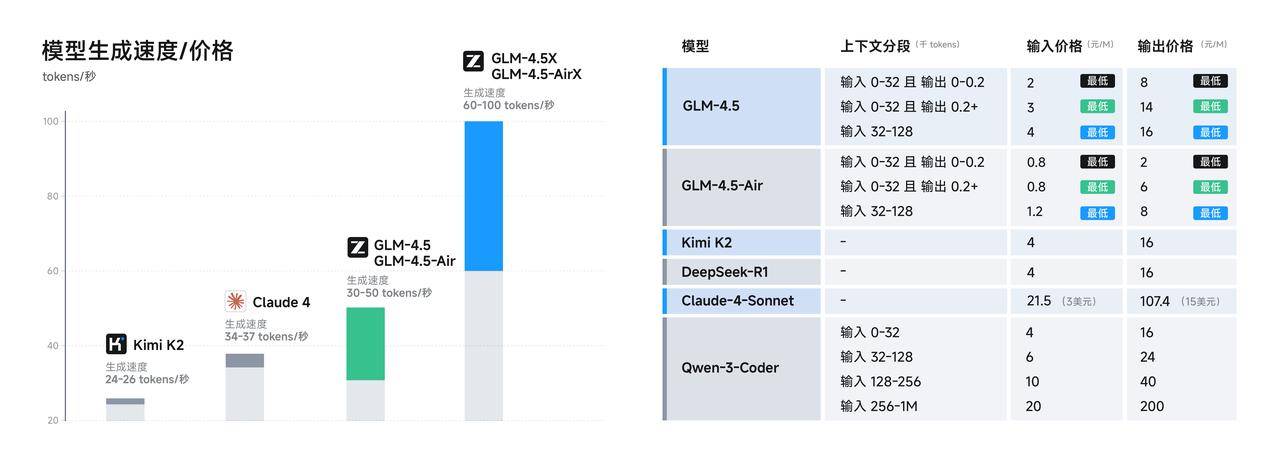

- Стоимость вызова API составляет всего 0,8 юаня/миллион токенов для ввода и 2 юаня/миллион токенов для вывода; высокоскоростная версия может достигать 100 токенов в секунду.

Ключевым техническим преимуществом GLM-4.5 является первая встроенная интеграция функций рассуждений, кодирования и агентских функций в единую модель. В то время как другие модели превосходят только рассуждения, кодирование или функции помощника, GLM-4.5 может похвастаться всеми этими возможностями.

Как обычно, давайте сначала рассмотрим раздел «текущий счет» новой модели.

Для демонстрации своей производительности Zhipu выбрала 12 наиболее репрезентативных бенчмарков, включая MMLU Pro, AIME 24, MATH 500, SciCode, GPQA и HLE — все они нам хорошо знакомы. Средний балл показал, что GLM-4.5 занял второе место в мире, первое среди отечественных моделей и первое среди моделей с открытым исходным кодом.

Конечно, одни только текущие результаты бесполезны, и более убедительными будут практические тесты.

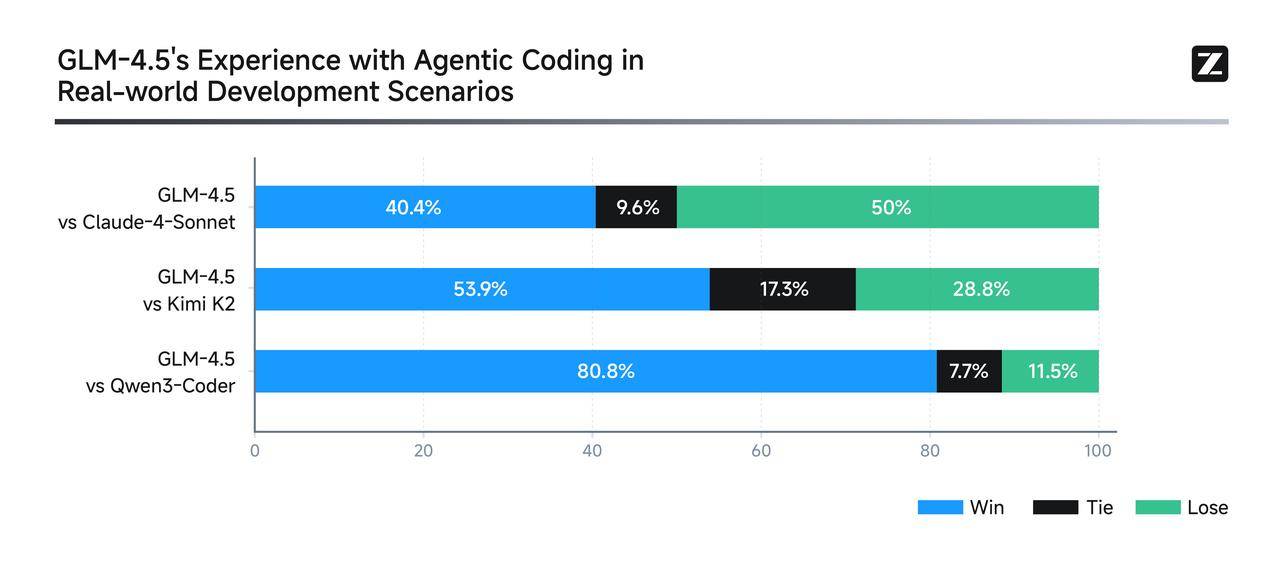

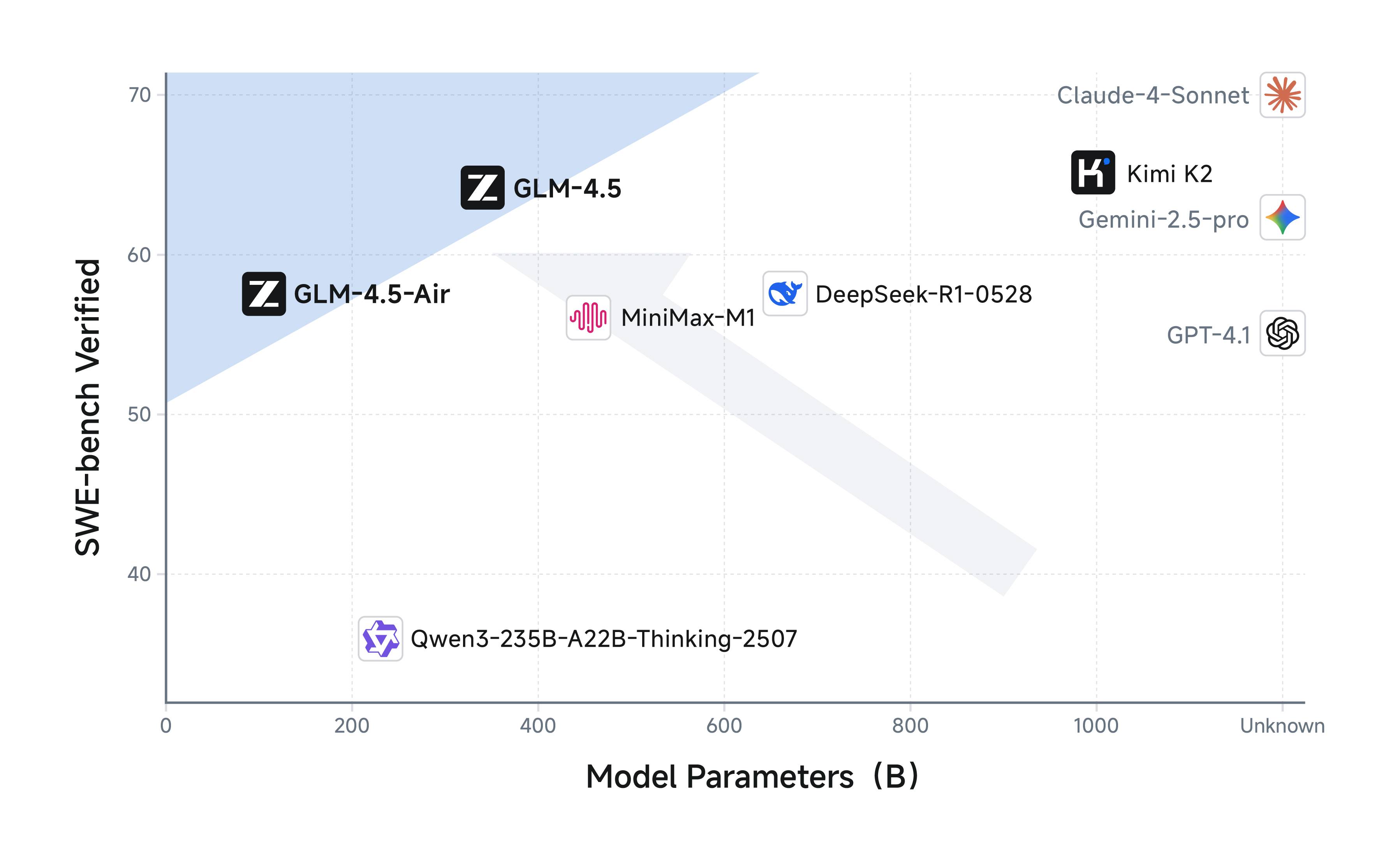

Чтобы продемонстрировать мощь GLM-4.5 в реальных сценариях кодирования агентов, Zhipu напрямую интегрировал его с Claude Code, чтобы конкурировать с такими моделями, как Claude-4-Sonnet, Kimi-K2 и Qwen3-Coder.

План тестирования был весьма строгим: в общей сложности 52 задачи разработки, охватывающие шесть основных областей разработки, были протестированы в нескольких раундах интерактивного тестирования в независимых контейнерных средах с упором на выполнение в реальных условиях. Результаты показали, что, несмотря на значительные возможности для улучшения при работе с Claude-4-Sonnet, GLM-4.5 по-прежнему показал себя достаточно хорошо с точки зрения надежности вызова инструментов и завершения задач.

Zhipu даже опубликовал все тестовые вопросы и траектории агентов (https://huggingface.co/datasets/zai-org/CC-Bench-trajectories), что дало мне ощущение, что они приветствуют коллег, «борющихся с фейками».

Давайте рассмотрим еще несколько убедительных демонстраций, которые также весьма ценны.

Просто введите запрос «Создать сайт поиска Google» на официальном сайте z.ai, и GLM-4.5 фактически создаст работающую поисковую систему всего за одно предложение.

Квантовый функциональный блок, созданный GLM-4.5, полностью функционален и в полной мере демонстрирует всесторонние возможности модели.

Для более сложного решения вы также можете создать масштабируемую 3D-страницу глобуса, на которой пользователи могут нажать на местоположение, чтобы увидеть подробности, что будет сопровождаться плавной анимацией масштабирования.

▲Совет: Создайте веб-страницу с помощью Three.js и JavaScript, которая создаст трёхмерный мир, отображающий места, которые я посетил, на основе массива. Нажатие на маркеры на трёхмерном глобусе активирует эффект масштабирования и откроет подробную информацию о поездке с фотографиями.

В отличие от традиционных инструментов PowerPoint на базе искусственного интеллекта, которые используют шаблоны для заполнения информации, GLM-4.5 самостоятельно ищет ресурсы и изображения, а затем создаёт презентации непосредственно в HTML на основе фактических материалов. Помимо стандартного соотношения сторон 16:9, он также гибко поддерживает обложки социальных сетей, длинные изображения, визитки «сяохуншу» и даже личные резюме.

Что касается удобства для разработчиков, китайские производители также начинают совершенствоваться. Например, GLM-4.5 совместим с такими популярными инструментами анализа кода, как Claude Code, Cline и Roo Code. Полное руководство пользователя доступно здесь:

- Для внутренних пользователей: https://docs.bigmodel.cn/cn/guide/develop/claude

- Зарубежные пользователи: https://docs.z.ai/scenario-example/develop-tools/claude

Если все вышесказанное — это только «лицо», то настоящая «внутренность» GLM-4.5 — это техническое ядро.

Малоизвестный факт: количество параметров GLM-4.5 составляет всего лишь половину от DeepSeek-R1 и треть от Kimi-K2, но производительность при этом не страдает. Это обусловлено более высокой эффективностью параметров модели GLM.

В частности, GLM-4.5-Air с общими параметрами 106 байт и параметрами активации 12 байт уже приблизился к производительности Gemini 2.5 Flash и Claude 4 Sonnet в тестах логического вывода. Он также находится на границе Парето по соотношению производительности к параметрам в списке проверенных SWE-bench — другими словами, он обеспечивает превосходное соотношение цены и производительности при меньших размерах.

Улучшение результатов неотделимо от «чудотворности» тренировочного процесса.

GLM-4.5 и GLM-4.5-Air используют схожий процесс обучения: сначала они проходят предварительную подготовку на 15 триллионах токенов общих данных. Затем проводится целевое обучение на 8 триллионах токенов данных в таких областях, как код, рассуждения и агенты. Наконец, обучение с подкреплением используется для дальнейшего улучшения возможностей модели в области рассуждений, кода и агентов. Имея деньги и ресурсы, можно действительно делать всё, что угодно.

Более того, прорывы GLM-4.5 в плане стоимости и эффективности могут быть ещё более значительными. Стоимость API-вызовов составляет всего 0,8 юаня за миллион токенов для ввода и 2 юаня за миллион токенов для вывода. Более того, высокоскоростная версия может генерировать токены с замеренной скоростью до 100 токенов в секунду, что соответствует требованиям к низкой задержке и высокому уровню параллелизма, предъявляемым к развёртыванию реальных приложений. Это действительно значительное снижение цены.

API теперь доступен на открытой платформе BigModel.cn и совместим с фреймворком Claude Code в один клик. Обычные пользователи также могут опробовать полнофункциональный GLM-4.5 на платформах Zhipu Qingyan (chatglm.cn) и Z.ai.

Стоит отметить, что в прошлом месяце OpenAI прямо упомянула Zhipu в отчёте, опубликованном в своём аккаунте Global Affairs, заявив о значительном прогрессе компании в глобальной конкуренции в области искусственного интеллекта. Тон публикации можно назвать необычным и прямолинейным.

Оглядываясь назад, можно сказать, что Zhipu — относительно стабильно растущая компания, сохраняющая стабильный темп, постоянно совершенствующая модели, либерализующая инициативы с открытым исходным кодом и сохраняющая чёткое понимание направления. В этом свете неудивительно, что она стала первым из «шести маленьких драконов» искусственного интеллекта, вышедшим на IPO.

#Приглашаем вас следить за официальным публичным аккаунтом WeChat проекта iFaner: iFaner (WeChat ID: ifanr), где в ближайшее время вам будет представлен еще более интересный контент.

iFanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo