Apple добавляет функцию обнаружения наготы в FaceTime, выбор между конфиденциальностью и этикой

Вы наверняка видели рекламу Apple и Юэ Юньпэна, основное предложение которой заключается в следующем:

Стремление обеспечить конфиденциальность и безопасность — это как раз то, что нужно iPhone.

Apple так сказала и действительно так сделала. Однако когда «конфиденциальность» и «мораль» оказываются на обоих концах шкалы, даже Apple сталкивается с дилеммой.

▲ Совместный рекламный плакат Apple и Юэ Юньпэна. Источник изображения: Apple

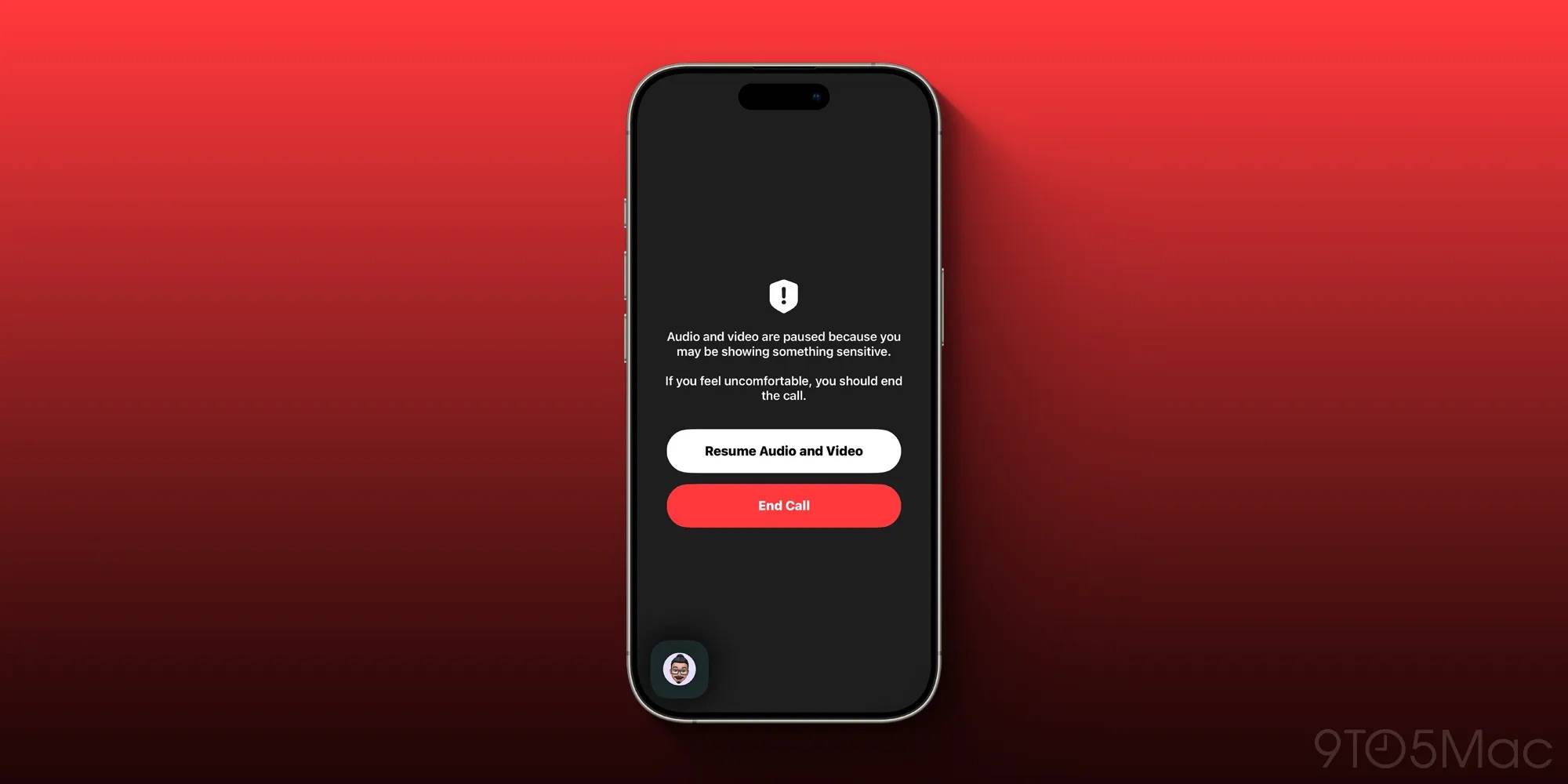

По данным 9to5mac , Apple запустила функцию обнаружения наготы для FaceTime в предварительной версии для разработчиков iOS 26, которая предназначена для обнаружения неприемлемой наготы во время видеозвонков.

Сообщается, что Apple будет использовать алгоритм ИИ на стороне устройства для определения обнаженного контента в звонках в режиме реального времени. Когда система определяет возможные обнаженные сцены, она немедленно приостанавливает видеозвонок и отображает предупреждение.

Apple заявила, что изначально эта функция была разработана для использования в детских аккаунтах, чтобы предоставить подросткам более безопасную цифровую социальную среду.

▲ Замороженный интерфейс FaceTime. Изображение от: 9to5Mac

Эта функция возникла из программы сканирования CSAM (детские материалы сексуального насилия), которую Apple запустила несколько лет назад. Но по какой-то причине эта функция была расширена для охвата пользователей всех возрастов в версии для разработчиков iOS 26. Другими словами, взрослые пользователи также «защищены».

Хотя Apple подчеркнула, что вся работа по распознаванию обрабатывается локально на устройстве и данные не будут загружаться в облако, расширение охвата возраста вызвало широкую полемику в социальных сетях. Пользователь под именем krazygreekguy прокомментировал на 9to5mac:

Я понимаю, что за этим стоит, но у них нет права осуществлять такой контроль над взрослыми. Ни одна организация не имеет права вторгаться в личную жизнь людей.

▲ Рекламное изображение Apple. Источник изображения: Apple

Другими словами, люди обеспокоены тем, что это расширение возрастного диапазона представляет собой расширение уникальной власти Apple, вплоть до чрезмерного вмешательства в частную жизнь, и может даже распространиться на сценарии, не имеющие ничего общего с порнографическими намерениями.

Представьте, что вы разговариваете по видеосвязи с ребенком дома. Просто потому, что вы без рубашки или поправляете одежду, система может ошибочно определить вас как неподобающе обнаженного, что приведет к блокировке видео:

Мой iPhone думает, что я извращенец?

▲ FaceTime. Изображение от: Apple

На самом деле FaceTime существует уже 14 лет. Как «ветеран» экосистемы Apple, это не первый раз, когда он вызывает споры. В 2019 году в FaceTime была техническая лазейка, которая позволяла пользователям слышать звонок другого абонента без подключения. Хотя Apple быстро устранила лазейку, она также заставила многих людей усомниться в реальных возможностях защиты Apple под риторикой пропаганды конфиденциальности.

▲ Рекламное изображение Apple. Источник изображения: Apple

Apple всегда придавала большое значение защите конфиденциальности пользователей, считая это основной ценностью компании.

Те, кто давно следит за Apple, возможно, еще помнят инцидент 2015 года, когда Apple столкнулась с ФБР. После стрельбы в Сан-Бернардино в Калифорнии ФБР запросило разблокировать iPhone, который использовал убийца, чтобы получить информацию о террористической деятельности, но Apple отказалась. В то время генеральный директор Apple Тим Кук сказал: После того, как бэкдор открыт, его нельзя закрыть, что поставит под угрозу безопасность и конфиденциальность всех пользователей.

▲ Интерфейс FaceTime. Изображение от: Apple

Но даже в этом случае Apple также вызвала некоторые споры из-за проблем с конфиденциальностью. Например, упомянутый выше план сканирования CSAM также подвергся критике, когда был запущен.

Начиная с iOS 15 в 2021 году Apple использует технологию NeuralHash на локальных устройствах для сравнения хеш-значений фотографий, загруженных пользователями в iCloud, с базой данных CSAM, которую ведут авторитетные агентства США. При превышении заданного порога Apple расшифрует соответствующие данные и проведет ручную проверку. После подтверждения учетная запись будет отключена и передана в Национальный центр по пропавшим и эксплуатируемым детям (NCMEC).

Apple утверждает , что цель этой функции — выявлять и ловить лиц, совершающих сексуальные преступления в отношении детей, максимально защищать конфиденциальность пользователей с технической точки зрения и избегать ошибочных суждений и злоупотреблений.

Однако организации по защите конфиденциальности и эксперты по безопасности задаются вопросом, отступит ли Apple от своих последовательных обязательств по защите конфиденциальности. В конце концов, сканирование CSAM по сути идентифицирует личную информацию, загружаемую пользователями. Столкнувшись с давлением, Apple объявила, что отложит выпуск этой функции и вместо этого запустит другие меры по защите детей, такие как безопасность информации и общения и функции вмешательства в поиск Siri.

Для Apple «мораль» и «конфиденциальность» не могут быть достигнуты одновременно.

Возвращаясь к обнаружению наготы FaceTime, упомянутому в начале: по изначальному замыслу Apple, это функция безопасности, запущенная для лучшей защиты подростков. Она помогает предотвратить демонстрацию подростками неподобающей наготы во время видеозвонков. Существует бесчисленное множество подобных случаев сексуальных домогательств и мошенничества во время мобильных видеозвонков по всему миру. Имея более миллиарда пользователей, Apple действительно должна нести такую социальную ответственность.

Но с другой стороны, где проходят границы этого «автоматического вмешательства», остается важным вопросом.

Когда общественная мораль и личная неприкосновенность частной жизни оказываются на разных концах весов, вопрос о том, как взвесить все «за» и «против» и принять «правильное» решение, может беспокоить Apple еще долгое время в будущем.

Авторы: Чжоу Цяньтун, Сяо Циньпэн

#Добро пожаловать на официальный публичный аккаунт WeChat iFanr: iFanr (WeChat ID: ifanr), где вам будет представлен еще более интересный контент как можно скорее.

iFanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo