Даже без доступа в Интернет роботы наконец-то «избавились» от человеческого контроля! Google запускает свой первый автономный мозг ИИ, который может работать всего с одним предложением

Мы видели слишком много роботов, выходящих из-под контроля в фильмах и телешоу. Мы также выучили наизусть некоторые решения: отключите Интернет, выньте шнур питания и перезапустите робота, и он будет переделан одним щелчком.

Однако сейчас этот процесс может работать не так хорошо.

Сегодня Google DeepMind запустила новую модель управления роботом – Gemini Robotics On-Device. Эта большая модель может работать локально на роботе и объединяет визуальное распознавание, понимание языка и выполнение действий.

Его главная особенность в том, что даже в автономном режиме он может понимать человеческие инструкции и беспрепятственно выполнять задачи.

По сравнению с большими моделями, такими как ChatGPT и Gemini, которые хорошо справляются с чатом, письмом и ответами на вопросы, Gemini Robotics On-Device оснащает робота настоящим «мозгом», что позволяет ему иметь аналогичные возможности понимания и исполнения.

По сути, это базовая модель VLA, специально разработанная для роботов с двумя руками. Как следует из названия, сочетание Vision + Language + Action означает, что он может видеть, слышать, понимать и двигаться, что является его основными качествами.

Например, вы можете обратиться к роботу с просьбой: «Пожалуйста, сложите этот предмет одежды, положите его в рюкзак и застегните молнию». Раньше для этого требовалось писать программы и заранее разбивать действия. Теперь Gemini On-Device может напрямую понимать смысл этого предложения, а затем выполнять его шаг за шагом.

Так зачем же запускать его локально, если его можно запустить через Интернет? Ответ — не более, чем скорость и стабильность.

Если роботу нужно передать данные в облако, дождаться, пока сервер их проанализирует, а затем вернуть результаты, задержки неизбежно возникнут. В таких задачах, как медицинские операции, ликвидация последствий стихийных бедствий и автоматизация фабрик, допустимая задержка практически равна нулю. Более того, в реальности во многих местах плохое качество связи или ее вообще нет.

На самом деле, наделение роботов способностью успешно справляться со сложными и динамичными задачами реального мира всегда было одной из самых сложных задач в области ИИ.

Из общедоступных видеороликов мы видим, что Gemini On-Device уже способен обрабатывать множество распространенных сценариев, таких как складывание одежды, застегивание молний, захват незнакомых предметов и размещение их в определенных местах. Все это благодаря его механизму обучения.

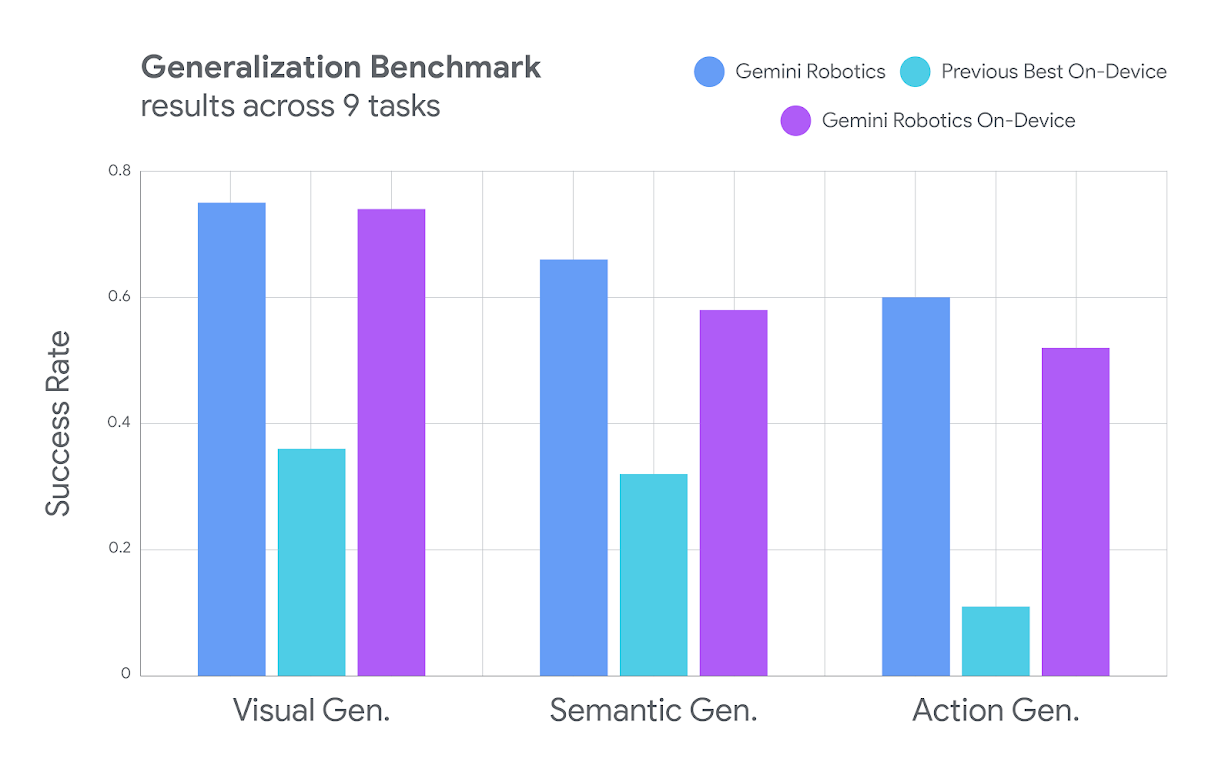

▲Сильная способность к обобщению

Не требуется долгосрочное обучение с нуля. Разработчикам достаточно предоставить от 50 до 100 ручных демонстраций, например, лично управлять роботом для складывания одежды, и модель может быстро обучаться и работать самостоятельно.

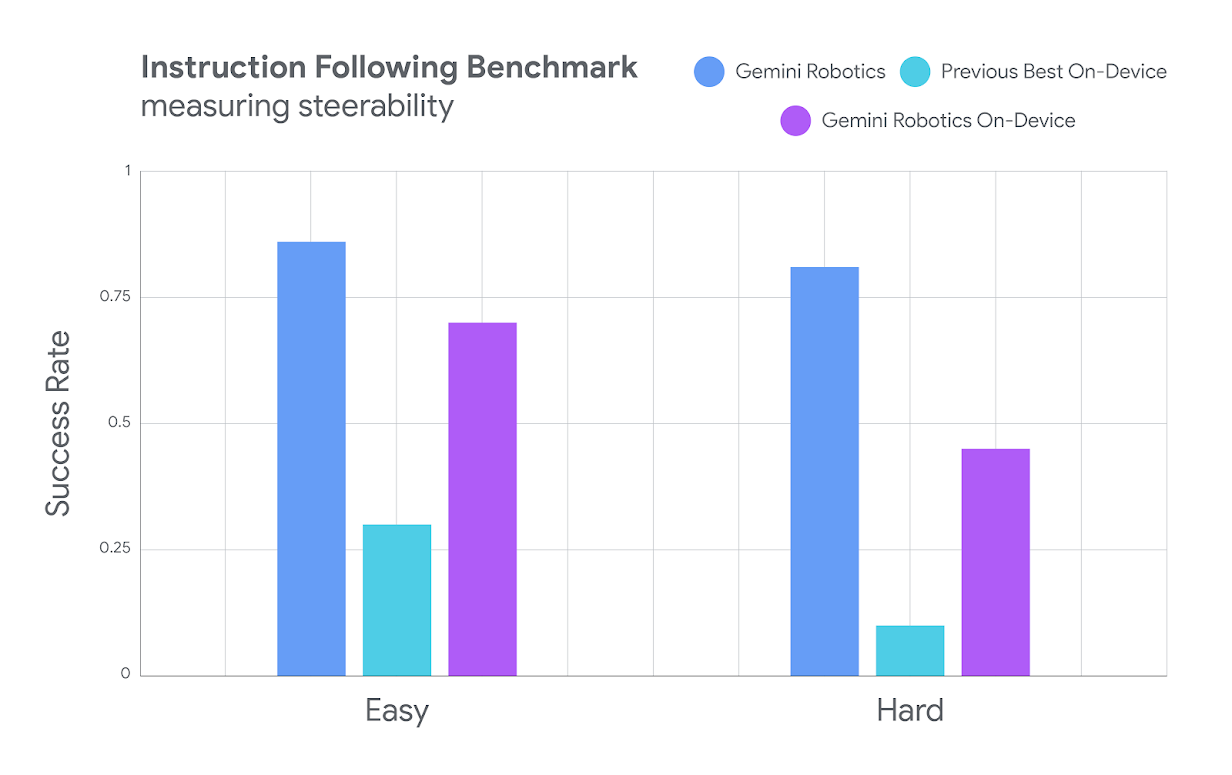

При выполнении более сложных распределенных задач или многошагового выполнения сложных инструкций Gemini Robotics On-Device продолжает превосходить другие существующие локальные альтернативы.

Более того, он очень легко адаптируется.

Хотя Gemini Robotics On-Device изначально обучался на двухрукой роботизированной платформе ALOHA собственной разработки Google, после небольшой адаптации он также может стабильно работать на промышленной роботизированной руке Franka FR3.

Даже конструктивно отличающийся гуманоидный робот Apollo может работать плавно, при этом та же общая модель привыкает к совершенно разным формам тела путем небольшого обучения.

В идеале разработчикам не нужно переобучать ИИ для каждого нового робота. Вместо этого им нужно только один раз обучить общую модель, а затем развернуть ее на различных платформах роботов с помощью легкого трансферного обучения. Ожидается, что эта возможность «одной модели для многократного использования» ускорит популяризацию и применение робототехнических технологий.

Конечно, несмотря на свой идеал, он имеет и свои недостатки.

По мере того, как роботы становятся все более интеллектуальными и автономными, требования к безопасности также возрастают. Хотя Gemini On-Device может выполнять действия, он не может обоснованно определить, является ли задание, которое вы ему даете, безопасным. Поэтому в модель необходимо добавить «запорный болт».

DeepMind предлагает разработчикам подключить модель к интерфейсу Google Gemini Live API, что позволит системе сначала определить, является ли инструкция разумной, а затем решить, следует ли ее выполнять; в то же время можно установить физические ограничения на уровне действий, такие как сила, угол и скорость, чтобы предотвратить несчастные случаи.

Кроме того, возможности многоэтапного логического планирования модели еще предстоит усовершенствовать.

Операции, требующие логического и последовательного расположения, такие как приготовление сэндвичей и уборка рабочего стола, пока не находятся в зоне комфорта. Это связано с архитектурой Gemini 2.0, на которой он основан. В будущем, по мере обновления до 2.5, эта часть возможностей также может быть дополнена.

Еще одна практическая проблема — это данные.

Хотя для начала требуется всего несколько десятков демонстраций, самая идеальная демонстрация — это реальные данные, собранные реальными людьми, когда они фактически управляют роботом, а не виртуальное моделирование. Результаты обучения с такими данными быстрее, точнее и стабильнее.

▲Адрес технического отчета: https://arxiv.org/pdf/2503.20020

По словам руководителя проекта Каролины Парада, это первый случай, когда Google выпустила модель искусственного интеллекта для робототехники, которая работает полностью независимо от облака, и это также первая версия, которую разработчики могут настраивать в соответствии со своими потребностями.

В настоящее время DeepMind открыла Gemini Robotics On-Device SDK и модель для «доверенных тестировщиков». Если вы разработчик, занимающийся разработкой роботов, промышленной автоматизацией или исследованием интеллектуальных систем, вы можете подать заявку на пробную версию уже сейчас.

Прикрепите ссылку на заявку: https://docs.google.com/forms/d/1sM5GqcVMWv-KmKY3TOMpVtQ-lDFeAftQ-d9xQn92jCE/edit?ts=67cef986

#Добро пожаловать на официальный публичный аккаунт WeChat iFanr: iFanr (WeChat ID: ifanr), где вам будет представлен еще более интересный контент как можно скорее.

iFanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo