«Опережаем» GPT-5! Google выпускает самый мощный пакет ИИ с самой дорогой подпиской на ИИ за всю историю — 1800 юаней в месяц

Накануне прошлогодней конференции Google I/O компания OpenAI запустила GPT-4o.

В этом году ситуации в нападении и обороне иные.

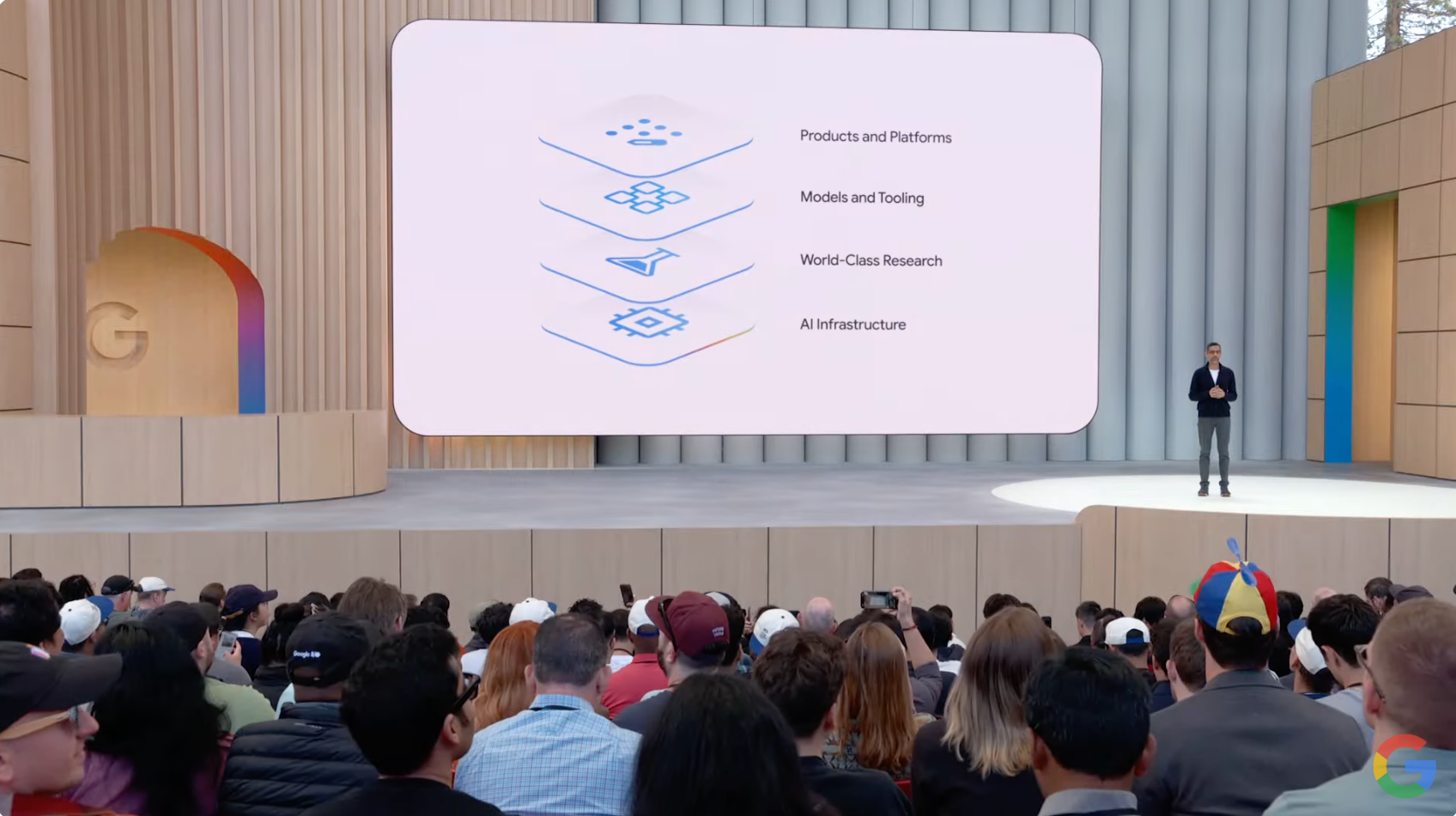

Несколько дней назад OpenAI объявила, что GPT-5 будет представлять собой платформу «всё в одном», объединяющую различные продукты. Только что Google реализовала эту идею на конференции I/O и напрямую представила свое самое мощное семейство ИИ.

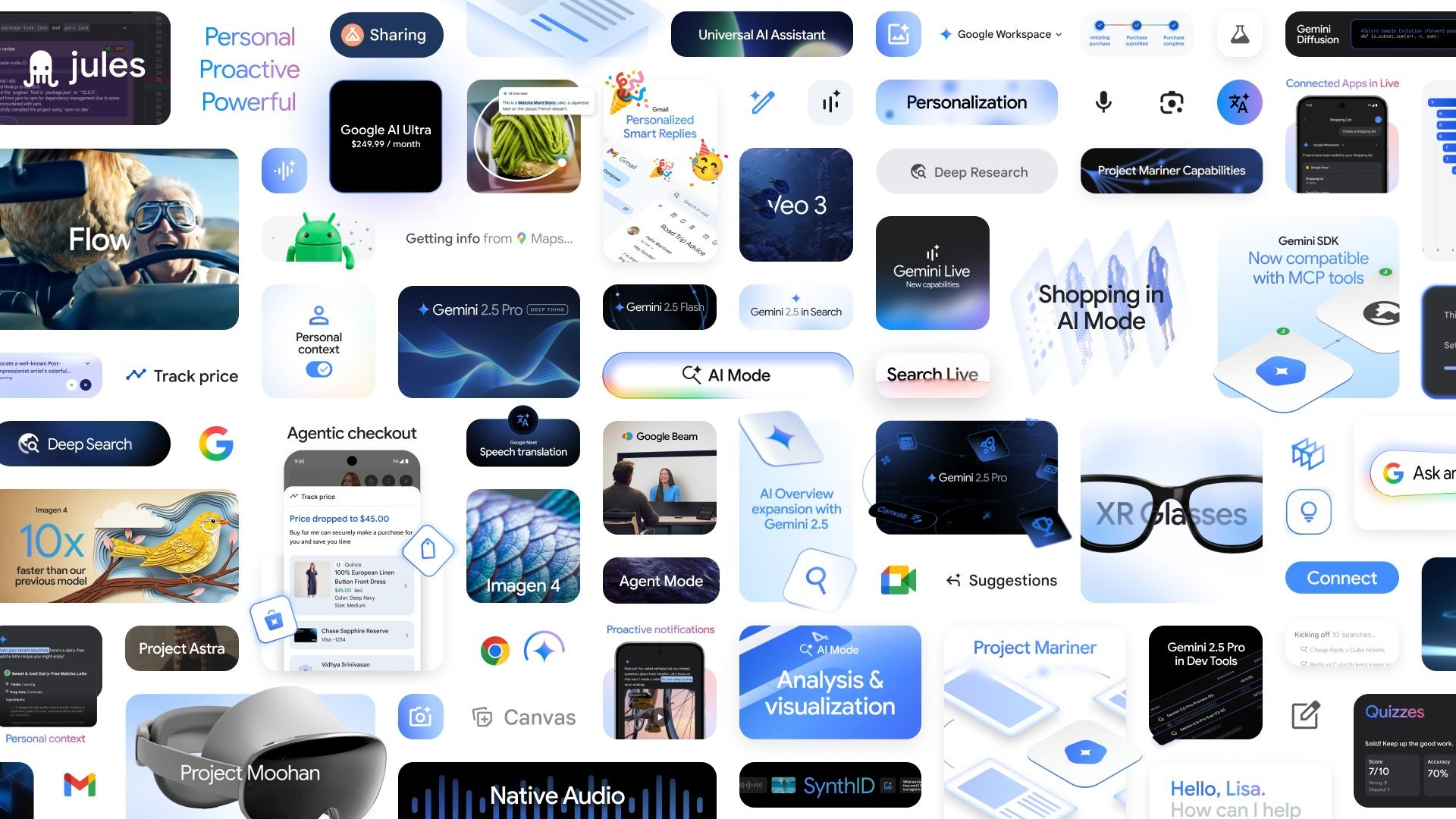

От выпуска моделей Gemini 2.5 Pro и Flash до AI Mode, Veo 3, Imagen 4 и наборов AI для разработчиков и создателей контента — Google практически сжал путь от модели до продукта до одной пресс-конференции.

Если говорить точнее, самые актуальные на данный момент сценарии применения ИИ были «заранее спрятаны» компанией Google в интерфейсах ее продуктов, что дало людям понять, что компания по-прежнему является одним из мировых гигантов в области ИИ с сильнейшим инженерным потенциалом и возможностями экологической интеграции.

Неудивительно, что многие пользователи сети пошутили, что после почти двухчасовой пресс-конференции большое количество стартапов погибнет от рук Google.

Однако нетрудно заметить, что некоторые функции, озвученные на пресс-конференции, пока еще находятся на стадии «трейлера» и мелкосерийного тестирования и могут быть далеки от реальной реализации.

Помогите мне «купить билеты + найти места + заполнить формы» за один раз. Объем поиска Google с помощью нового искусственного интеллекта сходит с ума

ИИ переписывает базовую логику поиска.

На прошлогодней конференции I/O компания Google запустила функцию AI Overviews, которая сейчас насчитывает более 1,5 млрд активных пользователей в месяц.

Генеративный ИИ постепенно изменил способ поиска, но теперь мы больше не довольствуемся вводом простых вопросов в строку поиска, а задаем более сложные, длинные и мультимодальные вопросы.

Сегодня Google вновь активизировала свои усилия по интеграции поиска и искусственного интеллекта, запустив сквозной опыт поиска на базе искусственного интеллекта — AI Mode.

Как заявил генеральный директор Google Сундар Пичаи, это самая мощная форма поиска на базе искусственного интеллекта, которую когда-либо разрабатывала Google. Он не только обладает более развитыми возможностями рассуждения и мультимодального понимания, но и поддерживает углубленное исследование с помощью контекстных вопросов и веб-ссылок.

Например, когда пользователь сталкивается с поисковым вопросом, требующим сложной интерпретации, режим ИИ может активировать механизм «глубокого поиска», проанализировать различную информацию и создать экспертный отчет о цитировании за несколько минут, что сэкономит вам часы исследовательского времени.

В то же время Google также интегрировала в поиск мультимодальные возможности Project Astra, чтобы еще больше повысить интерактивность поиска в реальном времени. Благодаря функции Search Live пользователи могут просто включить камеру, чтобы задать вопросы и получить обратную связь в режиме реального времени.

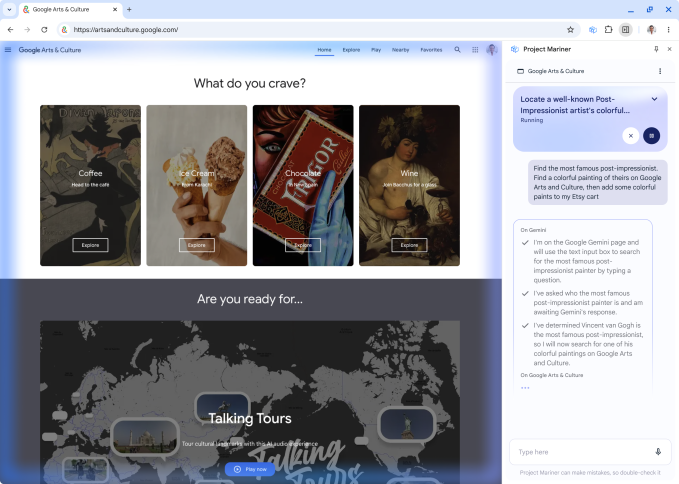

В этом году Agent появился впервые, и Google также предусмотрительно запустил функцию Project Mariner Agent, чтобы помочь пользователям эффективнее выполнять задачи.

Например, с помощью всего одного предложения: «Помогите мне найти два недорогих билета на субботнюю игру, расположенных на нижнем этаже», — режим искусственного интеллекта может автоматически искать варианты на нескольких платформах продажи билетов, сравнивать цены и наличие билетов в режиме реального времени и выполнять такие утомительные операции, как заполнение форм, что значительно повышает эффективность.

Режим Google AI Mode, работающий на основе модели Gemini и Google Shopping Graph, поможет вам сузить круг предлагаемых товаров и послужит источником вдохновения. Если вы хотите увидеть, как одежда смотрится на вас, просто загрузите свою фотографию, чтобы примерить одежду виртуально.

Кроме того, режим ИИ также обладает мощными возможностями персонализации. Он может предоставлять индивидуальные предложения на основе контекстных предпочтений пользователя, а также генерировать диаграммы и визуализацию результатов, особенно при поиске в спортивной и финансовой сфере.

Эта функция уже полностью запущена в США и в будущем будет распространена на большее количество регионов.

Умея писать код и сохранять токены, Gemini 2.5 получает статус «ученика-мастера».

Что касается возможностей модели, Google выпустила версию Gemini 2.5 Pro с интерфейсом ввода-вывода, которая возглавила рейтинги.

Теперь в Gemini 2.5 Pro представлен режим улучшения вывода под названием «Глубокое мышление». Эта функция учитывает несколько предположений перед формированием ответа, обеспечивая более глубокое понимание контекста вопроса.

2.5 Pro Deep Think занял первое место на Американской математической олимпиаде 2025 года (USAMO) и LiveCodeBench (тест по программированию), а также набрал 84,0% в MMMU (тестирование мультимодальных рассуждений).

Однако Google заявила, что потратит больше времени на проведение передовых оценок безопасности и обратится за дополнительными консультациями к экспертам по безопасности. На первом этапе функция Deep Think будет открыта для ограниченного круга тестировщиков через API Gemini.

Также обновлена модель Gemini 2.5 Flash, ориентированная на эффективность.

Новая версия Flash 2.5 имеет улучшения в ключевых показателях, таких как обоснование, мультимодальность, код и длинный контекст, при этом она более эффективна: при оценке используется на 20–30 % меньше токенов.

2.5 Flash уже доступен всем желающим в приложении Gemini, а общий релиз состоится в начале июня для разработчиков через Google AI Studio и для предприятий через Vertex AI.

С точки зрения опыта разработчиков, в версиях 2.5 Pro и 2.5 Flash будет реализована функция «Краткое изложение мыслей» в API Gemini и Vertex AI, которая может представить путь рассуждений модели в структурированном виде с заголовками, ключевой информацией и инструментами вызова.

Разработчики также выиграют от этого. Компания Google объявила, что будет официально поддерживать инструменты MCP в API и SDK Gemini, что позволит разработчикам легко получить доступ к большему количеству инструментов с открытым исходным кодом и экосистемам плагинов.

Музыка, фильмы и изображения доступны онлайн. Google сделал искусственный интеллект хитом

На этой конференции Google представил новое поколение моделей изображений и видео — Veo 3 и Imagen 4.

В отличие от традиционной генерации видео, Veo 3 — это модель генерации видео, поддерживающая аудио. Он может имитировать дорожное движение, пение птиц и даже разговоры персонажей на городских улицах, что значительно усиливает ощущение погружения.

Модель не только генерирует видеоролики на основе текстовых и графических подсказок, но и точно синхронизирует физическую среду с синхронизацией губ, что значительно повышает реалистичность создания видеороликов.

В настоящее время Veo 3 доступен подписчикам Ultra в приложении Gemini и на платформе Flow, а также поддерживается корпоративными пользователями на платформе Vertex AI.

Упомянутый выше Flow — это инструмент для создания фильмов на базе искусственного интеллекта, созданный Google для авторов.

Пользователи просто описывают сцены из фильмов на естественном языке, чтобы управлять актерами, локациями, реквизитом и стилем, автоматически создавая повествовательные сегменты. Flow теперь доступен пользователям Gemini Pro и Ultra в США, а его глобальное развертывание находится в разработке.

Что касается генерации изображений, новая версия Imagen 4 отличается повышенной точностью и скоростью и может реалистично отображать ткани, капли воды и шерсть животных в деталях, а также способна генерировать более абстрактные стили.

Он поддерживает разрешение 2K и несколько соотношений сторон, а также значительно оптимизирован с точки зрения набора текста и орфографии, что делает его пригодным для создания поздравительных открыток, плакатов и даже комиксов.

Imagen 4 доступен сегодня в Gemini, Whisk, Vertex AI, а также в Workspace Slides, Vids и Docs. Сообщается, что в будущем будет выпущена версия, которая будет работать в десять раз быстрее.

Что касается создания музыки, Google расширила доступ к Music AI Sandbox на базе Lyria 2 и запустила интерактивную модель генерации музыки Lyria RealTime. Модель теперь доступна разработчикам через API и AI Studio.

Принимая во внимание, что контент, созданный Veo 3, Imagen 4 и Lyria 2, по-прежнему будет содержать водяной знак SynthID, Google выпустила новый детектор SynthID.

Пользователям нужно только загрузить файлы, чтобы определить, содержат ли они водяные знаки SynthID, которые используются для защиты от подделок и отслеживания источника контента ИИ.

Google хочет создать «модель мира», которая даже сможет помочь вам выполнять задачи?

Google надеется превратить Gemini в «модель мира», которая сможет планировать, понимать и моделировать все аспекты реального мира.

Генеральный директор Google DeepMind Демис Хассабис заявил, что это направление является одной из основных концепций проекта Astra.

За последний год Google постепенно интегрировала в Gemini Live функции распознавания видео, совместного использования экрана, памяти и т. д. Теперь в Gemini добавлен новый голосовой вывод с собственным звуком, который звучит более естественно; Одновременно расширяются возможности памяти и использования компьютера.

Кроме того, Google изучает, как использовать возможности агента, чтобы помочь людям справляться с многозадачностью.

Одним из них является Project Mariner, который может выполнять до десяти задач одновременно, таких как запрос информации, бронирование, совершение покупок и исследование. Теперь он доступен пользователям Ultra в США и вскоре будет интегрирован в API Gemini и другие основные продукты.

Выпущено большое количество новых функций ИИ. Появится ли действительно сногсшибательная функция?

Вчера NotebookLM официально объявил, что он стал вторым по популярности приложением для повышения производительности и девятым по популярности приложением в App Store всего за 24 часа с момента запуска.

NotebookLM — это важное исследование Google в области инструментов для создания заметок на основе искусственного интеллекта, в котором реализованы такие функции, как аудиообзор и составление ментальных карт.

Среди них аудиообзоры в настоящее время поддерживают более 80 языков, и на этой неделе Google также объявила, что внедрит более широкие возможности настройки этой функции. Пользователи могут выбирать длину резюме в соответствии со своими потребностями, будь то быстрый просмотр или углубленное чтение.

Сначала эта функция будет доступна на английском языке, а затем будет расширена и на другие языки.

В то же время Google также реагирует на потребности пользователей в визуальном представлении и вскоре добавит в NotebookLM функцию видеообзора. Пользователи могут преобразовывать содержимое заметок в обучающие видеоролики всего одним щелчком мыши, донося информацию более интуитивно понятным способом.

В области программирования искусственного интеллекта Google также привнесла последние достижения Жюля.

Этот автономный помощник по кодированию, изначально появившийся в Google Labs, может понимать код и автономно выполнять задачи разработки, такие как написание тестов, создание функций и исправление ошибок. Теперь он официально вошел в стадию публичного бета-тестирования.

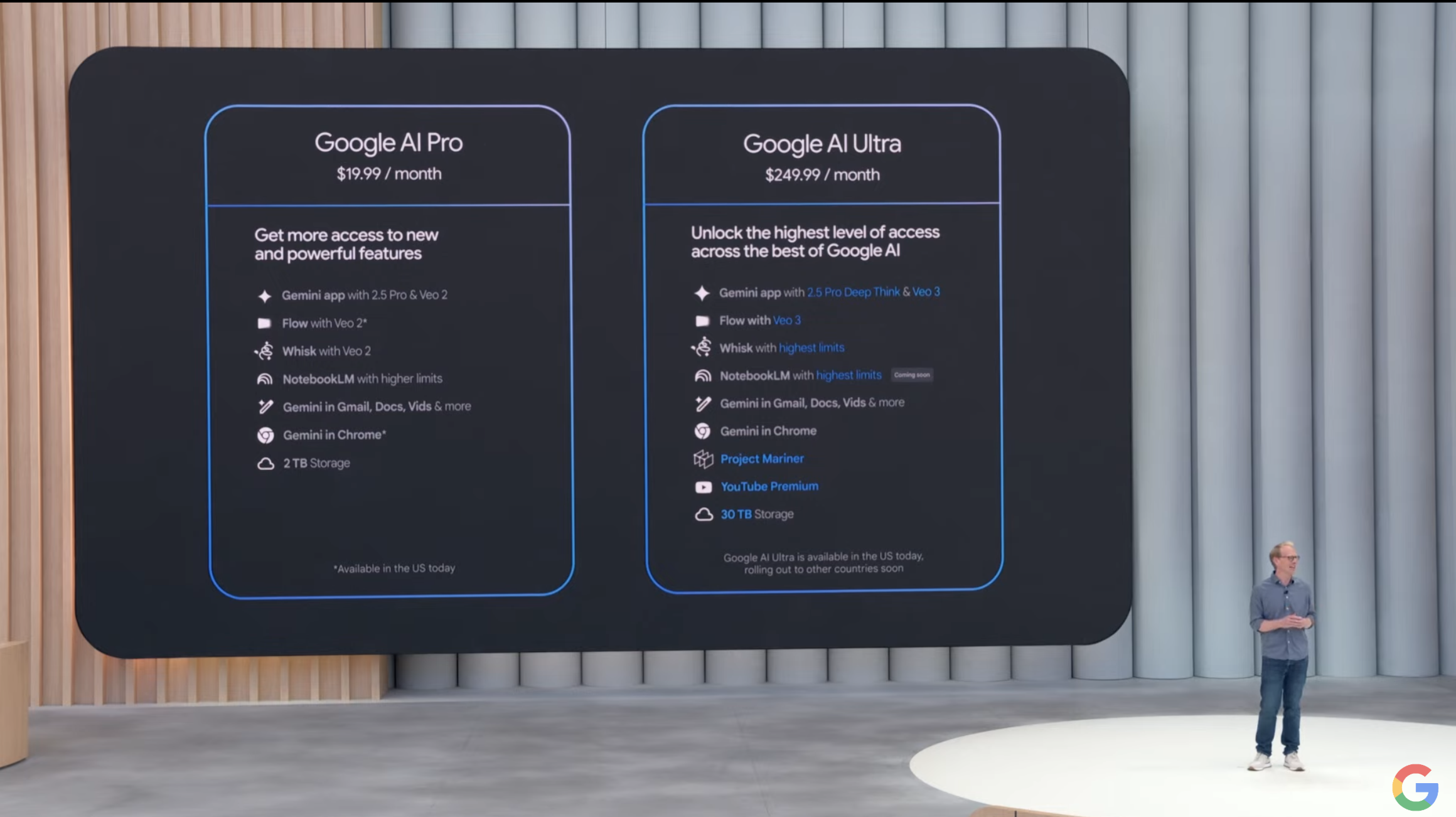

Кроме того, Google запустила новую подписную услугу Google AI Ultra.

План предоставляет профессиональным пользователям неограниченный доступ к самым мощным моделям и расширенным функциям Google. Подходит для таких профессионалов, как кинематографисты, разработчики, творческие работники и т. д., ежемесячная плата составляет 249,99 долларов США.

В настоящее время программа доступна в США и вскоре будет распространена на другие страны.

На самом деле, сегодня у ИИ нет недостатка в моделях и функциях. Чего действительно не хватает, так это «убойного продукта», который можно внедрить в повседневную жизнь и по-настоящему завоевать умы большинства пользователей.

Google, безусловно, это понимает и прилагает все усилия, чтобы найти ответ.

Таким образом, мы видим, что на этой пресс-конференции Google сделала практически все и упомянула обо всем: от текста, изображений, видео, музыки до поиска, агентов и креативных инструментов.

Карты раскрыты, и технология готова. Теперь все, что нужно Google, — это действие, которое действительно затронет болевые точки пользователя.

#Добро пожаловать на официальный публичный аккаунт WeChat iFanr: iFanr (WeChat ID: ifanr), где вам будет представлен еще более интересный контент как можно скорее.

iFanr | Исходная ссылка · Просмотреть комментарии · Sina Weibo