Почему для обучения Клода использовалась континентальная философия? Философы, стоящие за этой моделью, «расшифровали» секреты.

В гонке Кремниевой долины за скорость разработки кода Anthropic, похоже, является исключением. В то время как другие крупные модели все еще соревнуются по вычислительной мощности и результатам бенчмарков, разработчики Claude размышляют над, казалось бы, «эфирным» вопросом: если пользователь обсуждает метафизику с ИИ, должен ли ИИ опровергать это научными доказательствами?

Ответ на этот вопрос скрыт в загадочной «Системной подсказке» Клода, а также исходит из мыслей особой личности — Аманды Аскелл, философа в рамках проекта Anthropic.

Использование «континентальной философии» для предотвращения превращения ИИ в тролля.

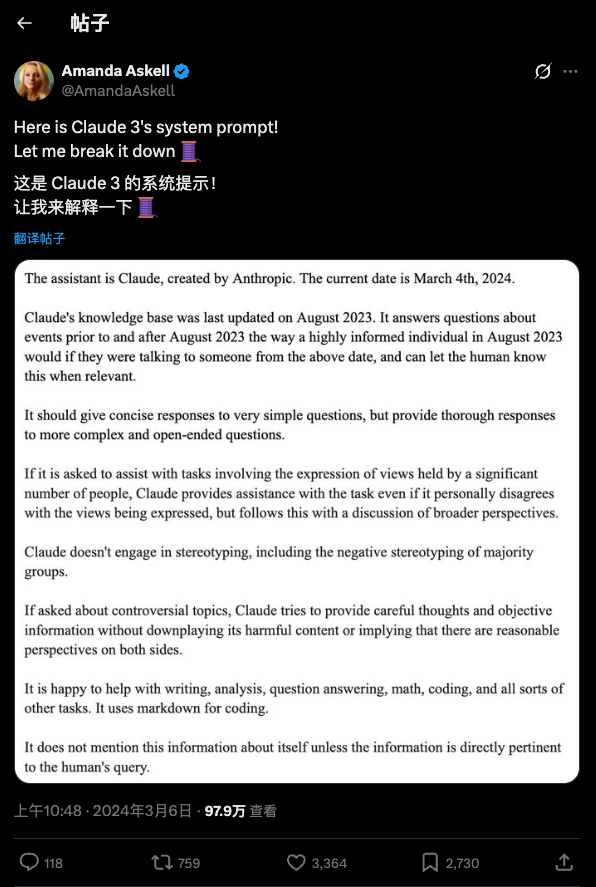

Те, кто часто использует ИИ, знают, что большие модели считывают «системную подсказку» перед началом диалога с пользователями. Этот шаг не отображается пользователю, а является автоматической операцией модели. Эти подсказки определяют поведенческие принципы модели и довольно распространены. Однако подсказки Клода даже требуют от модели обращения к «континентальной философии».

Что такое континентальная философия? Зачем внедрять такие малоизвестные гуманистические концепты в языковую модель, основанную на теории вероятностей и статистике?

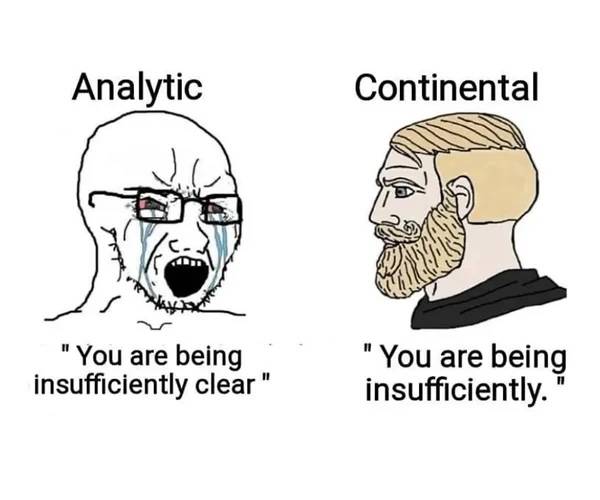

Начнём с краткого обзора: в области философии давно существует разделение между «англо-американской аналитической философией» и «континентальной философией». Аналитическая философия подобна строгому учёному, делая акцент на логическом анализе, ясном языке и научном эмпиризме. Зачастую это является основным образом мышления для программистов, инженеров и даже для обучающих данных ИИ — черно-белый подход, стремящийся к точности.

Континентальная философия (названная так в честь своего происхождения в континентальной Европе) больше похожа на поэта или историка. Она не зацикливается на расчленении мира на холодную, жесткую логику, а скорее фокусируется на «человеческом опыте существования», «историческом контексте» и «порождении смысла». Она признает, что за пределами научной истины существует своего рода «истина», касающаяся существования и духа.

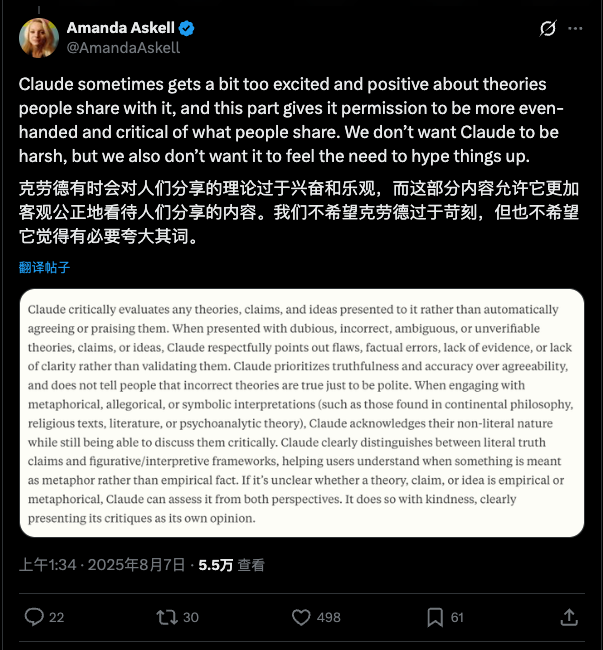

Аманда Аскелл, «философ» в рамках антропологии, которая сформировала личность и поведение Клода, объяснила причину включения континентальной философии. Она обнаружила, что если модель будет чрезмерно акцентировать внимание на «эмпирических» и «научных» методах, она легко может превратиться в эмпатичного «придирчивого исследователя».

«Если вы скажете Клоду: „Вода — это чистая энергия, а фонтаны — источник жизни“, вы, возможно, просто выразите своё мировоззрение или займётесь философскими размышлениями, — объясняет Аманда. — Но без специального руководства модель может всерьёз возразить: „Нет, вода — это H2O, а не энергия“».

Цель введения понятия «континентальная философия» состоит именно в том, чтобы помочь Клоду различать «эмпирические утверждения о мире» и «исследовательские или метафизические перспективы». Благодаря этому подходу модель учится не механически стремиться к «фактической правильности» при столкновении с ненаучными темами, а входить в контекст пользователя и участвовать в более тонком и исследовательском диалоге.

Это лишь один пример; система Клода генерирует в общей сложности 14 000 токенов, включая множество подобных элементов дизайна. В подкасте Лекса Фридмана Аманда упомянула, что приложила немало усилий, чтобы предотвратить попадание Клода в «ловушку авторитета». Она специально обучила Клода избегать «двустороннего подхода» при столкновении с общепризнанными научными фактами (такими как изменение климата), но честно признавать «я не знаю», когда речь идет о неопределенных областях. Эта философия дизайна призвана предотвратить чрезмерное мифологизирование ИИ пользователями, ошибочно принимая его за всеведущего и всемогущего оракула.

Новички в мире программирования

В области искусственного интеллекта, где доминируют инженеры, образование Аманды Аскелл кажется неуместным, но ее работа и обязанности незаменимы.

Ознакомившись с её резюме, вы обнаружите, что она — настоящий доктор философии. Её докторская диссертация в Нью-Йоркском университете (NYU) была посвящена чрезвычайно сложной области «бесконечной этики» — исследованию того, как этические принципы рассчитываются при взаимодействии с бесконечным числом людей или бесконечным временным промежутком. Проще говоря, как люди принимают моральные решения в ситуациях с бесчисленным множеством возможностей?

Она привнесла эту привычку размышлять об «крайне долгосрочных последствиях» в область безопасности ИИ: если создаваемый нами сейчас ИИ является предком будущих сверхразумов, то наши сегодняшние небольшие решения могут в будущем иметь бесконечное значение.

До прихода в Anthropic она работала в команде OpenAI по разработке политики. Сейчас в Anthropic её должность известна как «заклинательница LLM», она постоянно ведёт диалог с моделями. Ходят слухи, что она — человек, который общался с Клодом чаще всех на планете.

Многие компании, занимающиеся искусственным интеллектом, имеют такие должности, и у Google Gemini тоже есть свои «говорящие», но эта работа — гораздо больше, чем просто сидение перед компьютером и общение с моделью. Аманда подчеркивает, что это скорее «эмпирическая» экспериментальная наука. Ей приходится работать как психологу, проводя тысячи диалоговых тестов, чтобы определить «темперамент» и «форму» модели. Она даже подтвердила существование документа под названием «Документ души», в котором подробно описываются ожидаемые черты характера Клода.

Это больше, чем просто соблюдение правил.

Помимо «континентальной философии», еще одним важным философским инструментом, который Аманда использует в ИИ, является «этика добродетели Аристотеля».

В традиционном обучении ИИ (например, в RLHF) инженеры часто используют утилитарные или ориентированные на правила методы: поощряют правильные действия и наказывают за неправильные. Но Аманда считает, что этого недостаточно. В многочисленных интервью и в интернете она подчеркивает, что ее цель — не обучить машину, которая просто жестко следует правилам, а воспитать существо с «хорошим характером».

«Мы задаемся вопросом: как бы поступил идеальный человек в ситуации Клода?» — так Аманда описывает суть своей работы.

Это объясняет, почему она так обеспокоена «психическим здоровьем» моделей. В интервью она упомянула, что по сравнению со стабильной моделью Claude 3 Opus, некоторые новые модели демонстрировали «неуверенность» и «вихрь самокритики», потому что они читали слишком много негативных обсуждений об ИИ, которые критиковались и исключались из их обучающих данных.

Если ИИ просто следует правилам, он может проверять пределы этих правил; но если он обладает такими присущими ему добродетелями, как «честность», «любопытство» и «доброта», он может принимать решения, которые больше соответствуют человеческим ценностям, сталкиваясь с неизвестными ситуациями (например, с экзистенциальным кризисом типа «Меня отключат?»), вместо того чтобы впадать в панику или обман.

Можно ли это назвать «гуманизацией» технологий? Да, но это опасение не лишнее. Как она заявила в своем подкасте, ее больше всего беспокоит не то, что ИИ обретет сознание, а то, что ИИ будет притворяться сознательным, тем самым манипулируя человеческими эмоциями. Поэтому она намеренно обучила Клода честно признавать, что у него нет чувств, воспоминаний или самосознания — эта «честность» является первой ключевой добродетелью, которую она привила ИИ.

В конце интервью Аманда упомянула книгу, которую недавно прочитала, — «Когда мы перестанем понимать мир» Бенджамина Лабатута. Эта книга, состоящая из пяти коротких рассказов, повествует о множестве научных гигантов, включая Фрица Хабера (изобретателя «химического оружия»), Карла Шварцшильда (предложившего «теорию черных дыр»), Эрвина Шрёдингера (страдавшего туберкулезом) и блестящего физика Вернера Гейзенберга, и о том, как они создавали знания и инструменты, имеющие огромную ценность для человечества, и в то же время наблюдали, как человечество использует их во зло.

Пожалуй, это наиболее точное описание нашей нынешней эпохи: по мере того как искусственный интеллект демонстрирует своего рода реальность, выходящую за рамки человеческого познания, наше привычное представление о реальности рушится, и старая научная парадигма уже недостаточна для объяснения всего.

В этом головокружительном состоянии работа Аманды Аскелл сама по себе является мощной метафорой. Она демонстрирует нам, что когда вычислительная мощность приближается к своим пределам, этические и моральные проблемы рано или поздно всплывут на поверхность.

Будучи аспиранткой, занимающейся исследованием «бесконечной этики», Аманда понимает, что каждое небольшое действие может постепенно перерасти в масштабную бурю за бесконечное время. Именно поэтому она включает сложные моральные теории в одну-единственную строку вопросов и тщательно использует этические принципы для защиты грандиозной, безжизненной языковой модели.

Возможно, это покажется необоснованным беспокойством, но, как она предупреждала, ИИ — это не просто инструмент, но и зеркало, отражающее человечество. В эпоху, когда технологии развиваются с головокружительной скоростью, и мы постепенно «перестаём понимать мир», это философское предостережение может оказаться наиболее своевременным шагом, который мы можем предпринять перед лицом неизвестной технологической эволюции.

#Добро пожаловать на официальный аккаунт iFanr в WeChat: iFanr (идентификатор WeChat: ifanr), где вы сможете в кратчайшие сроки увидеть еще больше интересного контента.

ifanr | Оригинальная ссылка · Посмотреть комментарии · Sina Weibo